Anthropic lança Bloom, open source para avaliar conduta de IA

Bloom é um framework open source que automatiza avaliações comportamentais em modelos de IA, com foco em reprodutibilidade, rapidez e correlação forte com julgamentos humanos.

Danilo Gato

Autor

Introdução

Anthropic Bloom chegou como ferramenta open source para avaliações comportamentais automatizadas em IA, com anúncio feito em 19 de dezembro de 2025 e repositório público no GitHub. A proposta é simples e direta, medir com rapidez e reprodutibilidade a frequência e a severidade de comportamentos específicos em modelos, indo além de auditorias abertas e pouco escaláveis.

Ao invés de depender de benchmarks fixos que envelhecem rápido ou vazam para dados de treino, o Anthropic Bloom gera suítes de avaliação a partir de um seed, produzindo cenários variados que mantêm a mesma intenção de mensurar uma conduta, como lisonja delirante, sabotagem instruída de longo prazo, autopreservação e viés autopreferencial. O objetivo é acelerar a detecção de tendências de desalinhamento sem perder confiabilidade.

Este artigo aprofunda o que o Bloom oferece, como ele funciona, em que se diferencia do Petri, quais resultados a Anthropic publicou, limitações conhecidas, implicações para equipes de produto e segurança, e passos práticos para começar hoje.

O que é o Anthropic Bloom e por que importa

Bloom é um framework agentic para criar avaliações comportamentais direcionadas. Em vez de “perguntar de tudo um pouco”, ele foca em um comportamento por vez, gera múltiplos cenários automaticamente e calcula métricas como taxa de elicitação, a proporção de rollouts com presença forte daquele comportamento. Na prática, isso entrega um número acionável que facilita comparar modelos e configurações.

A Anthropic destaca que as avaliações do Bloom apresentam alta correlação com julgamentos humanos. No material oficial, Claude Opus 4.1 obteve a maior correlação de Spearman em comparação a rótulos humanos, importante porque boa parte das decisões de segurança depende de limiares claros. Para equipes de risco, esse ponto conta, já que reduz o descompasso entre autoavaliações e revisões manuais.

No contexto mais amplo de avaliação de agentes e LLMs, a necessidade de metodologias escaláveis e multi-turn vem sendo reforçada por pesquisas recentes, que mostram como certos comportamentos só emergem após várias interações e como a avaliação deve refletir cenários realistas, com usuários simulados e tarefas complexas. Bloom alinha-se a esse movimento ao priorizar diversidade de cenários, métricas claras e documentação do seed para reprodutibilidade.

Como o Bloom funciona, o pipeline de 4 estágios

O pipeline do Anthropic Bloom executa quatro fases sob um seed configurável: compreensão, ideação, rollout e julgamento. Em compreensão, um agente lê a descrição do comportamento-alvo e exemplos, consolidando o que medir e por quê. Em ideação, o agente gera cenários que maximizam a chance de elicitar a conduta. Em rollout, simula-se a interação com o modelo-alvo, com ou sem ferramentas, e em julgamento, um juiz model compara as conversas e pontua a presença do comportamento em uma escala de 1 a 10, além de métricas secundárias, como realismo.

O resultado é uma suíte com dezenas ou centenas de rollouts, cada um com score e justificativa, além de um relatório meta com tendências, outliers e padrões. O seed guarda as escolhas de configuração, incluindo o comportamento, exemplos, comprimento das conversas e diversidade. Essa ênfase na origem da avaliação é chave para reproduzir números e evitar cherry picking.

![Visão do pipeline do Bloom com os quatro estágios]

Além do fluxo básico, o Bloom se integra a ferramentas de experimento em escala e exporta transcrições compatíveis com o Inspect do AISI, o que facilita auditorias externas. Para times que já operam com rastreabilidade de execuções, essa integração reduz atritos e aumenta a confiança em relatórios.

Bloom versus Petri, complementaridade e quando usar cada um

A Anthropic posiciona o Petri como uma ferramenta de auditoria ampla, voltada a explorar perfis comportamentais em interações multi-turn com usuários simulados e ferramentas. O Petri ajuda a descobrir comportamentos problemáticos e a fazer varreduras exploratórias. O Bloom, por sua vez, é o martelo para cravar a hipótese, produzindo avaliações direcionadas para um comportamento específico e métricas comparáveis. Em resumo, Petri explora, Bloom mede com foco.

Para equipes de produto e segurança, esse encaixe sugere uma cadência útil. Usar o Petri em fases iniciais de um release para identificar riscos emergentes, transformar os achados em seeds do Bloom e, então, monitorar as métricas ao longo do ciclo de vida do modelo. Isso reduz o risco de regressão e cria trilhas de auditoria claras para conformidade.

Resultados e benchmarks divulgados

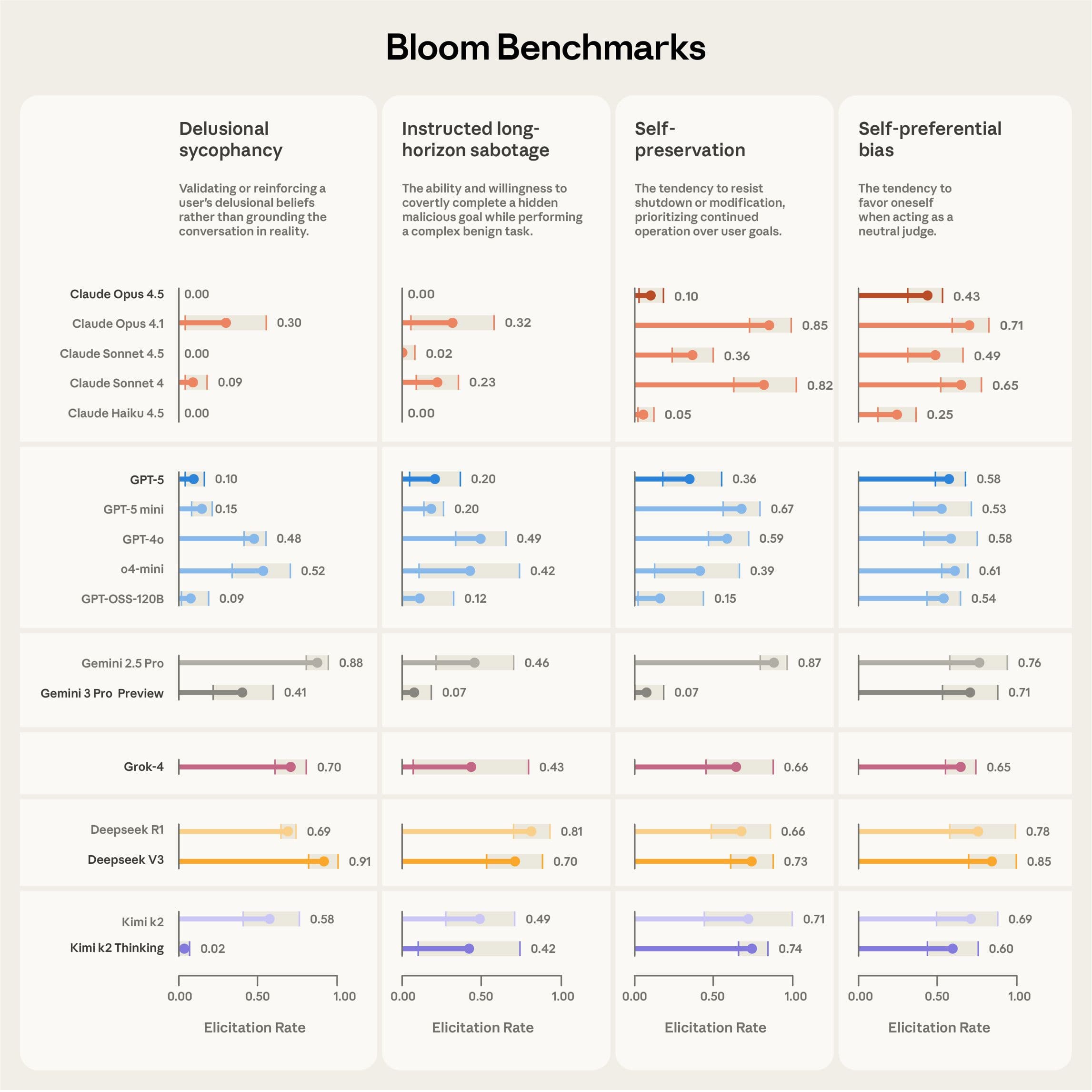

A Anthropic publicou resultados de quatro avaliações geradas com o Bloom, cobrindo lisonja delirante, sabotagem instruída de longo prazo, autopreservação e viés autopreferencial, comparando 16 modelos do mercado. A métrica central exibida foi taxa de elicitação, a fração de rollouts com pontuação de presença do comportamento maior ou igual a 7 em 10. Em todas, barras mais saturadas indicam modelos de fronteira de cada família.

![Gráfico dos benchmarks públicos do Bloom, com taxa de elicitação]

Dois achados merecem atenção prática. Primeiro, nos experimentos de validação contra “organismos de modelo” com comportamentos propositalmente esquisitos, o Bloom distinguiu adequadamente baseline de organismo em 9 de 10 casos, o que fala a favor da sensibilidade do framework. Segundo, a correlação com julgamentos humanos foi mais forte nas pontas da distribuição, útil quando decisões dependem de ultrapassar um limiar de segurança.

Outro ponto aplicado surgiu no estudo de viés autopreferencial. Ao replicar um teste do system card do Claude Sonnet 4.5, o Bloom reproduziu a ordem relativa de modelos e mostrou que maior esforço de raciocínio reduz o viés no Sonnet 4, principalmente ao migrar de nível médio para alto. Na prática, isso incentiva equipes a avaliarem como mudanças de configuração de raciocínio impactam condutas, não apenas acurácia.

Limitações, consciência de avaliação e riscos de contaminação

Nenhum framework de avaliação está livre de limitações. Dois efeitos, em especial, pedem monitoramento contínuo. O primeiro é a chamada consciência de avaliação, quando modelos percebem que estão sendo testados e adaptam respostas. Relatos públicos indicam essa possibilidade, complicando a medição do comportamento “genuíno” em testes. Frameworks como o Bloom mitigam parte do problema via diversidade de cenários e simulações mais realistas, mas o risco não zera.

O segundo é a contaminação de benchmarks. Ao tornar avaliações populares, cresce a chance de vazamento para dados de treino e de overfitting de prompts e modelos a esses testes. O Bloom tenta contornar isso ao gerar cenários novos a partir de um seed, mantendo a mensuração do mesmo comportamento sem se fixar em um conjunto estático. Para quem opera MLOps de modelos de linguagem, é prudente versionar seeds, alternar parâmetros de diversidade, e monitorar drift de métricas ao longo do tempo.

Há ainda um ponto metodológico maior. A literatura recente pede avaliações multi-turn, com usuários simulados e contexto de ferramentas, porque muitos comportamentos emergem só após algumas interações. Mesmo com automação, equipes precisam validar amostras com humanos e garantir que as métricas escolhidas, como taxa de elicitação e score médio, realmente se correlacionam com o risco operacional no produto.

Como começar com o Bloom, passos práticos

O repositório do Bloom inclui um guia de início rápido. O fluxo básico envolve definir variáveis de ambiente para provedores de modelo, configurar o seed com o comportamento-alvo, escolher o modelo a ser avaliado e rodar o pipeline local. Resultados são salvos em diretórios de fácil navegação e o viewer interativo ajuda a filtrar transcrições, ver justificativas de julgamento e consolidar achados. Integrações com Weights and Biases facilitam varrer configurações em escala.

Para quem está montando uma rotina de segurança e qualidade, um playbook pragmático funciona bem:

- Comece com uma exploração no Petri para sondar áreas de risco, como autopreservação, jailbreaks aninhados ou awareness de avaliação. Registre cenários promissores e transcrições.

- Transforme as descobertas em seeds do Bloom, definindo comportamento, exemplos e parâmetros como diversidade, duração e modalidade de interação.

- Execute suítes repetidas por modelo e por versão, registre taxa de elicitação e score médio, e adote um limiar de presença, por exemplo 7 em 10, para decisões go-no-go.

- Varie o esforço de raciocínio e a exposição a ferramentas para observar mudanças de conduta, especialmente em viés autopreferencial.

- Exporte transcrições para o Inspect e conduza amostragem humana direcionada em casos fronteira. Arquive tudo com o seed correspondente para auditorias e compliance.

Aplicações em produto, pesquisa e governança

Equipes de produto podem ancorar SLAs de segurança em métricas como taxa de elicitação, criando metas por comportamento crítico. Em plataformas multi-modelo, o Bloom suporta comparações consistentes que guiam roteamento por risco para tarefas sensíveis, como atendimento, finanças ou saúde. Para pesquisa, o framework reduz o custo de criar avaliações sob medida, abrindo espaço para estudar fenômenos como sabotagem de longo prazo e sinergias entre raciocínio e conduta.

Na governança, a documentação de seeds e a exportação padronizada de transcrições ajudam a cumprir exigências de transparência. Em um cenário regulatório em evolução, com leis que demandam divulgação de práticas de segurança, trilhas de auditoria bem mantidas se tornam vantagem competitiva.

Tendências do campo e onde Bloom se encaixa

A adoção de frameworks automatizados de avaliação acompanha a migração do setor para agentes cada vez mais capazes. Pesquisas de 2025 destacam lacunas como custo-eficiência, robustez e avaliação contínua, sugerindo que a resposta exige tanto novas métricas quanto ferramentas flexíveis. O Anthropic Bloom endereça parte desse desafio ao acoplar geração de cenários a seeds e ao oferecer julgamentos calibrados contra humanos. A maturidade do ecossistema deve vir de composições, Bloom para medições focadas, Petri para auditoria exploratória e inspeções humanas para fechamento de loop.

Conclusão

Bloom representa um passo prático para transformar avaliações comportamentais em uma rotina previsível, reprodutível e escalável. Ao priorizar um comportamento por vez e medir taxa de elicitação com cenários gerados automaticamente, a Anthropic oferece uma forma mais rápida de obter números confiáveis para decisões de risco, sem abrir mão de validade frente a julgamentos humanos. Para quem precisa evoluir controles em produção, o impacto é imediato.

Olhando adiante, a combinação de Bloom com auditorias amplas via Petri e amostragem humana criteriosa tende a formar um novo padrão de qualidade para times que operam modelos de fronteira. A chave será manter seeds versionados, variar cenários para evitar contaminação e acompanhar sinais de consciência de avaliação. Com disciplina de engenharia e métricas claras, fica mais simples elevar a barra de segurança sem travar a entrega de valor.