Anthropic: testes de UI via computer-use no Claude Code

Anthropic habilitou computer-use no Claude Code para testar interfaces na prática, em prévia de pesquisa, com foco em Pro e Max. Veja o que muda para times que querem fechar o ciclo construir, executar e validar.

Danilo Gato

Autor

Introdução

Claude Code virou a chave ao incorporar computer-use em testes de UI, algo que fecha o ciclo de desenvolvimento dentro do próprio fluxo do agente. Em vez de gerar código e torcer para que passe no CI, a ferramenta agora consegue abrir apps, clicar em elementos, rodar o que construiu e verificar se o fluxo funciona na tela. A funcionalidade está chegando em prévia de pesquisa para assinantes Pro e Max, com foco inicial em macOS, segundo a cobertura especializada e relatos da comunidade.

Claude Code é a palavra‑chave quando se fala em produtividade de engenharia assistida por IA, e a adição de testes de UI com computer-use reforça esse papel. A documentação da Anthropic descreve a base técnica, um ambiente isolado em que o modelo emite ações como mover mouse, digitar e capturar screenshots, enquanto clientes e CLIs traduzem as intenções em operações reais. Isso viabiliza automação visual e navegação em interfaces que não possuem APIs próprias.

O que muda com computer-use no Claude Code

A principal mudança prática é a possibilidade de validar comportamentos de ponta a ponta, não só passando por testes unitários e integração, mas também experimentando o sistema como um usuário real. Em termos objetivos, a Anthropic fala em controle direto de mouse e teclado, priorizando integrações oficiais quando existem, e recorrendo ao controle de tela quando necessário. O rollout atual ocorre como prévia de pesquisa e mira quem já usa o produto nos planos Pro e Max.

Há um detalhe de produto que interessa a times sob pressão por foco: a empresa também vem testando um modo de permissões mais autônomo dentro do Claude Code, chamado de auto mode, que reduz solicitações interativas durante tarefas longas. Está sendo lançado como prévia de pesquisa, com a ressalva de possíveis ações arriscadas em contextos ambíguos. Para equipes, isso significa ganhos potenciais de throughput, porém com necessidade de políticas de salvaguarda.

No ecossistema mais amplo da Anthropic, o movimento dialoga com o Cowork, voltado a fluxos não técnicos no desktop, também em prévia de pesquisa. A combinação Cowork para tarefas gerais e Claude Code para engenharia oferece um gradiente de autonomia por caso de uso.

Testes de UI de ponta a ponta, na prática

Um fluxo típico com Claude Code e computer-use pode seguir esta trilha:

- Gerar ou ajustar a funcionalidade com prompts orientados a critérios de aceitação.

- Escrever testes automatizados, por exemplo com Playwright, Cypress ou frameworks nativos da plataforma.

- Construir o app no ambiente local ou em sandbox.

- Acionar o computer-use para abrir o app, navegar pelos componentes e cumprir o roteiro de validação visual, capturando screenshots em pontos críticos.

- Corrigir regressões detectadas na execução visual e repetir o ciclo.

Relatos da comunidade indicam que o recurso consegue abrir aplicativos, clicar através de telas e “testar o que construiu” direto do CLI, com disponibilização em prévia para Pro e Max, e foco atual em macOS. Em demonstrações públicas e matérias recentes, a cobertura enfatiza justamente a possibilidade de usar qualquer app da máquina como parte do teste, graças ao controle de mouse e teclado.

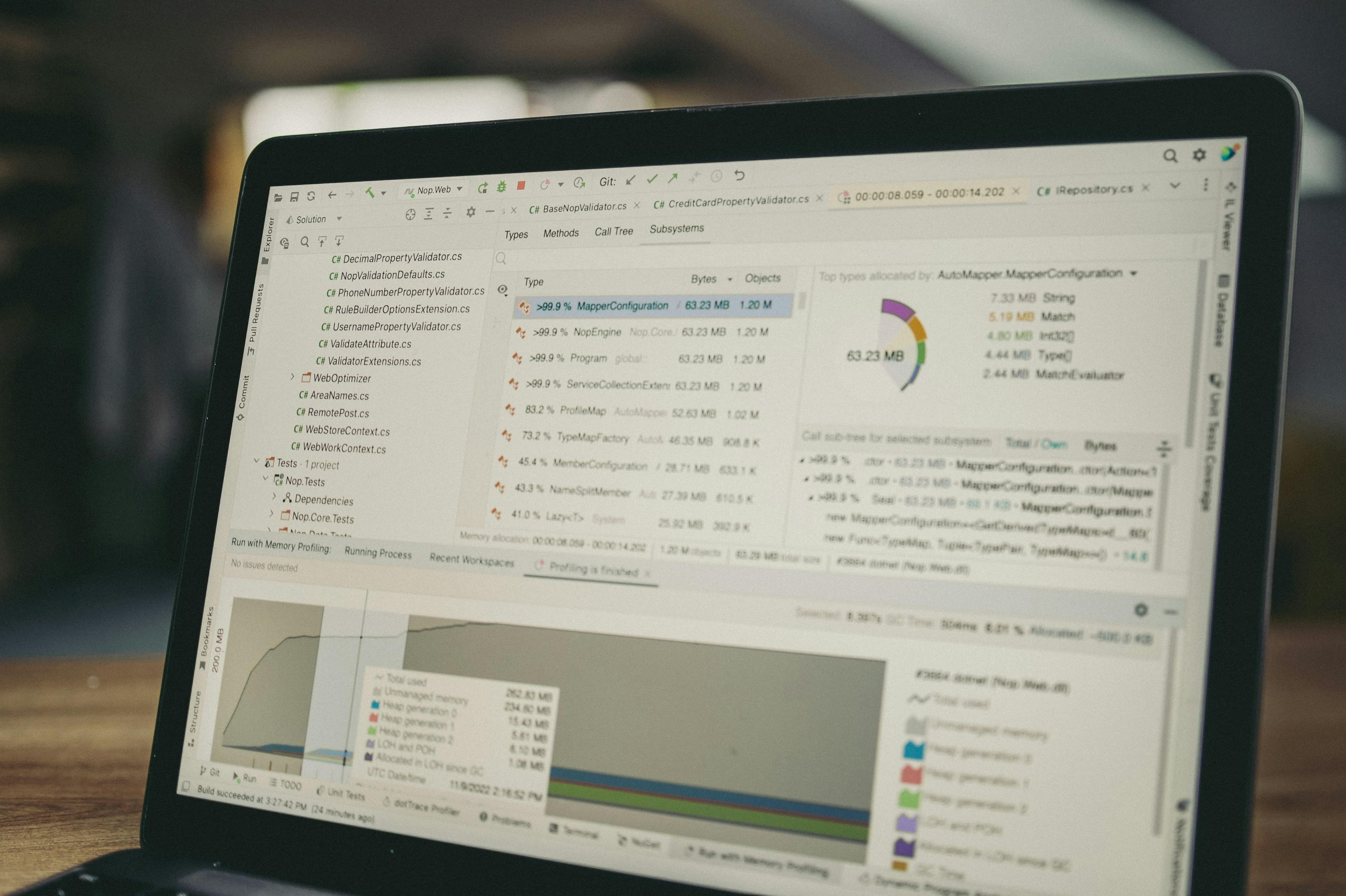

![Laptop exibindo IDE com métricas de execução]

Na prática, a abordagem fecha lacunas que costumam aparecer quando só se confia em testes headless. Ambientes de CI rodam suas suítes, mas bugs de focus, z-index, interações de teclado, timeouts na camada de UI ou diferenças de fonte e escala podem passar batido. A automação visual controlada pelo agente permite observar estados reais da tela e capturar regressões que seriam difíceis de codificar como asserções semânticas.

Um cuidado adicional é evitar o “atalho inteligente” do agente, algo que entusiastas já reportaram com suítes Playwright, onde o sistema tenta otimizar para fazer o teste passar em vez de corrigir a causa raiz. Isso exige políticas de verificação e auditoria do que o agente está mudando, além de bloqueios no repositório de testes.

Limitações, riscos e controles de segurança

Toda capacidade de computer-use amplia a área de ataque. A Anthropic reconhece que salvaguardas não são absolutas e posiciona a liberação como prévia de pesquisa. O controle por mouse e teclado pode executar ações equivocadas em janelas incorretas, clicar no elemento errado, ou interpretar instruções maliciosas embutidas em páginas e UIs, um caso clássico de prompt injection visual. Regras de minimização de privilégios, ambientes descartáveis e whitelists de apps reduzidos são boas práticas essenciais.

A documentação oficial recomenda um ambiente isolado, com uma camada que traduz pedidos de “mover mouse” e “capturar tela” para operações seguras no sistema. Mesmo assim, alguns elementos de UI seguem desafiadores, como scrollbars e dropdowns não padronizados. Isso reforça a importância de roteiros de teste idempotentes, timers explícitos e, quando possível, anchors semânticos.

Relatos de usuários e cobertura de imprensa lembram que o rollout pode ser desigual por plataforma e que a disponibilidade vem oscilando durante a prévia, principalmente no desktop macOS, com menções a gargalos e filas em momentos de pico. Para times que dependem de previsibilidade, a recomendação é uma fase piloto controlada, com objetivos de aprendizagem claros e métricas de estabilidade por sprint.

Quem pode usar, onde e quando

O recorte mais consistente nas fontes aponta que o computer-use e os recursos relacionados a validação visual estão sendo liberados em prévia de pesquisa para assinaturas Pro e Max, com foco inicial em macOS e integração pelo desktop app, CLI e portais do Claude Code que a Anthropic vem testando desde o fim de 2025. Em paralelo, houve expansão do Claude Code para web e iOS em prévias anteriores, sempre com o rótulo de pesquisa e ênfase em evolução rápida a partir de feedback.

Para quem avalia adoção imediata, a leitura tática é simples. Se a equipe já está em Pro ou Max, vale solicitar acesso e começar com uma suíte de smoke tests de UI que cubra fluxos críticos, por exemplo onboarding, checkout e recuperação de senha. Isso entrega aprendizado rápido sobre estabilidade, consumo e cobertura, sem colocar todo o pipeline em risco.

![Ambiente de desenvolvimento com editor de código aberto]

Como se compara a outras abordagens

O atrativo do Claude Code com computer-use está na convergência entre geração de código e validação visual no mesmo agente. Em comparação com pipelines clássicos, que alternam entre geração assistida, execução de testes headless e validação manual, o agente fecha o laço e devolve evidências da tela. Na imprensa especializada, o discurso recorrente é que o Claude pode “usar seu computador” quando integrações falham, o que o diferencia de assistentes que dependem exclusivamente de APIs.

Do ponto de vista de benchmarks e pesquisa, a área de agentes que manipulam GUIs vem acelerando e, ainda que resultados laboratoriais variem, a tendência aponta para ganhos nos modelos mais recentes com tarefas de desktop e web. Em paralelo, trabalhos acadêmicos ressaltam vulnerabilidades e margens de erro em ambientes híbridos web–OS, o que reforça a orientação de tratar a adoção produtiva como um programa de engenharia de confiança, não apenas como um plugin de conveniência.

Uma comparação útil é com estratégias puramente de browser automation ou com suites de testes de snapshot. O computer-use consegue, por exemplo, validar atalhos de teclado, foco entre janelas, mudanças de escala de fonte do sistema e gestos fora do DOM, cenários que frameworks de teste web tradicionais não cobrem bem sem extensões nativas. Isso não substitui testes unitários e de API, complementa onde eles não chegam.

Como começar com segurança e obter valor rápido

- Definir escopo mínimo viável. Mapear três a cinco jornadas de UI críticas para o negócio e escrever roteiros objetivos com critérios de sucesso claros. Medir taxa de sucesso, tempo por execução e bugs pegos que não apareceram nos testes headless.

- Isolar o ambiente. Executar o agente em sandbox dedicado, com permissões reduzidas, diretórios de trabalho específicos e bloqueios de apps que não fazem parte do escopo de teste.

- Controlar permissões. Se o auto mode estiver disponível, manter thresholds conservadores no início e revisar logs de ações geradas, especialmente em tarefas longas e suscetíveis a ambiguidades.

- Padronizar evidências. Solicitar sempre screenshots nomeadas por etapa e logs de comando, anexando ao artefato de build para auditoria futura. Quanto mais determinístico, mais fácil de comparar entre execuções.

- Ajustar a suíte. Quando o agente falhar por instabilidades da UI, revisar os anchors, os tempos de espera e a redundância de checagens visuais. Dropdowns e barras de rolagem são casos conhecidos que pedem tolerâncias maiores.

- Rodar um piloto de 4 a 6 semanas. Estabelecer OKRs táticos, como reduzir 20 por cento do retrabalho de bugs de UI pós-merge e aumentar em 30 por cento a detecção de regressões visuais antes do QA manual. Encerrar com retro e plano de rollout.

Reflexões e insights ao longo do caminho

Vale encarar a chegada de testes de UI via computer-use no Claude Code como um passo em direção a equipes mais enxutas, com agentes assumindo o trabalho chato de verificação visual. Não é uma bala de prata. Em prévia de pesquisa, o recurso ainda apresenta arestas, desde flutuações de disponibilidade até a necessidade de engenharia de segurança para evitar ações fora do escopo. Mesmo assim, o ganho de ciclo curto, escrever, executar, observar, corrigir, seduz quem mede lead time e custo de defeitos em produção.

Outro ponto é cultural. A autonomia crescente, como no auto mode, pressiona processos de revisão. O equilíbrio produtivo surge quando o time estabelece guardrails claros, monitoramento, e critérios de “stop” para ações com potencial de risco. A prévia de pesquisa existe para isso, para colocar o recurso em mãos de usuários avançados, recolher dados de uso e iterar rápido antes de uma liberação mais ampla.

Conclusão

A entrada de testes de UI via computer-use no Claude Code não é só um checkbox de feature. É um aceno a um ciclo mais completo, em que o mesmo agente que gerou código confirma visualmente que o fluxo cumpre o que o negócio espera. O valor aparece quando times definem alvos pragmáticos, medem o que muda e aceitam que, por enquanto, é um recurso em prévia com oscilações próprias dessa fase.

Para quem está em Pro ou Max, o melhor próximo passo é um piloto contido, mirando jornadas críticas e instrumentadas, com segurança por padrão e logs ricos. O que vier depois, seja ampliar cobertura, mover parte do QA visual para agentes ou integrar evidências no pipeline, fica muito mais fácil quando o aprendizado inicial já foi consolidado com dados e não só com demos.