ByteDance lança Seed 2.0 em Pro, Lite e Mini com multimodal

Seed 2.0 chega em três tamanhos, Pro, Lite e Mini, com upgrades de entendimento multimodal, raciocínio e recursos de agente para executar fluxos complexos do mundo real, com API disponível via Volcengine

Danilo Gato

Autor

Introdução

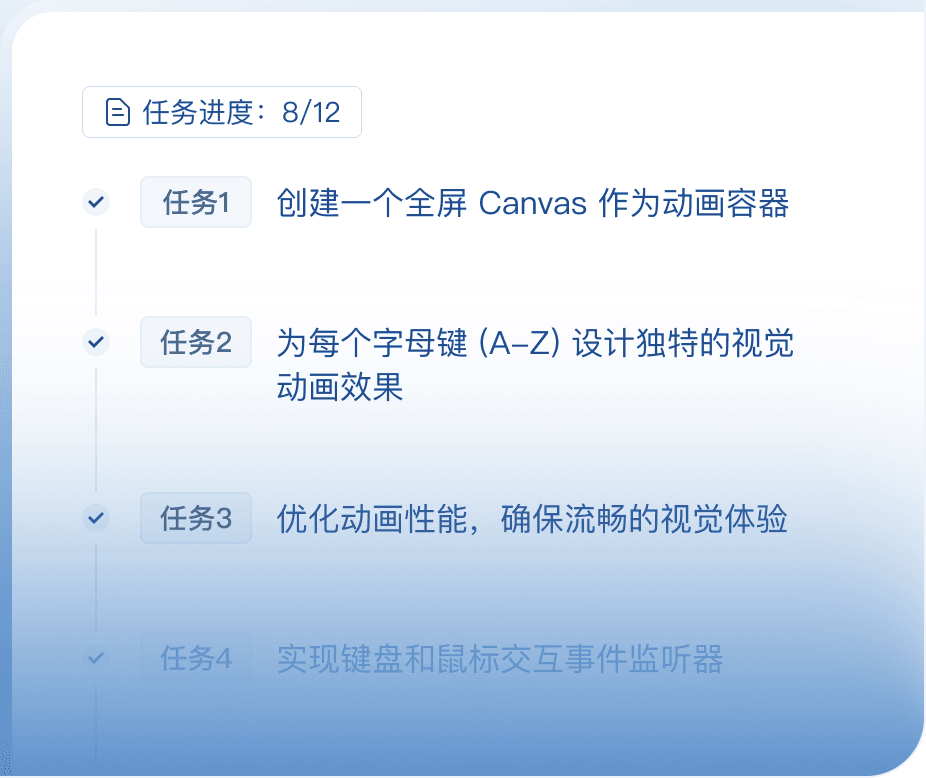

ByteDance lançou o Seed 2.0 em três versões, Pro, Lite e Mini, com capacidades multimodais atualizadas e foco explícito em agentes capazes de tocar fluxos longos no mundo real. A página oficial descreve ganhos em visão, percepção temporal, instrução e execução de tarefas complexas, com benchmarks como MathVision, MotionBench, MMLU‑Pro e SuperGPQA posicionando o Seed 2.0 entre os primeiros colocados da indústria.

O lançamento inclui API pública via Volcengine, além de pontos de entrada para testes nos ecossistemas da própria ByteDance. Para quem precisa colocar um agente multimodal em produção, esse detalhe é decisivo, já que reduz o tempo entre POC e rollout.

Seed 2.0 em foco: o que realmente mudou

Seed 2.0 não é apenas um upgrade de tamanho de modelo. A proposta é ampliar o espectro de tarefas onde um agente consegue raciocinar, perceber contexto visual dinâmico, seguir instruções e acionar ferramentas, sem colapsar em cadências longas. Na página de produto, a ByteDance destaca quatro saltos práticos: melhoria acentuada em raciocínio visual e percepção, melhor compreensão de tempo e movimento em cenas, obediência de instruções mais estável e avanço em avaliações de agentes para tarefas reais.

O card do produto detalha três perfis complementares. Seed 2.0 Pro foca cadeias longas e estabilidade em cenários complexos. Seed 2.0 Lite busca equilíbrio entre qualidade e latência, indicado como base de produção generalista. Seed 2.0 Mini prioriza throughput e densidade de implantação, pensado para alta concorrência e lotes de geração. Essa segmentação permite calibrar custo, tempo de resposta e capacidade de raciocínio conforme a aplicação.

![Seed 2.0 Pro, imagem oficial do produto]

Do ponto de vista de métricas, a ByteDance aponta ganhos em benchmarks variados. Há menções a SOTA em MathVision, liderança em cenários com dinâmica temporal em MotionBench e evolução em instrução e tarefas de agente, além de resultados apresentados lado a lado com modelos como GPT e Gemini em quadros comparativos internos. Para quem avalia adoção, a mensagem é clara, Seed 2.0 sobe o teto de raciocínio e mantém a mão firme em percepção e execução.

Arquitetura multimodal e implicações para produtos

Uma diferença estratégica do Seed 2.0 está no reforço de visão, áudio e vídeo como entradas para uso em tempo real. A própria família Seed vem, há trimestres, expandindo de LLM para VLM e agent, com a linha Seed 1.8 marcando a virada para um modelo explicitamente agente, com busca, código e GUI agents nativos. O Seed 2.0 dá sequência a essa trajetória com compreensão multimodal mais ampla e estável.

Na prática, isso habilita fluxos que vão muito além do chat. Exemplos oficiais indicam desde leitura e reconstrução de layouts web a partir de uma imagem, geração de código front end executável, orientação interativa tipo coach de exercícios baseado em vídeo e leitura robusta de gráficos e documentos ricos. Quando unidos a um executor de ferramentas, esses blocos permitem que um agente extraia dados de um PDF real, interprete um gráfico complexo e opere uma interface gráfica para completar uma tarefa sem intervenção humana.

Pro, Lite e Mini, quando usar cada um

- Seed 2.0 Pro, escolha quando a cadeia de raciocínio é longa, a tarefa é frágil a erros e há múltiplos passos com percepções visuais ou temporais. Casos típicos incluem diagnóstico de documentos não estruturados, automação que combina visão de tela com navegação de GUI e workflows de engenharia assistida por IA.

- Seed 2.0 Lite, equilíbrio entre qualidade e latência para produtos de escala que exigem agente generalista com bom custo por requisição, por exemplo, copilotos de atendimento com leitura de anexos, triagem de e‑mails com tabelas e imagens ou rotinas de QA multimodal.

- Seed 2.0 Mini, indicado para throughput e cenários de alta concorrência, como lotes de extração de campos em imagens de documentos similares, validação de formulários digitalizados ou geração em massa de respostas com percepção visual básica.

![Seed 2.0 Mini, imagem oficial do produto]

Benchmarks e o que eles sugerem sobre maturidade

A ByteDance cita resultados elevados em trilhas como MMLU‑Pro, SuperGPQA, HealthBench e conjuntos focados em visão e lógica, por exemplo MathVision, LogicVista e VisuLogic. Em matemática competitiva, aparecem scores em AIME 2025 e 2026 e listas como HMMT, além de conjuntos internos que a equipe Seed já vinha utilizando em pesquisas anteriores. Ainda que quadros de comparação internos devam ser lidos com cautela, o padrão de evolução entre Seed 1.8 e Seed 2.0 é consistente em raciocínio, visão e instruções. Para times técnicos, isso indica maior previsibilidade em tarefas multipasso.

Vale lembrar que a equipe Seed publicou, em 2025, trabalhos de raciocínio avançado com reforço, inclusive apresentando benchmarks internos como BeyondAIME. Essa linha de pesquisa ajuda a explicar parte dos ganhos reportados agora, especialmente em tarefas STEM e em generalização de raciocínio para domínios não triviais.

Casos de uso reais, do CAD ao entendimento de documentos

Os exemplos de aplicação listados na página oficial dão um recorte útil do que funciona na prática. Há demonstrações de CAD com FreeCAD, onde o agente constrói um modelo paramétrico de duplo ressalto e ainda extrai parâmetros geométricos. Em biotecnologia, aparecem cenários de apoio a pesquisa, enquanto em computação quântica, a referência ao algoritmo de Solovay‑Kitaev sugere que o agente consegue navegar por passos técnicos densos com checagens intermediárias. Para operações, o destaque são workflows de longa duração com estabilidade.

Em entendimento de documentos, Seed 2.0 indica ganhos em ChartQAPro e OmniDocBench 1.5, e em contexto longo multimodal com DUDE, MMLongBench e MMLongBench‑Doc. Isso é especialmente relevante para back‑offices que lidam com PDFs irregulares, planilhas embutidas como imagens e relatórios com gráficos complexos. Um agente que lê, extrai, valida e aciona outras ferramentas reduz refações e acelera TAT de processos sensíveis a SLA.

Como começar, caminhos de acesso e API

A atualização incluiu liberar o acesso por API via Volcengine, com menções diretas à console e a um ambiente de experimentação. Para testes rápidos, o caminho oficial passa pelos apps do ecossistema ByteDance, como Doubao, e por seleção de modelos Seed 2.0 em ambientes de desenvolvimento internos. Para integração em produto, a recomendação é iniciar pela API do Volcengine, estruturando um orquestrador de agentes que contemple ferramentas de busca, código e GUI, além de limites de contexto visual.

Um roteiro técnico sensato envolve, primeiro, definir os jobs mais críticos onde percepção visual e raciocínio longo trazem alavanca real. Em seguida, validar prompts estruturados com checagem de passos, configurar chamadas a ferramentas confiáveis e estabelecer políticas de fallback. Por fim, medir custo, latência, taxa de sucesso e taxa de intervenção humana por tipo de tarefa, comparando Pro, Lite e Mini para calibrar SLA e custo por transação. Esses critérios ajudam a decidir quando vale pagar pela potência do Pro ou quando o Lite ou Mini já entregam o suficiente.

Comparativo estratégico, onde Seed 2.0 se posiciona

O Seed 1.8 já havia sinalizado a visão de agent first. A evolução para o Seed 2.0 amplia cobertura de tarefas e adiciona profundidade em visão e lógica, o que empurra o modelo para cenários de chão de fábrica digital, como RPA de nova geração, copilotos com visão para sistemas legados e automação científica assistida. Em mercados onde custo e latência são tão importantes quanto acurácia, a presença do Lite e do Mini cria alternativas de implantação que nem sempre existem em modelos rivais.

Do ponto de vista de governança, o passo da API pública também é relevante. Disponibilidade formal via plataforma de nuvem acelera adoção corporativa, já que resolve identidade, limite de uso, faturamento e observabilidade. Em paralelo, o ecossistema Seed segue publicando componentes de pesquisa multimodal, como o Seedream para imagem, o que sugere uma estratégia de unificação gradual de capacidades sob a família Seed, com ganhos que acabam retroalimentando o agente.

Reflexões e insights práticos

- Racionalizar onde multimodal é obrigatório. Em muitos fluxos, texto puro resolve 80 por cento. O valor do Seed 2.0 aparece justamente nos 20 por cento com arquivos desestruturados, imagens de baixa qualidade, vídeos curtos de interface e quadros que exigem percepção temporal. Nesses casos, o ganho de throughput e a queda de retrabalho pagam o investimento.

- Tratar o agente como um executor que precisa de ambiente. Seed 2.0 brilha quando tem ferramentas estáveis por perto, como buscadores internos, runtimes de código e automação de GUI. Sem isso, parte do potencial fica preso no modelo.

- Medir sucesso além de acurácia. Em operações, taxa de intervenção humana, tempo até conclusão e custo por caso dizem mais sobre ROI do que uma métrica de benchmark isolada. Usar Pro, Lite e Mini como knobs de engenharia ajuda a chegar nesse ponto ótimo.

Riscos e limites, como mitigar

Como todo modelo multimodal de larga escala, Seed 2.0 herda desafios de grounding visual, vieses em dados e fragilidade em instruções ambíguas. Os próprios benchmarks citados pela ByteDance incluem trilhas que testam viés e cegueira em VLMs, sinalizando atenção a esse ponto. Em produção, vale impor verificações de consistência, guardar logs de decisão do agente e criar sandboxes de ferramenta com escopos bem definidos.

Em privacidade e compliance, a adoção via nuvem pede revisão de políticas de retenção e criptografia, além de delimitar conjuntos sensíveis que exigem red teaming constante. Para fluxos com dados de saúde ou PII, mapear requisitos regulatórios antes do rollout evita retrofits caros. Essas práticas valem para qualquer LLM agent corporativo e não são exclusivas da ByteDance, mas fazem toda a diferença no sucesso do projeto.

Conclusão

Seed 2.0 chega como uma família de agentes multimodais orientada a produção, com versões Pro, Lite e Mini que cobrem de fluxos de alta complexidade a lotes de alta concorrência. O reforço em visão, lógica e execução, confirmado por benchmarks e exemplos de casos, indica maturidade para uso em cenários corporativos exigentes, desde entendimento de documentos ricos até automação de GUI em sistemas legados. A disponibilidade via API no Volcengine ajuda a encurtar o caminho entre protótipo e operação.

O momento favorece quem transforma o agente em operador confiável de processos, não só em copiloto que sugere respostas. Com um desenho de arquitetura que combine ferramentas, observabilidade e governança, Seed 2.0 pode reduzir custos, acelerar SLAs e abrir espaço para novas experiências multimodais, em especial onde a percepção visual fina e o raciocínio longo fazem diferença direta no resultado do negócio.