Google Cloud, adversários usam IA para zero-day e malware

Relatório do Google Threat Intelligence revela exploração de zero-day apoiada por IA, evolução de malware e novas rotas de acesso inicial, com impactos práticos para times de segurança.

Danilo Gato

Autor

Introdução

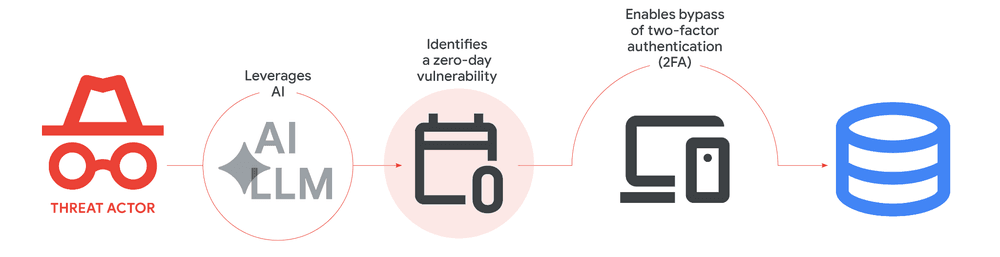

Adversários usam IA para zero-day e malware. O Google Threat Intelligence Group relatou em 11 de maio de 2026 a primeira evidência de um grupo criminoso preparando a exploração em massa de uma vulnerabilidade zero-day desenvolvida com suporte de modelos de IA, caso que foi interrompido em coordenação com o fornecedor afetado. Entre os pontos mais preocupantes, o time observou o uso de IA para descoberta de falhas, geração de exploits e evolução de malware com obfuscação dinâmica, além de novas rotas de acesso inicial em ambientes de IA.

Esse movimento importa porque sinaliza a passagem do uso experimental para operações em escala industrial. A mesma classe de modelos que acelera a correção de bugs e a resposta a incidentes também está ajudando invasores a pesquisar CVEs, construir payloads confiáveis e contornar verificações, com impacto direto em superfícies críticas como ferramentas DevOps, cadeias de suprimentos de pacotes e integrações que conectam modelos a dados sensíveis.

Ao longo deste artigo, o foco está em quatro frentes, como os adversários estão explorando vulnerabilidades e gerando exploits com IA, como o malware está mudando com suporte de modelos, por onde vem o acesso inicial em ambientes que usam IA, e o que times de segurança podem fazer agora para reduzir exposição.

Como a IA está ajudando a explorar vulnerabilidades e criar zero-days

O relatório do GTIG traz um caso emblemático, um plano de exploração em massa onde um zero-day foi transformado em script Python para burlar 2FA em uma ferramenta de administração web de código aberto. O código exibia traços característicos de saída de LLMs, como docstrings didáticos, um score CVSS alucinado e formatação limpa com menus de ajuda, sinalizando forte probabilidade de uso de modelo de IA na descoberta e weaponization. O fornecedor foi notificado e a atividade foi interrompida.

Há dois pontos técnicos com implicações amplas. Primeiro, essa classe de falha não deriva de corrupção de memória, mas de erros semânticos de lógica que escapam a scanners tradicionais. Segundo, fronteiras entre pesquisa defensiva e ofensiva ficam mais porosas quando a mesma competência de raciocínio do modelo, que ajuda revisões de código, também correlaciona fluxos de autenticação e detecta inconsistências ocultas. Isso explica por que adversários enviam milhares de prompts automatizados para iterar PoCs e validar confiabilidade do exploit antes do uso real.

Para times defensivos, a leitura prática é clara. Investir em análises de lógica de autorização, testes de hipóteses com foco em caminhos de exceção e validações de MFA fora do caminho feliz. Introduzir geração de casos adversariais assistida por IA nos pipelines de revisão, não para cobrir tudo, mas para aumentar a chance de revelar contradições de regra de negócio. Complementar com SAST e fuzzing, adotando gates de aprovação que exijam cenários multi-ator, por exemplo, usuário legítimo com sessão ativa, tentativa de MFA e alteração de contexto de rede que deveria invalidar tokens.

![Diagrama de fluxo de pesquisa e weaponization com IA]

Malware com IA, obfuscação dinâmica e engenharia de infraestruturas

O GTIG descreve a aceleração do desenvolvimento de suítes de infraestrutura e malware polimórfico. Modelos estão sendo usados para gerar decoys de código, produzir cargas dinamicamente e até sustentar ferramentas de gestão para ORB networks com múltiplos saltos, reduzindo visibilidade de defesas e dificultando engenharia reversa. Em campanhas ligadas a atores de Rússia, foram observados artefatos que injetam trechos gerados por LLM para camuflar funcionalidades maliciosas.

Esse uso não cria uma nova família mágica de malware, mas barateia etapas demoradas. Pensa em gerar variações de ofuscação sob demanda, deslocando assinaturas e tornando IOC menos estável. Em ambientes onde detecção depende de similaridade sintática, adversários ganham agilidade suficiente para romper detecções baseadas em regras frágeis. O caminho é reforçar detecções comportamentais, vigilância a padrões anômalos de alocação de recursos em cloud e uso de linguagens incomuns no repositório interno, combinando com análises de dependências que caçam imports e chamadas de rede indevidas.

Há um contraponto importante. O próprio ecossistema Google cita uso de agentes e raciocínio de modelos para reforçar defesa, da descoberta de vulnerabilidades com agentes a automações de correção auxiliadas por Gemini, reforçando que a assimetria não é absoluta. Equipes que acoplam modelos a telemetria de CI, código e eventos de runtime começam a fechar janelas de exploração ao transformar triagem e remediação em loops rápidos.

Acesso inicial, a nova superfície das cadeias de IA

A porta de entrada preferida não é hackear o núcleo de um LLM. O que escala são táticas conhecidas aplicadas ao ecossistema de IA, como comprometer pacotes PyPI, abrir PRs maliciosos em repositórios populares e plantar arquivos de configuração trojanizados em projetos que integram modelos por meio de SDKs. O GTIG cita o grupo TeamPCP, associado a comprometimentos de pacotes e PRs para exfiltrar segredos de builds, monetizando chaves de nuvem e tokens por meio de parcerias com grupos de extorsão.

Outra frente é o acesso clandestino e premium a modelos, via middleware profissionalizado e automação de cadastros que dribla CAPTCHA e verificação por SMS. Isso subsidia operações em larga escala, com contas descartáveis e revezamento programático. Em paralelo, atores usam LLMs para pesquisa de vítimas e criação de iscas mais convincentes para phishing direcionado, integrando as duas frentes, aquisição de capacidade e entrada inicial.

A implicação tática é traduzir taxonomias de ataque tradicionais para o stack de IA, mapeando controles para risco de IIC, componentes integrados inseguros, e RA, ações desonestas, conforme a própria taxonomia SAIF, e adicionando trilhas de auditoria fortes quando modelos acionam skills com autonomia limitada e revisões humanas por padrão.

![Esquema de componentes de risco e acesso inicial em IA]

Tendências recentes, da interrupção de campanhas a novos modelos para defesa

A cobertura jornalística alinhada ao relatório indica que o caso de zero-day assistido por IA ganhou atenção pública em 11 de maio de 2026, com a empresa relatando a interrupção de uma tentativa de exploração por um grupo criminoso, reforçando a leitura de que o período de experimentos deu lugar a operações reais com impacto potencial em larga escala.

Em paralelo, fornecedores de modelos têm liberado variantes com foco em segurança para times defensivos, com acesso governado e faixas de uso que tentam equilibrar utilidade e mitigação de abuso. Relatos recentes descrevem o lançamento de um modelo voltado a cibersegurança, pensado para apoiar escrita de PoCs controladas e simulações defensivas, parte de um esforço maior de acesso confiável e testes de capacidade e segurança antes de ampliar disponibilização.

Esses movimentos coexistem com avaliações de risco elevadas para categorias como cibersegurança quando se trata de modelos cada vez mais persistentes e capazes, o que pressiona governança, detecção de uso abusivo e limites operacionais. Para equipes técnicas, a mensagem não é pânico, e sim amadurecimento de controles, com monitoramento do comportamento dos modelos e das integrações que os cercam.

Casos, exemplos e o que aplicar agora

- Cadeia de suprimentos de IA, reforço imediato de SCA e escaneamento de pacotes, incluindo verificação comportamental que avalia chamadas de rede, execução de shell e importações suspeitas em SDKs de IA. O relatório menciona integração entre marketplace de skills e análise automática de comportamento para reduzir risco de publicação maliciosa, uma boa referência de arquitetura defensiva.

- Zero-day com lógica semântica, criar playbooks de revisão de fluxo de autenticação, incluindo testes que simulam exceções e estados inválidos, e adicionar verificações de coerência entre camadas, como servidor, gateway e serviço de identidade, para evitar que exceções bypass de 2FA passem sem auditoria.

- Polimorfismo assistido por IA, privilegiar detecções centradas em comportamento, como variação anômala de tempo de execução, padrões de build incomuns e perfis de rede que mudam conforme o código é alterado dinamicamente, reduzindo a dependência de assinaturas frágeis.

- Obtenção clandestina de acesso a LLMs, bloquear automação de criação de contas com validações de prova de humanidade que combinem risco de dispositivo com telemetria do navegador, além de detecção de pipelines de registro em massa e revezamento de contas.

Métricas de prontidão e engenharia de plataforma

Metas pragmáticas para 90 dias que cabem no backlog de uma equipe de plataforma, sem refatorações gigantes.

- Governança de chaves e conectores. Catalogar e rotacionar credenciais usadas por SDKs de IA, reforçando limites de escopo e TTL. Configurar alertas para uso fora do horário de expediente e regiões não padronizadas. Mapear caminhos por onde modelos tocam dados sensíveis e impor revisões humanas para ações destrutivas.

- Análise de PRs e pacotes com política zero trust. Passar a exigir análises estáticas e dinâmicas para pacotes de IA e PRs que mudem dependências. Bloquear builds quando análise comportamental identificar chamadas de rede não declaradas ou escrita de arquivos fora dos diretórios esperados.

- Testes de lógica de autenticação orientados por hipóteses. Instrumentar testes que verifiquem coerência entre MFA, sessão e contexto, incluindo expiração de tokens em mudanças de IP, dispositivo e geolocalização.

- Telemetria e guardrails para uso defensivo de modelos. Ao adotar modelos para apoiar triagem, correção e hunting, habilitar logging de prompts e outputs, revisão por pares para uso de PoCs, bloqueio de downloads de binários e simulações em ambientes isolados.

- Indicadores de abuso de LLM como fonte de capacidade. Criar sinalizadores de tráfego e de automação para detectar pipelines de registro, verificar padrões de criação de contas, reuso de dispositivos virtuais e pagamentos suspeitos.

Ferramentas e integrações que ajudam

- Integrações de análise comportamental em marketplaces e repositórios internos. O caso de integração de varredura automática de código malicioso em marketplace público de skills mostra um padrão útil para qualquer organização com catálogo interno de componentes de IA, automatizar inspeção e bloquear publicação quando comportamento foge ao esperado.

- Uso de agentes e modelos para defesa. A mesma tecnologia que ajuda ofensores pode encurtar ciclos de correção e criar pipelines de melhoria contínua em segurança de aplicação, desde que operada com limites, aprovação humana e telemetria forte.

- Modelos com acesso governado para cibersegurança. Opções recentes para times defensivos priorizam workflows legítimos, como geração de PoCs controladas e simulações, com camadas de acesso confiável que restringem abuso e permitem auditoria.

Políticas de resposta e comunicação

Quando incidentes envolvem IA, a narrativa precisa ser objetiva. Se a falha surge de lógica de autenticação, comunicar o escopo do impacto, o caminho de exploração e os tempos de correção por ambiente. Se o vetor foi cadeia de suprimentos de IA, publicar indicadores de comprometimento úteis para a comunidade, instruções de mitigação e prazos claros de hardening. Esse tipo de comunicação reduz assimetria, desestimula exploração de copycats e acelera aprendizado coletivo. Casos recentes mostram que a transparência sobre interrupção de campanhas e coordenação com fornecedores gera efeito de dissuasão.

Reflexões e insights

- IA mudou o gargalo da ofensiva. O problema não é só capacidade de gerar código, é a velocidade de iteração e a automação de estudos de caso que tradicionalmente exigiam semanas de tentativa e erro.

- Cadeia de IA é o novo perímetro. Onde há conectores, skills e pacotes, há superfícies de supply chain. Os controles precisam existir no ponto de publicação, no build e no runtime.

- Defesa também escala com IA. Equipes que conectam modelos a telemetria e impõem revisão humana nos atos sensíveis estão acelerando a resposta sem abrir mão de governança.

Conclusão

O quadro traçado pelo GTIG indica uma virada de chave. Adversários usam IA para zero-day e malware, com sinais claros de industrialização, desde a automação de pesquisa de CVEs até o acesso clandestino a modelos premium. O acesso inicial está migrando para onde a fricção é menor, cadeias de suprimentos de IA e integrações que concedem poderes reais aos modelos. Times de segurança que internalizam esse mapa de riscos conseguem priorizar melhor, proteger dados sensíveis e reduzir a janela útil para ataque.

O caminho prático está em três frentes. Reforçar lógica e autenticação com testes adversariais orientados por hipótese. Blindar a cadeia de suprimentos de IA com análise comportamental, revisão de dependências e políticas zero trust em PRs e pacotes. Adotar modelos para defesa, com guardrails e telemetria robusta, encurtando a distância entre detecção, análise e correção. Esse equilíbrio entre velocidade e controle define quem transforma a IA em vantagem competitiva de segurança.