Kling AI lança Kling 3.0 para produção de vídeo multimodal

Kling 3.0 chega com entrada e saída multimodais, áudio nativo em vários idiomas, consistência reforçada e vídeos de até 15 segundos, trazendo controle narrativo e storyboard avançado para criadores e equipes.

Danilo Gato

Autor

Introdução

Kling 3.0 é a aposta mais recente da Kling AI para consolidar a produção criativa de vídeo com um modelo realmente multimodal, unindo texto, imagem, áudio e vídeo em um único fluxo. A empresa anunciou a série 3.0 com quatro modelos, Video 3.0, Video 3.0 Omni, Image 3.0 e Image 3.0 Omni, destacando maior consistência visual, saída mais fotorrealista, duração estendida para até 15 segundos e geração de áudio nativa em múltiplos idiomas.

O avanço não é apenas incremental. Segundo os comunicados oficiais, o 3.0 integra tarefas como texto para vídeo, imagem para vídeo, referência para vídeo e edição dentro do próprio vídeo em uma arquitetura nativamente multimodal. Isso viabiliza narrativas mais complexas, controle preciso de planos e maior aderência ao prompt, reduzindo retrabalho e aproximando o fluxo de IA do processo de direção.

Este artigo destrincha o que muda com o Kling 3.0, como o Video 3.0 Omni expande o controle de referência e storyboard, onde o modelo se posiciona frente a rivais como Sora e Veo, e quais estratégias práticas equipes de marketing, estúdios e criadores podem adotar hoje para transformar ideias em vídeos prontos para publicação.

O que há de novo no Kling 3.0

A principal mudança do Kling 3.0 está na unificação multimodal. O conjunto suporta entrada e saída em texto, imagens, áudio e vídeo, o que permite entender, gerar e editar conteúdo dentro de um único pipeline. Em termos práticos, fluxos que antes exigiam múltiplas ferramentas, por exemplo roteirizar, gerar clipes, ajustar cenas e inserir som, passam a acontecer de forma coordenada. Esse desenho é sustentado por um framework de treinamento unificado que dá ao modelo mais contexto e coerência entre cenas.

O salto de consistência é outro ponto crítico. O Video 3.0 melhora a manutenção de personagens, objetos e cenários ao longo dos frames, inclusive quando se usa múltiplas imagens de referência e até um vídeo de referência para ancorar aparência e características. Para publicidade e e‑commerce, a capacidade de preservar texto em elementos visuais, como placas e logos em roupas, reduz retrabalho de pós e evita artefatos.

Em duração, o Kling 3.0 gera vídeos nativos de até 15 segundos. Esse teto abre espaço para planos mais longos e transições mais suaves, com narrativa curta porém completa, sem a necessidade de costurar múltiplos clipes. Para equipes que trabalham com anúncios curtos e teasers, 15 segundos é um ponto de eficiência, equilibrando tempo de geração e impacto visual.

Por fim, a geração de áudio nativa traz vozes, ruídos de ambiente e trilha coerentes com o vídeo, com suporte para inglês, chinês, japonês, coreano e espanhol, além de sotaques e dialetos. Isso significa menos ida e volta com ferramentas de dublagem e efeitos, e sincronização mais natural, inclusive para diálogos com múltiplos personagens falando idiomas diferentes.

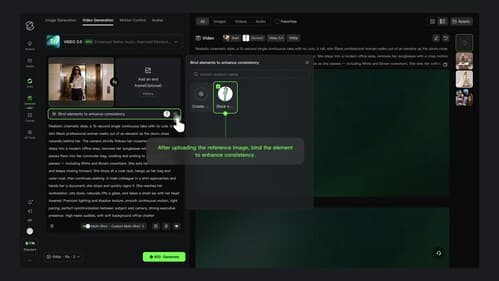

![Interface do Kling 3.0 com destaque de consistência por referência]

Video 3.0 Omni e o storyboard multi‑shot

O Video 3.0 Omni é a peça pensada para controle máximo. O modelo amplia a lógica de “Elementos” do Kling Video O1 e permite subir um vídeo de referência para extrair traços visuais e características de voz de um personagem, mantendo‑os em novas cenas. Isso é útil para campanhas sempre ativas, séries curtas e universos de marca, em que coerência de figurino, traços faciais e voz valem mais do que efeitos isolados.

O recurso de storyboard multi‑shot é outro diferencial. Ele possibilita montar uma sequência com vários planos dentro de um único vídeo, especificando duração, tamanho do plano, perspectiva, conteúdo narrativo e movimento de câmera em cada tomada. Em vez de gerar clipes desconexos, cria‑se uma mini sequência cinematográfica com controle de ritmo e linguagem de câmera.

Na prática, pense em três cenários comuns. Primeiro, um produto tech sendo apresentado, com plano detalhe do hardware, corte para o uso no cotidiano e fechamento com call to action em tela, tudo dentro de 12 a 15 segundos, com logo e tipografia nítidas. Segundo, um fashion film curto com tracking suave, troca de ambientes e direção de olhar consistente. Terceiro, um teaser de jogo com variação de planos, objetos recorrentes e efeitos sonoros alinhados à ação. O Omni foi desenhado exatamente para essas rotinas.

![Storyboard multi‑shot no Video 3.0 Omni]

Imagem 3.0 e 3.0 Omni, preparando cenas e assets

O pacote 3.0 também cobre imagem, útil para pré‑visualização de cenas, concept art e assets de produção. Segundo a Kuaishou, as versões Image 3.0 e Image 3.0 Omni entregam saídas em 2K e 4K, com preservação de texturas, iluminação e materiais. Em pipelines que combinam imagem estática para aprovar direção de arte e vídeo curto para validar movimento e ritmo, essa dupla acelera a ida de conceito a execução.

Esse caminho dialoga com a trajetória recente da Kling AI, que já vinha apostando em unificação com o Kling O1, modelo anunciado como um dos primeiros a consolidar tarefas criativas multimodais em um motor único. A base conceitual, chamada de Multimodal Visual Language, sustenta o foco em consistência de personagens e props em cenas complexas, algo que historicamente penalizava os modelos de vídeo.

Onde o Kling 3.0 se posiciona no mercado

O mercado de geração de vídeo avança em duas frentes. De um lado, modelos com cenas longas e qualidade hiper‑realista, caso de concorrentes como Sora e Veo, que disputam benchmarks e mindshare há mais tempo. De outro, soluções voltadas a controle narrativo curto, multi‑cenas e velocidade de iteração para social e publicidade. Kling 3.0 se posiciona nessa segunda via com força, especialmente por causa do storyboard multi‑shot e do áudio nativo.

Sinais de adoção ajudam a entender o impacto. A Kuaishou indica que, desde junho de 2024, a Kling AI atende mais de 60 milhões de criadores, com mais de 600 milhões de vídeos gerados e mais de 30 mil clientes corporativos. O 3.0 está em acesso antecipado para assinantes Ultra e deve ser liberado ao público em seguida, algo que costuma acelerar feedback e tração de recursos.

Esse movimento não vem de um vácuo. Em 2025, a Kling já destacava upgrades na linha 2.x, preços mais acessíveis em 2.5 Turbo e integração com modelos de linguagem para auxiliar na criação de prompts e estrutura de cena, reduzindo barreiras para novos usuários. O pano de fundo reforça a estratégia de tornar a produção guiada por IA mais controlável, estável e consistente.

Áudio nativo e multilingue, por que isso importa

Em fluxos tradicionais, som costuma atrasar o projeto. A necessidade de buscar locução, sincronizar boca, adicionar efeitos e calibrar ambiente estende prazos. O Kling 3.0 reduz esse atrito ao gerar fala, efeitos e ambiência junto com o vídeo, em múltiplos idiomas e sotaques. Para marcas globais, o benefício é direto, produzir uma versão em inglês com sotaque americano e outra com sotaque britânico, sem refazer a peça. Em narrativas com vários personagens, cada um pode falar um idioma diferente com lip sync mais natural.

Além do ganho operacional, áudio nativo melhora a prototipação criativa. Mensagens, entonação e ritmo passam a ser validados enquanto a cena nasce. Em equipes enxutas, isso economiza ciclos de aprovação e permite que marketing e produto testem rapidamente variações de roteiro, CTA e tom de voz sem depender de um pipeline separado.

Consistência e preservação de texto, o salto para uso comercial

Consistência não é detalhe estético, é critério de produção. O fato de o Video 3.0 manter elementos entre planos e suportar múltiplas referências, incluindo um vídeo de referência, reduz o risco de personagens mudarem sutilmente a cada corte. Para marcas, a preservação de texto em placas, embalagens e camisetas com logo nítido ao longo do clipe é o que separa uma prova de conceito de uma entrega publicável.

Essa estabilidade também beneficia séries de posts e anúncios com variações semanais. Em vez de recriar um personagem ou estilo do zero, o time reaproveita referências e garante continuidade visual. O Controle por Elementos herdado do O1 e expandido no Omni sustenta exatamente esse tipo de produção recorrente.

Aplicações práticas imediatas

- Social e paid media. Storyboards de 3 a 6 planos em 12 a 15 segundos cobrem do hook inicial ao CTA, com áudio nativo pronto para veiculação. O Omni permite replicar look and feel entre variações criativas, mantendo coerência de marca.

- Pré‑produção audiovisual. Use Image 3.0 e 3.0 Omni para validar direção de arte em 2K e 4K, depois gere versões curtas com Video 3.0 para testar movimento, iluminação e transições antes de reservar estúdio.

- E‑commerce e demonstração de produto. Preservação de texto e consistência de objetos favorecem tutoriais rápidos, unboxings simulados e variações com foco em feature, cada uma com locução e efeitos prontos.

- Conteúdo internacional. Geração multilíngue facilita testes de mercado e personalização por país, acelerando validação de mensagens.

Comparativos e expectativas

Análises de mercado apontam a Kling como um dos principais concorrentes em vídeo gerado por IA, disputando espaço com nomes como Sora e Veo. A cobertura recente destaca que a Kuaishou vem usando eventos e iterações rápidas para sustentar o ritmo, algo que pressiona o setor a oferecer mais controle e qualidade com ciclos curtos.

Ecossistemas terceiros também começam a integrar o Kling entre os modelos disponíveis, permitindo que criadores testem diferentes engines no mesmo fluxo e escolham a mais adequada por tarefa, um sinal de maturidade do mercado de plataformas. Embora iniciativas assim variem ao longo do tempo, a tendência de disponibilizar múltiplos modelos em um só lugar reforça a adoção.

Limitações e pontos de atenção

- Janela de 15 segundos. Embora suficiente para narrativas curtas, projetos que exigem continuidade longa ainda precisarão de costura de clipes ou estratégias de cena por cena.

- Curva de referência. O ganho de consistência depende de referências bem preparadas, com ângulos, iluminação e expressões úteis para generalização. Sem isso, resultados podem variar.

- Políticas e acesso. O 3.0 entrou primeiro em acesso antecipado para assinantes Ultra, portanto recursos podem aparecer gradualmente para o público, com alterações de UI, limites e preços à medida que a abertura avança.

Como extrair valor desde já

- Comece pelo storyboard. Use o modo Omni para estruturar de 3 a 6 planos com funções claras, abertura com gancho, plano de produto ou demonstração, fechamento com CTA. Em seguida, refine duração e movimento de câmera por plano.

- Amarre a identidade. Suba um conjunto de referências, paleta, tipografia e elementos de marca para consolidar estilo. Teste a preservação de texto nos primeiros takes para evitar surpresas em versões finais.

- Valide áudio e idioma cedo. Defina idioma, sotaque e papel de cada voz já no prompt. Ajuste entonação e ordem de falas antes de lapidar visual. Isso reduz retrabalho e dá cadência à narrativa.

- Estabeleça métricas. Compare versões por taxa de conclusão, retenção nos três primeiros segundos e CTR do CTA. A janela de 15 segundos favorece ciclos rápidos de teste A, B e C.

Conclusão

Kling 3.0 cristaliza a tese de que produção de vídeo com IA precisa ir além de gerar um único plano bonito. A unificação multimodal, a consistência em torno de referências e o storyboard multi‑shot criam um ambiente mais próximo do set, com linguagem de câmera, ritmo e áudio caminhando juntos. Para negócios, essa combinação encurta o trajeto entre ideia e entrega publicável.

O mercado seguirá plural, com modelos focados em cenas longas e hiper‑realismo, enquanto o Kling disputa o território de controle narrativo curto e velocidade de iteração. O próximo ano deve ser marcado por integrações e comparativos mais maduros, e quem construir bibliotecas de referência e rotinas de storyboard desde agora terá vantagem quando os recursos se abrirem para todo o público.