LTX Studio lança IA de áudio para vídeo, parceria com ElevenLabs

LTX Studio apresenta geração de vídeo guiada por áudio com parceria exclusiva inicial com a ElevenLabs, conectando voz, música e efeitos a ritmo, cortes e câmera.

Danilo Gato

Autor

Introdução

LTX Studio lançou a sua tecnologia de áudio para vídeo com parceria exclusiva inicial com a ElevenLabs, colocando o som como camada de controle que dirige ritmo, cortes e movimento desde o primeiro frame. A palavra chave aqui é https://x.com/ltxstudio/status/2013650214171877852, porque sintetiza o anúncio e o novo fluxo de criação centrado no áudio. No dia 20 de janeiro de 2026, a Lightricks confirmou que o lançamento começa no LTX e no ElevenLabs Image & Video, com abertura de API e acesso open source programados para 27 de janeiro.

A importância desse passo está na inversão do processo. Em vez de gerar vídeo e depois ajustar o som, o áudio passa a guiar tudo, de pacing a mudança de cena. Isso reduz retrabalho, aproxima intenção e saída e favorece workflows de times que já começam por locução, música ou sound design. Segundo a Lightricks, o modelo interpreta cadência de fala, dinâmica musical e pausas para definir estrutura visual e movimento, e a parceria com a ElevenLabs garante que a geração de áudio e a de vídeo conversem no mesmo pipeline.

Por que a abordagem áudio primeiro muda o jogo

A lógica tradicional sempre tratou áudio como pista separada. Mesmo em sistemas generativos, a trilha entra tarde e depende de prompts, timecodes e edições de sincronização que consomem tempo. A proposta do LTX Studio é deixar o som dirigir a geração desde o início, para que cortes, câmera e acting visual nasçam do que já está embutido na fala ou na música. O próprio anúncio explica que fala define o pacing, energia musical influencia movimento e mudanças de cena acontecem onde o som pede, não onde um prompt supõe.

Na prática, isso favorece prototipagem. Produtoras, publishers e criadores validam rapidamente se uma locução funciona como base de um explainer, se uma faixa musical carrega um videoclipe, ou se efeitos sonoros conseguem acionar animações específicas. O recurso já está ativo no LTX e no ElevenLabs Image & Video a partir de 20 de janeiro de 2026, com liberação mais ampla e acesso por API e modelos abertos no dia 27. Para sequências mais longas, a recomendação é encadear clipes gerados por áudio, mantendo consistência de estilo com imagem de referência e prompt curto.

O que exatamente foi lançado, e onde usar

Segundo a página oficial de produto, o fluxo Audio to Video do LTX aceita arquivo de áudio, captura direta ou áudio gerado no próprio ambiente Gen Space. Depois, o usuário define contexto visual com prompt e, opcionalmente, uma imagem de referência. O sistema processa timing, ritmo e conteúdo para gerar um clipe Full HD cujo comprimento e movimento seguem o áudio, não o contrário. Formatos suportados incluem MP3, WAV, AAC, OGG, MOV e M4A.

Do lado da ElevenLabs, o Studio 3.0 consolida ferramentas de áudio e vídeo com timeline, multilíngue e edição de voz clonada, além de recursos de voz isolator, TTS e dublagem. A integração prática aqui é clara, já que o mesmo ambiente que cria vozes e música agora encaixa a etapa de vídeo orientada por áudio como parte do mesmo pipeline de produção.

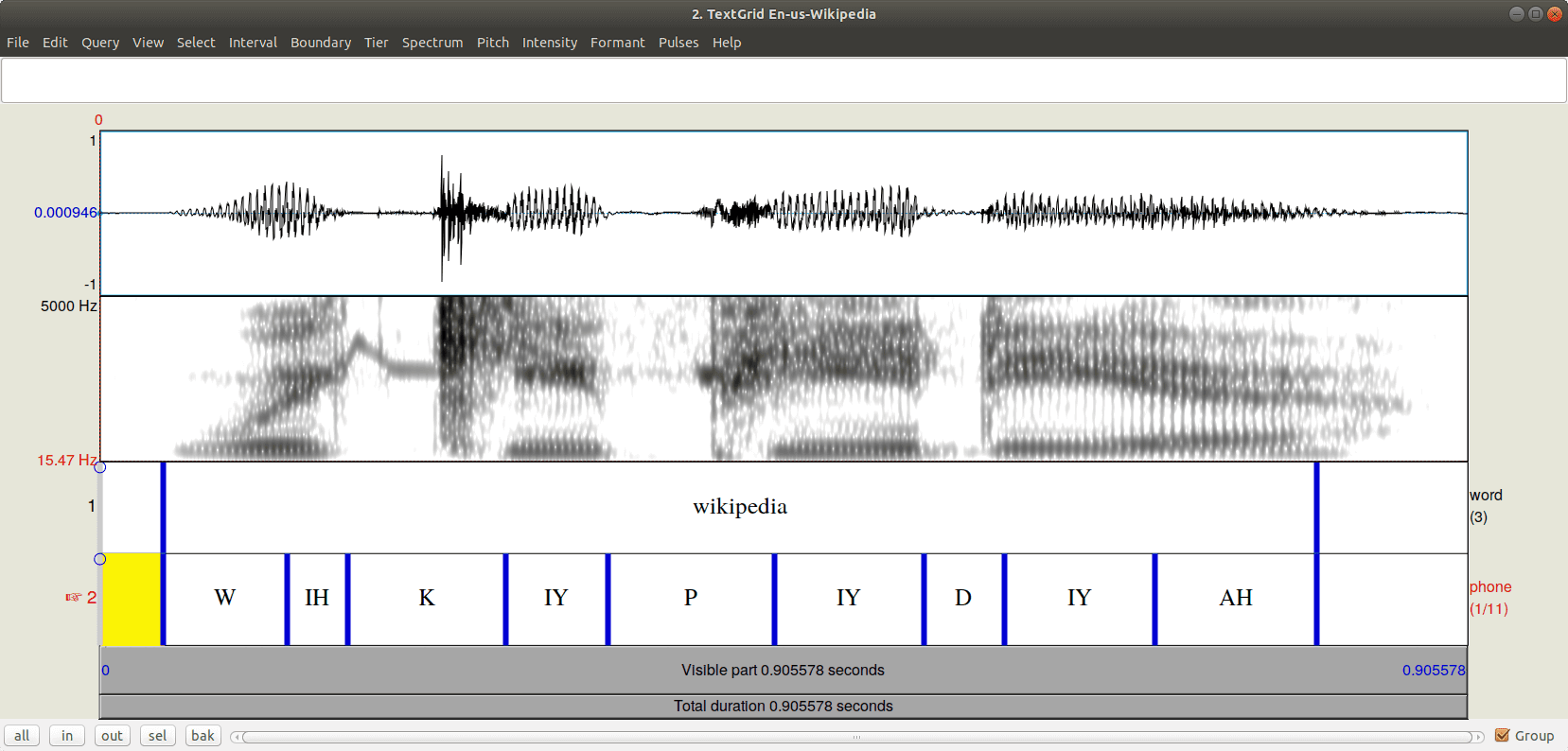

![Espectrograma e waveform em software de análise de fala]

O papel estratégico da parceria exclusiva inicial com a ElevenLabs

A Lightricks descreve a ElevenLabs como parceira exclusiva de lançamento na janela inicial, ressaltando que a colaboração não é apenas marketing, é alinhamento técnico. O áudio de alto nível gerado pela ElevenLabs, seja locução realista, dublagem multilíngue ou música, passa a acionar a camada visual dirigida pelo LTX-2, reduzindo atrito entre intenção sonora e execução visual. O post detalha ainda que o rollout mais amplo e o acesso de desenvolvedores via API e open source seguem em 27 de janeiro, o que indica estratégia de amadurecimento com early access e posterior abertura para ecossistema.

Esse movimento acompanha a expansão da própria ElevenLabs. Em 2025, a empresa lançou iniciativas como Eleven Music e ampliou parcerias com o setor musical, sinalizando ambição de se tornar uma plataforma de áudio generativo completa que inclui vozes, música e edição. Também firmou parcerias de distribuição de vozes com empresas como a AudioStack, adicionando dezenas de vozes multilíngues para produção em escala. Isso fortalece o pilar áudio que agora conversa com o vídeo do LTX.

Além disso, a ElevenLabs vem protagonizando acordos com nomes conhecidos, como as parcerias para clonagem de voz de Michael Caine e Matthew McConaughey, e mantém ritmo acelerado de crescimento. Coberturas recentes apontam discussões de mercado e valoração multibilionária, o que sugere capacidade de sustentar integrações e investimentos em segurança e qualidade. Para quem avalia stack de criação, isso significa um parceiro de áudio com estabilidade, escalabilidade e roadmap consistente.

Como começar, passo a passo e casos de uso imediatos

- Explainers com locução pronta. Suba a narração definitiva, adicione uma imagem de referência para ancorar personagem ou cenário e um prompt curto de estilo. Deixe o áudio guiar cortes e acting visual. Se precisar, refine com uma segunda passada, ajustando duração do áudio ou marcando trechos que exigem ênfase maior.

- Videoclipes e lyric videos. Use a faixa final ou um demo de música. O modelo lerá dinâmica e pausas, criando movimento sincronizado. Uma imagem de referência ajuda na consistência do artista. Para trechos específicos, encadeie clipes curtos e mantenha estilo com prompt idêntico.

- Animações dirigidas por efeitos sonoros. Carregue uma trilha com SFX que marcam ações, como passos, cliques ou impactos. Cada evento sonoro se torna um gatilho de movimento, ideal para prototipar identidades visuais e motion graphics.

Dica prática. Trate o áudio como roteiro. Ajuste pausa, cadência e intensidade no Studio 3.0 da ElevenLabs, corrija falas com Speech Correction, isole ruídos e exporte o take limpo para maximizar a qualidade do vídeo gerado no LTX. Quanto mais claro o áudio, mais previsível será a estrutura visual resultante.

![Interface de edição de vídeo com timeline, tracks e monitor]

O que esperar tecnicamente do stack LTX hoje

O LTX Studio é a aplicação de superfície de um ecossistema que inclui modelos como o LTX-2, além de parcerias de modelos de terceiros. Em 2025, a Lightricks abriu o LTX-2 e publicou evoluções de capacidade. O áudio para vídeo agora aparece como extensão natural do stack, com claim explícito de que a estrutura do clipe nasce do som. Para equipes técnicas, isso sugere que o encoder de vídeo é condicionado por features extraídas de ritmo, energia e semântica do áudio.

O site do LTX detalha ainda o fluxo prático, formatos suportados e FAQ do recurso Audio to Video. Os detalhes operacionais confirmam que a etapa visual aceita prompt curto e imagem de referência, que ajudam a segurar continuidade e estilo entre clipes encadeados, um ponto central para pipelines que precisam construir sequências longas a partir de takes modulares.

Limitações atuais, feedback da comunidade e mitigação de risco

Críticas públicas de 2025 e 2026 sobre o LTX Studio mencionam inconsistência em aderência a prompts, qualidade variável de clipes e questões de suporte e cobrança, segundo relatos em fóruns. Embora experiências individuais variem, esse material aponta para a necessidade de pilotos controlados, definição clara de métricas de qualidade e ensaios A B com alternativas em pré produção. Use testes rápidos com amostras representativas em vez de migrar a produção inteira de uma vez.

Em paralelo, a comunidade da ElevenLabs divulgou, em 20 de janeiro de 2026, postagens indicando disponibilidade do novo modelo de áudio para vídeo diretamente dentro do ElevenLabs, com campanha de créditos para primeiros usuários. Isso reforça que o recurso já circula entre criadores e tende a produzir mais feedback público nas próximas semanas, uma boa janela para medir maturidade do fluxo antes de escalar.

Mitigação rápida. Estruture um experimento com seis a oito roteiros curtos que representem seus formatos mais críticos. Para cada roteiro, gere duas variações de áudio no Studio 3.0, alterando cadência e pausas, e observe impacto direto na montagem visual gerada no LTX. Documente tempo de ajuste por clipe, taxa de reuso e consistência visual quando se usa uma mesma imagem de referência. Esse protocolo evidencia se a abordagem áudio primeiro reduz retrabalho de edição no seu caso específico.

Impacto para marcas, produtoras e creators

Para marcas, a promessa está em time to first cut. Quando o áudio lidera, o primeiro rascunho de vídeo chega mais alinhado a intenção de mensagem e tom de voz. Para produtoras, a vantagem surge na prototipagem com diretores e clientes, já que versões de locução podem ser testadas rapidamente antes da filmagem ou da animação final. Para creators independentes, o ganho vem de iterar com música e narração que já existem no ecossistema ElevenLabs, incluindo vozes realistas e, conforme o caso, música gerada com guardrails.

O timing do lançamento também favorece quem aposta em empilhamento de ferramentas. A ElevenLabs evolui como plataforma de áudio generativo e edição, enquanto o LTX se consolida como suíte de vídeo com controles manuais extensos. A ponte entre as duas reduz exportações e stitching entre apps. Para líderes de conteúdo, isso representa menos fricção entre times de áudio e vídeo e melhor rastreabilidade de versões.

Boas práticas de adoção responsável

- Direitos e consentimento. Adoção de vozes clonadas precisa de autorização clara, especialmente para talentos e celebridades. A ElevenLabs tem reforçado políticas e segurança depois de incidentes de uso indevido. Garanta consentimento documentado e fluxos de verificação de voz.

- Guardrails para música. Se música for gerada, verifique políticas de uso, origem de dados de treinamento e acordos com rightsholders, uma vertente que a ElevenLabs tem comunicado em lançamentos com parceiros da indústria.

- Métricas de qualidade. Defina KPIs de sincronização, consistência visual e tempo de ajuste por clipe. Se a variância de qualidade for alta, considere encadear clipes curtos e usar a mesma imagem de referência para estabilizar estilo.

O que observar nas próximas semanas

- 27 de janeiro de 2026. Abertura de API e componentes open source para áudio para vídeo no ecossistema LTX, ampliando possibilidades de integração em pipelines proprietários. Isso tende a gerar wrappers, plug ins e primeiros repositórios de exemplos.

- Evolução no Studio 3.0. A cada atualização da ElevenLabs, espere mais aderência entre edição de áudio e geração de vídeo, com timeline servindo de hub para revisão por partes e versionamento de takes.

- Feedback público. Acompanhe casos publicados por criadores e estúdios para mapear onde a abordagem áudio primeiro brilha e onde ainda exige intervenção manual. Fóruns e comunidades serão barômetros úteis de estabilidade, inclusive sinalizando problemas de suporte.

Conclusão

A geração de vídeo guiada por áudio do LTX Studio, em parceria exclusiva inicial com a ElevenLabs, representa um avanço prático para quem inicia projetos pelo som. O anúncio de 20 de janeiro de 2026 deixa claro o foco em infraestrutura e em workflows reais, com abertura de API e acesso open source marcada para 27 de janeiro. Para quem cria com locução, música e efeitos como ponto de partida, o ganho de velocidade no primeiro corte é o principal benefício.

A recomendação é pragmática. Teste em escala pequena, valide consistência e só então escale para campanhas ou séries completas. Observe políticas de direito de voz e música, e trate o áudio como roteiro. Com o stack ElevenLabs para áudio e o LTX para vídeo, a ponte entre intenção sonora e imagem fica mais curta. O próximo mês será decisivo para entender como essa abordagem se comporta fora do laboratório e dentro do calendário apertado de produção comercial.