Luma Labs revela Uni-1, que pensa e gera pixels juntos

Uni-1 inaugura uma fase em que compreensão e geração visual andam lado a lado, com arquitetura única e foco em raciocínio aplicado à criação de imagens.

Danilo Gato

Autor

Introdução

Luma Labs Uni-1 chegou com a proposta de pensar e gerar pixels no mesmo fluxo, unindo compreensão e criação em uma arquitetura única. O anúncio marcou uma guinada estratégica para além do vídeo, com ênfase em raciocínio visual como base para direção criativa e consistência.

O ponto central é a ideia de que um único modelo, treinado para entender intenções, decompor instruções e renderizar imagens coerentes, reduz atritos entre briefing e execução. Segundo a Luma, o Uni-1 é um modelo de raciocínio multimodal que também gera pixels, e foi desenhado para ser a base de agentes criativos e fluxos unificados que se estendem a vídeo e voz no futuro.

O que é o Uni-1 e por que isso importa

Uni-1 é o primeiro modelo da Luma que integra raciocínio e geração de imagens em uma única arquitetura, tratando palavras e pixels como partes da mesma linguagem. Em vez de acoplar um LLM a um gerador de imagens, a proposta é um cérebro único que planeja e cria sem etapas desconectadas. Esse desenho pretende diminuir erros de interpretação, preservar identidade e contexto e permitir direção refinada com referências visuais.

Para o mercado, isso tem implicações práticas. Agências e equipes de marketing podem reduzir idas e vindas entre briefing, esboço e finalização. Criadores ganham controle mais fino sobre identidade de personagens, estilos e composições, mantendo coerência entre variações. E como a própria Luma posiciona, essa base unificada pode escalar além de imagens para vídeo, agentes e simuladores interativos.

Como o Uni-1 funciona, do raciocínio à geração

A Luma divulga que o Uni-1 é um transformer autoregressivo de decodificação, em que texto e imagens formam uma sequência intercalada, tanto na entrada quanto na saída. Essa representação permite que o modelo raciocine por etapas, resolva restrições e planeje composição antes e durante a síntese, aproximando a dinâmica de criação de como um diretor humano pensa, decide e executa.

Além do ganho de direção, a unificação traz benefício inverso, gerar imagens melhora o entendimento. Na avaliação em tarefas de entendimento denso como ODinW, a Luma relata que treinar geração reforça capacidades de grounding e raciocínio sobre regiões e objetos, sem abrir mão da flexibilidade criativa do gerador. Em outras palavras, pensar melhora a imagem, e imaginar melhora a leitura.

Evidências, benchmarks e onde o Uni-1 se destaca

Segundo a página técnica, o Uni-1 alcança resultados de ponta em RISEBench, um benchmark voltado a edição visual informada por raciocínio, que testa capacidades temporal, causal, espacial e lógica. O material técnico também discute como o modelo decompõe instruções complexas mantendo plausibilidade e coerência de cena, um ponto crítico quando a tarefa exige respeitar identidade, pose e iluminação originais durante uma edição.

O próprio RISEBench, apresentado em artigo recente, foi criado justamente para medir essa classe de problemas que exigem raciocínio visual, do envelhecimento plausível de objetos a transformações causais como uma mordida na maçã, até puzzles lógicos. A ênfase está em avaliar se o modelo entende a instrução, preserva aparência e produz uma imagem plausível, com avaliações humanas e um pipeline de LMM como juiz.

No conjunto, os sinais sugerem um caminho firme para modelos que raciocinam e criam no mesmo passo. A Luma afirma ainda que o Uni-1 lidera preferências humanas em categorias como estilo, edição e geração baseada em referência, ficando em segundo em texto para imagem, o que reforça o foco em direção condicionada e controle.

Direção criativa na prática, referências e controle

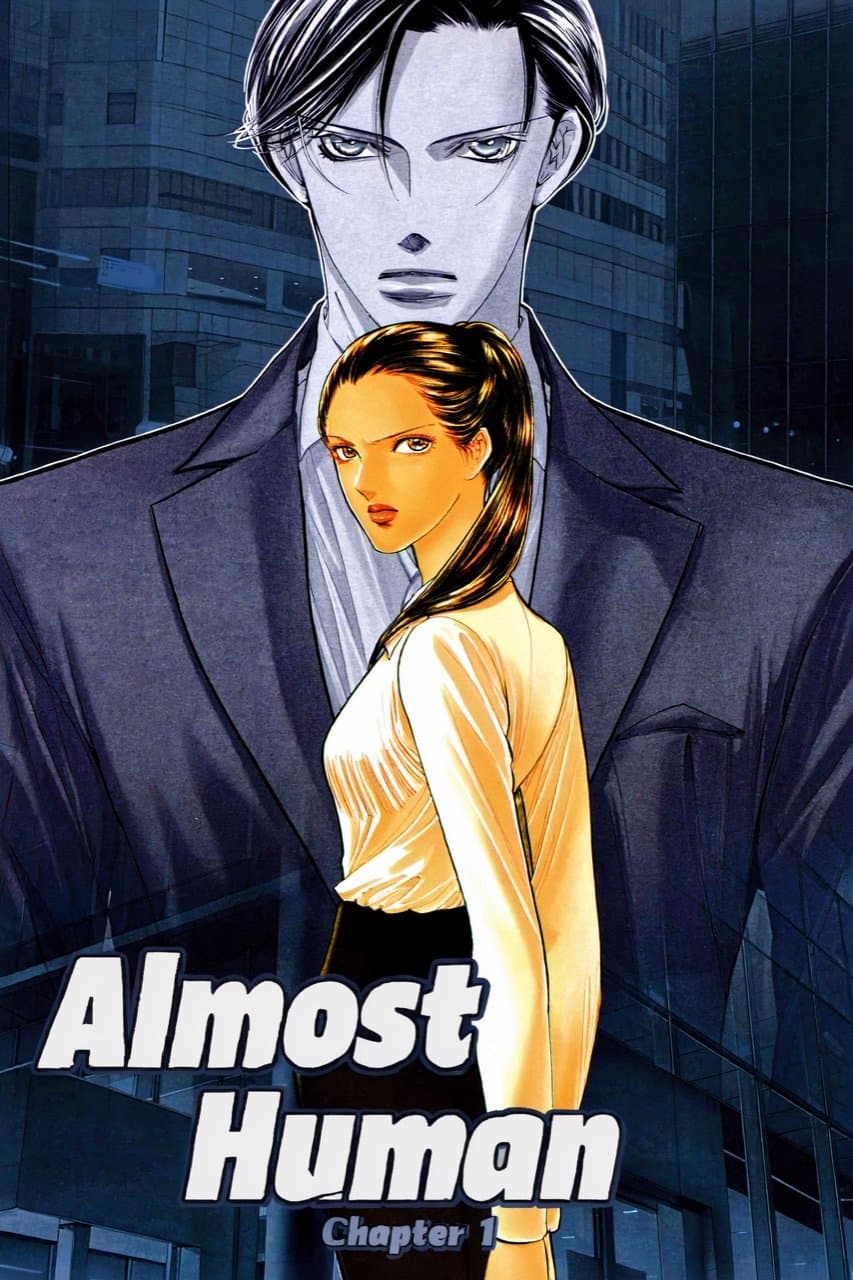

Nas demonstrações oficiais, o Uni-1 enfatiza três pilares práticos. Primeiro, Inteligente, com completação de cena por senso comum, raciocínio espacial e transformações guiadas por plausibilidade. Segundo, Direcionável, com controles ancorados em referências, múltiplas imagens e instruções visuais. Terceiro, Culto, com consciência de estilos culturais, estética e mangá sem descaracterizar a identidade do assunto. Essa combinação é o que transforma prompt em direção, reduzindo o efeito de loteria visual.

Na edição orientada por referência, o modelo preserva estrutura, identidade e composição, inclusive com múltiplas imagens de referência para consolidar traços. Em cenários de estilo, consegue transitar entre linguagens estéticas mantendo o sujeito reconhecível. Esses casos de uso aparecem nos carrosséis públicos da Luma e ajudam a visualizar o salto de qualidade quando raciocínio e pixels caminham juntos.

![Exemplo de transformação plausível com raciocínio causal]

Preços, acesso e impacto em equipes

Outro diferencial é a transparência de preços por tokens. A página pública lista valores por 1 milhão de tokens, com faixas separadas para entrada em texto, entrada por imagens, saída em texto e pensamento, e saída em imagens. Há ainda equivalentes por imagem em 2048 px para diferentes modos de uso, além de fila de espera para API. Esse modelo de cobrança, atrelado a tokens e não apenas por crédito de geração, facilita prever custo em pipelines empresariais.

Para equipes, essa previsibilidade permite prototipar prompts, aferir custos por lote e escalar produção com metas de qualidade. E como a Luma posiciona o Uni-1 como fundação de agentes, a integração com fluxos multimodais tende a consolidar um ciclo, entender pedido, planejar, gerar, revisar e publicar, com o mesmo núcleo cognitivo. Em cobertura externa de 9 de março de 2026, o lançamento do Uni-1 foi acompanhado de menções a Luma Agents, voltados a produção ponta a ponta e compatíveis com outros modelos do ecossistema.

O que muda no dia a dia de criação

Algumas mudanças são imediatas. Briefings complexos, que antes exigiam várias iterações entre LLM e gerador de imagens, tendem a convergir mais rápido, já que o próprio modelo estrutura a solução e executa a renderização considerando restrições de identidade, iluminação e plausibilidade física. Edições orientadas por storyboard também se beneficiam quando o sistema consegue manter consistência de cena entre quadros e variações.

Outra mudança é a liberdade para combinar referências e instruções visuais. Ao invés de apenas um estilo alvo, dá para ancorar pose, paleta, textura e composição vindo de fontes distintas, com o raciocínio do modelo fechando as lacunas de coerência. Isso encurta a distância entre arte de referência e resultado final, algo que times de branding e publicidade valorizam quando precisam preservar identidade visual.

Limites e o que observar nos próximos meses

Uni-1 chega num cenário competitivo em AI generativa, com modelos que já flertam com raciocínio multimodal. O diferencial aqui é a integração formal de pensar e gerar no mesmo transformador, algo que precisa ser testado em larga escala, especialmente em edge cases de lógica estrita, ambiguidade cultural e composições com alto grau de oclusão. Os próprios benchmarks recentes mostram que tarefas de raciocínio lógico seguem desafiadoras no estado da arte, o que deve continuar como fronteira ativa.

No roadmap público, a Luma indica que a abordagem unificada naturalmente se estende a vídeo, voz e simuladores interativos. A direção faz sentido, já que vídeo exige consistência temporal e causal durante muitos quadros, um terreno fértil para modelos que já raciocinam sobre tempo, espaço e lógica. A evolução para agentes criativos, coordenando texto, imagem, áudio e vídeo, forma o arco estratégico que a empresa tem sinalizado.

![Exemplo de sequência e estilo em narrativa visual]

Boas práticas para explorar o Uni-1 agora

-

Ancorar com múltiplas referências. Combine fotos de identidade, variações de pose e exemplos de estilo. Dê instruções explícitas de preservação de elementos chave, por exemplo, manter composição central, manter proporção do rosto, manter textura do tecido.

-

Descrever restrições e metas de plausibilidade. Explicite limites físicos, iluminação consistente e contexto espacial. Isso ajuda o raciocínio do modelo a evitar soluções artificiais.

-

Iterar como diálogo. Trate a direção como uma sequência de passos, peça planos de composição, corrija onde necessário e peça uma nova renderização. A arquitetura favorece esse vai e volta com consistência interna.

-

Medir custo com tokenização. Em pipelines produtivos, estime tokens de entrada e saída por tipo e monitore o equivalente por imagem para manter margem. Use amostras de 2048 px para orçar e escalar só quando estiver satisfeito com a direção criativa.

Reflexões e insights

Modelos que tratam linguagem e imagem como uma sequência só tendem a reduzir fricção entre intenção e execução. O ganho não está apenas em qualidade visual, está na confiabilidade do processo, o que destrava adoção em escala empresarial. Esse mesmo princípio também encaixa melhor com agentes e ferramentas de planejamento, porque o raciocínio já nasce no mesmo corpo que gera a imagem.

Benchmarks como o RISEBench sinalizam claramente onde os sistemas ainda tropeçam, sobretudo em lógica formal e em edições que exigem raciocínio multietapas com preservação estrita de identidade. Essa visibilidade ajuda times de produto a escolherem onde colocar o Uni-1, e ajuda a própria comunidade a comparar progresso de forma mais justa.

Conclusão

Uni-1 representa uma mudança de base, colocando raciocínio e geração no mesmo trilho. Para criadores e empresas, isso significa direção mais precisa, menos iterações e resultados mais coerentes, além de um modelo de preços que conversa com escalabilidade. O anúncio e a cobertura de 9 de março de 2026 consolidam essa guinada, com ecos claros de que a visão mira agentes e multimodalidade plena.

À medida que o ecossistema adota essa abordagem unificada, vale acompanhar duas frentes, maturidade em lógica estrita e a extensão do mesmo cérebro para vídeo e outros modos. Se o ritmo se manter, a linha que separa pensar e criar vai continuar sumindo, e isso muda o jogo da produção visual moderna.