Markey questiona OpenAI por publicidade enganosa no ChatGPT

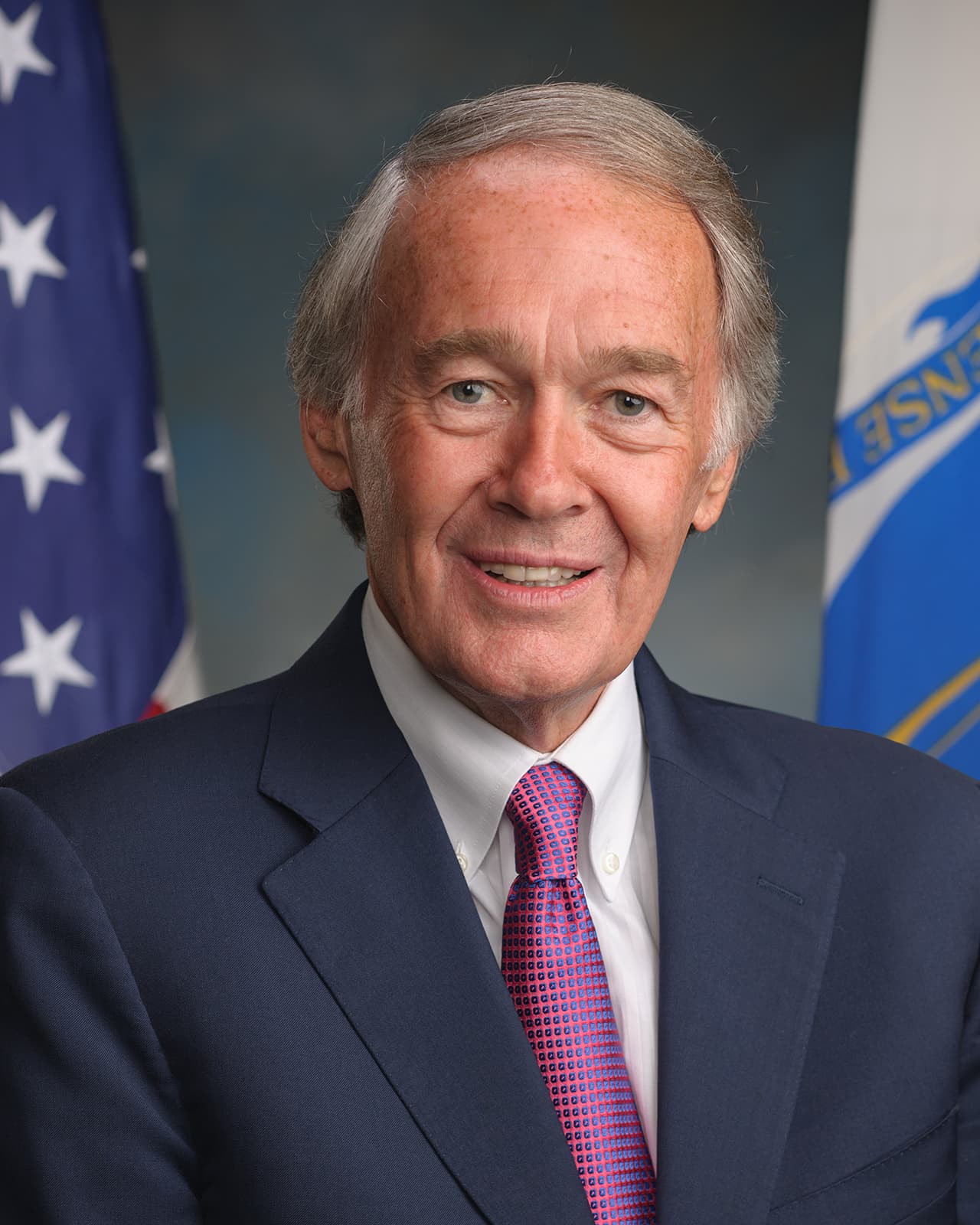

Senador Ed Markey pressiona OpenAI e outras big techs sobre anúncios em chatbots de IA, pedindo salvaguardas para menores, transparência na rotulagem e limites ao uso de dados sensíveis em publicidade no ChatGPT.

Danilo Gato

Autor

Introdução

Publicidade no ChatGPT entrou no centro do debate público após cartas do senador Ed Markey a OpenAI e outras empresas, questionando riscos de anúncios embutidos em conversas, impactos para menores e uso de dados sensíveis. O assunto importa porque publicidade no ChatGPT inaugura uma fronteira onde respostas, recomendações e ofertas podem se confundir aos olhos do usuário. A discussão envolve transparência, privacidade e padrões de segurança, além de definir como será a monetização dos chatbots de IA a partir de 2026.

A OpenAI informou que pretende testar publicidade no ChatGPT para usuários Free e Go adultos nos Estados Unidos, com rótulos claros e posicionamento abaixo das respostas, além de restrições para temas sensíveis e contas de menores. O ponto crítico está em como comunicar, quando ativar e com quais dados personalizar. A clareza agora orienta o setor, e o que for decidido neste ciclo pode virar referência global.

O que está em jogo, por que publicidade no ChatGPT é diferente

Anúncios em mecanismos de busca e feeds sociais já têm formatos e regras consolidas há anos. Publicidade no ChatGPT, porém, ocorre dentro de diálogos que parecem pessoais, com linguagem natural e alto grau de confiança. Isso cria duas pressões. Primeiro, rotular de forma inequívoca para que publicidade no ChatGPT não se confunda com a resposta orgânica. Segundo, garantir que dados inseridos em conversas, muitas vezes íntimas, não alimentem segmentação invasiva. É exatamente o alerta de Ed Markey, que cita o risco de influência comercial oculta, especialmente entre jovens, quando publicidade no ChatGPT se mistura ao fluxo da conversa.

O histórico recente ajuda a entender a sensibilidade. Em dezembro de 2025, após críticas de usuários, a OpenAI desligou sugestões que soavam como anúncios, mesmo afirmando que não havia componente comercial. O episódio mostrou que, na prática, a linha entre recomendação de app e publicidade no ChatGPT é muito fina. Uma rotulagem impecável e controles de usuário deixam de ser diferenciais e viram pré-requisito.

O plano declarado da OpenAI, princípios e limites iniciais

A OpenAI publicou princípios para anúncios, afirmando que publicidade no ChatGPT começará com testes limitados, rótulos evidentes, separação visual do conteúdo gerado e possibilidade de controle pelo usuário. A empresa informa que não compartilhará conversas com anunciantes e que não exibirá publicidade no ChatGPT para menores nem perto de temas sensíveis como saúde ou política. Segundo a página oficial de ajuda, Plus, Pro, Business, Enterprise e Edu seguirão sem anúncios. Essas diretrizes, se executadas como descritas, atacam pontos-chave do debate.

Do ponto de vista de produto, transparência exige onde, quando e como. Onde, em espaço visual destacado e separado do texto do chatbot. Quando, somente com sinal claro de relevância contextual e sem extrapolar para segmentação comportamental baseada em histórico sensível. Como, com rótulos legíveis, explicação do porquê daquele anúncio e uma ação simples para ocultar. Esses três vetores, se bem implementados, reduzem o risco de que publicidade no ChatGPT seja percebida como manipulação sutil do diálogo.

![Logotipo do ChatGPT]

A cobrança do Senado, o prazo de 12 de fevereiro e o pano de fundo regulatório

Ed Markey enviou cartas a OpenAI, Anthropic, Google, Meta, Microsoft, Snap e xAI pedindo informações detalhadas sobre planos de publicidade em chatbots, com foco em proteção de menores e privacidade. O prazo para respostas vai até 12 de fevereiro de 2026. O senador cita a natureza conversacional dos bots, a formação de vínculos emocionais e o risco de publicidade no ChatGPT e em produtos similares comprometerem a autonomia do usuário. O pedido não ocorre no vácuo, ele ecoa discussões já em curso na FTC sobre chatbots-companheiros, monetização e disclosures.

A FTC, desde 2022, investiga técnicas de publicidade que borram limites para crianças e adolescentes, discutindo quando e como as divulgações funcionam de verdade. Esse acervo regulatório pavimenta o caminho para exigir que publicidade no ChatGPT adote padrões de transparência adequados à idade. O debate inclui formato, timing, colocação, redação e frequência de disclosures, fatores que, somados, definem se o aviso funciona.

Tendência de mercado, posicionamentos e alternativas

Em paralelo às cartas, o mercado começa a se posicionar. Reportagens recentes indicam que o Google, por ora, não planeja anúncios no Gemini, sinalizando estratégia distinta da OpenAI. A diversidade de modelos de negócio importa porque define a pressão competitiva sobre publicidade no ChatGPT. Se grandes players optarem por monetização por assinatura e parcerias B2B, a adoção de anúncios em chatbots pode caminhar com mais cautela.

Do lado da autorregulação, o IAB publicou em 15 de janeiro de 2026 um framework de transparência e disclosure para IA em publicidade. Embora amplo, o documento inclui gatilhos de disclosure para chatbots e agentes conversacionais. Para quem pretende veicular publicidade no ChatGPT, a referência ajuda a construir um sistema de rótulos em duas camadas, com selo visível ao consumidor e metadados C2PA para verificação. Isso reduz assimetria de informação sem travar operações.

Riscos centrais e como mitigá-los na prática

-

Confusão entre conteúdo e anúncio. Rotular com destaque, usar separadores visuais nítidos e evitar que publicidade no ChatGPT apareça no meio de uma resposta. Posicionar abaixo do bloco de conteúdo, como a OpenAI sinalizou, é um caminho mais seguro.

-

Uso de dados sensíveis. Separar dados de conversa do pipeline de segmentação publicitária, restringir personalização a sinais contextuais de sessão e oferecer opt-out granular. A comunicação precisa ser explícita, inclusive com páginas de ajuda dedicadas e painéis de controle do usuário.

-

Proteção de menores. Aplicar triagem de idade conservadora, bloquear publicidade no ChatGPT quando houver incerteza e adotar listas de temas proibidos que cubram saúde, política, finanças e outros tópicos regulados. As cartas de Markey deixam claro que erros aqui terão baixa tolerância política.

-

Confiança do assinante. Evitar que recomendações de apps ou integrações pareçam publicidade no ChatGPT. Se houver promoção de parceiros, rotular como tal e fornecer critérios. O episódio de 2025 mostrou que a percepção do usuário pesa tanto quanto a intenção do produto.

Design de disclosure que funciona, aprendizados da FTC e do IAB

Pesquisas e fóruns da FTC destacam que disclosures precisam ser vistos, lidos e compreendidos, não apenas exibidos. Em publicidade no ChatGPT, a aplicação prática envolve três camadas. Um rótulo textual claro, como Patrocinado, no topo do bloco do anúncio. Um separador visual com cor e espaçamento que destoe do fundo da conversa. Um clique opcional para expandir a explicação, por que este anúncio, o que foi considerado e como desativar personalização. Esse padrão multi camada tende a reduzir a confusão e a fortalecer o consentimento informado.

Para casos de voz ou avatares, a diretriz do IAB sobre materialidade ajuda. Quando IA altera identidade, representação ou autenticidade de uma forma que possa enganar, a exigência de disclosure sobe um nível. Embora publicidade no ChatGPT hoje mire blocos de texto ricamente rotulados, é prudente já preparar padrões para respostas faladas, personagens e agentes multimodais, dado o avanço dos modelos.

Impacto para marcas, anunciantes e publishers

Para anunciantes, publicidade no ChatGPT abre um canal de alta intenção quando a conversa toca pontos próximos da conversão. A responsabilidade é proporcional à oportunidade. Estratégias vencedoras vão privilegiar relevância contextual, landing pages com continuidade de linguagem e métricas focadas em valor incremental, não tempo de tela. Para publishers e plataformas, o aprendizado é claro. Publicidade no ChatGPT não pode empurrar o usuário para um funil opaco. Deve respeitar o ritmo da conversa, com frequência controlada e limites temáticos.

Do lado de mensuração, faz sentido priorizar estudos de recall de marca, lift de consideração e consultas de alta qualidade em vez de cliques crus. Na prática, quando publicidade no ChatGPT aparece como bloco separado e rotulado, o CTR tende a ser menor que formatos intrusivos. Mesmo assim, o impacto incremental nas métricas de qualidade pode ser superior, exatamente por respeitar a experiência. O ajuste fino virá com testes A B e pesquisas de brand safety.

![Senador Ed Markey, retrato oficial]

Lições de segurança infantil e governança de produto

Casos e debates recentes sobre IA com menores reforçam a necessidade de governança forte. A preocupação de Markey com publicidade no ChatGPT para adolescentes se conecta a investigações e pedidos públicos para restringir experiências de IA a menores em redes sociais e apps de mensagens. O recado é simples, qualquer monetização em ambientes com presença juvenil precisa ser conservadora, auditar fluxos e documentar salvaguardas.

Na prática, três controles ajudam. Primeiro, política de elegibilidade que exige verificação de idade robusta quando uma conta sinaliza adolescência, com bloqueio padrão para publicidade no ChatGPT. Segundo, taxonomia de conteúdo sensível que puxe o freio de mão em tempo real, evitando que anúncios apareçam próximos a temas de saúde, política, finanças pessoais e bem estar mental. Terceiro, auditorias externas periódicas, com relatórios públicos que mostrem taxa de erro, casos de falsos positivos e intervenção humana quando necessário.

Como implementar publicidade no ChatGPT sem perder a confiança

-

Declare princípios públicos, com compromissos verificáveis e métricas de transparência. A OpenAI já publicou um conjunto inicial, e o setor pode exigir metas de rotulagem visível e tempo médio para correção de falhas.

-

Dê ao usuário controle simples. Um botão para ocultar, outro para desativar personalização, além de um painel para limpar dados usados em publicidade no ChatGPT. Transparência não é PDF, é interface clara e auditável.

-

Separe equipes e pipelines. Times de privacidade independentes dos times de vendas, logs criptografados, chaves rotativas e políticas que impeçam o uso de conteúdo de conversa em perfis de segmentação. A mensagem de Markey foca nessa fronteira entre ajuda e influência comercial.

-

Comece pequeno e com parceiros de confiança. Rodadas limitadas, categorias de baixo risco e criativos com disclosures exemplares. Se houver integração com apps, evitar que pareçam recomendações orgânicas. O precedente de 2025 ensinou isso ao mercado.

Reflexões e insights para 2026

Publicidade no ChatGPT não precisa repetir erros de ondas anteriores do digital. Existe uma chance real de construir um formato útil e honesto, que respeite contextos e proteja grupos vulneráveis. Sinais vindos do Senado e da FTC sugerem que a régua regulatória subirá, principalmente para experiências de menores. Quanto antes as plataformas internalizarem isso, menor o choque de conformidade.

Há também uma competição de narrativas. Enquanto alguns players sinalizam que não adotarão anúncios em seus modelos, a OpenAI escolheu testar publicidade no ChatGPT com salvaguardas. Essa diferença cria espaço para comparar métricas de satisfação, churn e receita. No médio prazo, o mercado recompensará quem comunicar com honestidade, rótulos visíveis e controle de usuário real.

Conclusão

Publicidade no ChatGPT inaugura um novo formato, mais íntimo e mais exigente. Transparência, limitação de dados e proteção a menores deixam de ser elementos reputacionais para virar infraestrutura do produto. O debate público iniciado pelas cartas de Ed Markey acelera a maturidade do tema e cria incentivos para que as plataformas publiquem métricas de cumprimento, erros e correções.

O próximo trimestre será definidor. Se os testes seguirem com rótulos claros, controles simples e limites a dados sensíveis, publicidade no ChatGPT pode ganhar legitimidade. Se houver deslizes na comunicação, o custo regulatório e reputacional virá rápido. Cabe a marcas e plataformas provar que é possível monetizar conversas preservando a confiança, que é, afinal, o ativo que sustenta qualquer experiência de IA.