NVIDIA lança Nemotron 3 Nano Omni, 9x eficiente para agentes

Novo modelo multimodal aberto da NVIDIA unifica visão, áudio e linguagem, promete até 9x mais throughput para agentes de IA e chega com pesos abertos e integração ampla

Danilo Gato

Autor

Introdução

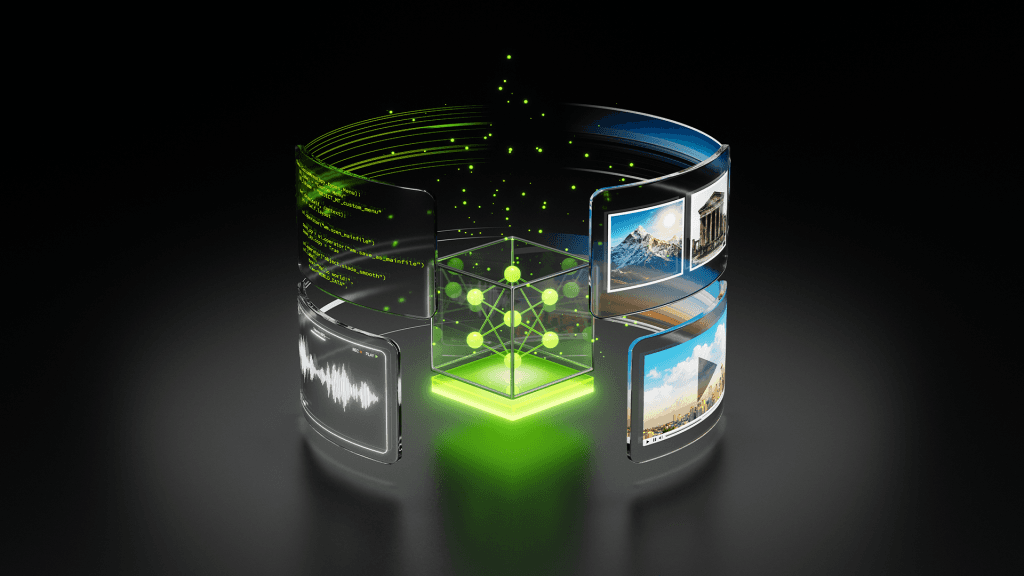

Nemotron 3 Nano Omni é a palavra‑chave do momento na computação de agentes. O modelo multimodal aberto da NVIDIA unifica visão, áudio e linguagem em um único sistema e, segundo os dados oficiais, atinge até 9x mais throughput em cenários de interatividade equivalente quando comparado a outros modelos omni abertos. A disponibilidade foi anunciada em 28 de abril de 2026 e inclui Hugging Face, OpenRouter e o serviço NIM da própria NVIDIA.

O lançamento mira um problema prático, pipelines de agentes fragmentados que combinam encadeamentos de modelos diferentes para visão, fala e texto. Ao consolidar a percepção multimodal, o Nemotron 3 Nano Omni reduz hops de inferência, diminui custos e preserva contexto entre modalidades, algo crítico para tarefas de uso de computador, extração de informação de PDFs ou entendimento sincronizado de áudio e vídeo.

O que é o Nemotron 3 Nano Omni e por que isso importa

O Nemotron 3 Nano Omni é um modelo de 30 bilhões de parâmetros, com arquitetura híbrida mixture‑of‑experts A3B, projetado para operar como sub‑agente de percepção e contexto. Em vez de alternar entre diferentes stacks, ele recebe entradas de texto, imagens, áudio, vídeo e documentos, gera saídas textuais e mantém um estado multimodal unificado. Para empresas, isso significa reduzir latência percebida, cortar custos de orquestração e ganhar previsibilidade em produção.

Alguns pontos essenciais de produto, a própria NVIDIA posiciona o Omni como o modelo de maior eficiência entre os abertos em sua categoria, reunindo visão, áudio e linguagem com top performance em leaderboards relevantes de documentos, vídeo e áudio. O anúncio cita adoção inicial por Aible, ASI, Eka Care, Foxconn, H Company, Palantir e Pyler, além de avaliações por Dell, Docusign, Infosys, K‑Dense, Lila, Oracle e Zefr, um sinal de tração no ecossistema empresarial.

Arquitetura, contexto longo e otimizações que fazem diferença

Por baixo do capô, o Nemotron 3 Nano Omni combina um core híbrido MoE 30B‑A3B com componentes voltados a eficiência e percepção temporal, incluindo convoluções 3D para vídeo, Efficient Video Sampling para reduzir tokens visuais em tempo de inferência e um contexto longo, reportado como 256K em materiais do lançamento. A pilha suporta quantizações FP8 e NVFP4, além de kernels otimizados pela NVIDIA para previsibilidade de latência. A compatibilidade cobre GPUs Ampere, Hopper e Blackwell e engines como vLLM e TensorRT‑LLM.

O desenho do Omni privilegia papel de sub‑agente, conectado a modelos de execução e planejamento, como Nemotron 3 Super e Nemotron 3 Ultra, mantendo a arquitetura de agentes modular e escalável. É um detalhe importante na prática, em vez de tentar que um único modelo faça tudo, a proposta é especializar a percepção multimodal e preservar interatividade enquanto modelos maiores cuidam de passos intensivos de raciocínio ou orquestração.

Benchmarks, eficiência e o número que todo mundo observou

Os resultados publicados pelo time técnico e parceiros indicam ganhos claros em throughput sob um limiar fixo de interatividade por usuário. Em tarefas de vídeo, o Nemotron 3 Nano Omni sustenta até cerca de 9,2x mais capacidade de sistema efetiva do que modelos omni abertos alternativos, e em cenários de múltiplos documentos, o ganho reportado chega a aproximadamente 7,4x. No benchmark MediaPerf, o Omni aparece com maior throughput em todas as tarefas e menor custo de inferência para tagging em nível de vídeo.

Importa destacar a metodologia, em vez de maximizar concorrência bruta, as medições fixam a taxa de tokens por segundo por usuário e observam quanto throughput agregado o sistema mantém sem degradar a experiência. Esse recorte é relevante para operações reais de agentes, onde a responsividade por sessão pesa tanto quanto a densidade total de requests.

Disponibilidade e como começar na prática

O modelo está disponível com pesos abertos no Hugging Face, com diferentes checkpoints e formatos pensados para servir desde estações locais até ambientes de data center e cloud. Empresas que preferem serviço gerenciado podem usar OpenRouter e o NVIDIA NIM, que expõe o Omni como microserviço. Essa variedade reduz fricção de teste, POC e rollout controlado.

Começos rápidos úteis, o card do Hugging Face e o post técnico trazem receitas completas de pré‑treino, pós‑treino e avaliação, além de cookbooks para vLLM, SGLang e TensorRT‑LLM. Para quem busca padronizar pipelines ou reproduzir resultados, há licenças e datasets abertos, bem como guias de fine‑tuning com LoRA e rotas de RL baseadas em NeMo.

![Ilustração do fluxo multimodal do Nemotron 3 Nano Omni]

Casos de uso, do uso de computador à inteligência de documentos

Três frentes se destacam no anúncio, agentes de uso de computador, inteligência de documentos e entendimento de áudio e vídeo. O primeiro caso usa o Omni como ciclo de percepção em interfaces gráficas, interpretando conteúdo de tela e estado de UI ao longo do tempo. A H Company, por exemplo, integrou o modelo com entrada nativa de 1920x1080, algo improvável com stacks fragmentados sem sacrificar fidelidade visual. Em OSWorld, avaliações preliminares sugerem salto significativo em navegação de interfaces complexas.

Em documentos, o Omni processa PDFs longos, planilhas, gráficos e composições multimídia, cruzando layout e conteúdo textual em um único stream de raciocínio. No suporte a áudio e vídeo, mantém alinhados o que foi dito, visto e registrado, o que corta divergências entre resumos separados e reforça análise em tempo quase real. Para operações de atendimento, auditoria e pesquisa, isso se traduz em menos callbacks de processamento e queda de custos por tarefa.

Por que o openness importa para times de IA corporativa

Os pesos, datasets e receitas de treino abertos dão a equipes de MLOps e segurança mais controle sobre como e onde o modelo roda. Esse ponto não é cosmético, muitas organizações precisam atender requisitos de soberania, privacidade e conformidade, e poder auditar dados e ajustar a pilha é muitas vezes a diferença entre POC e produção. O pacote da NVIDIA inclui licenças de modelo abertas, receitas completas e guias de implantação, além de um ecossistema de parceiros e clouds.

Para quem está migrando de stacks puramente fechados, a rota híbrida faz sentido, usar o Omni como sub‑agente multimodal e acoplá‑lo a modelos de planejamento proprietários, mantendo flexibilidade de custo e proteção de dados mais rígida onde for necessário.

Dicas de arquitetura para implementação

- Definir limites de interatividade por usuário. Replique a metodologia dos testes, fixe tokens por segundo por sessão como métrica de UX e dimensione o throughput agregado do cluster, em vez de perseguir apenas QPS bruto.

- Separar papéis, deixe o Omni focar percepção multimodal e delegue execução e planejamento a modelos dedicados, como Nemotron 3 Super e Ultra. Garante modularidade e upgrade independente.

- Testar quantização. FP8 e NVFP4 valem o esforço no TensorRT‑LLM, especialmente em GPUs Hopper e Blackwell, onde os ganhos de latência são mais consistentes.

- Ajustar amostragem de vídeo. Habilite Efficient Video Sampling e valide o trade‑off entre qualidade de percepção e carga de tokens visuais por janela de contexto.

- Padronizar deploy. Se a equipe prefere API, OpenRouter e NIM aceleram o rollout. Para quem quer controle total, Hugging Face com vLLM e SGLang é um bom ponto de partida.

Como testar hoje, roteiro de POC em 7 passos

- Provisionar ambiente com GPU compatível, H100 ou B200 para picos de throughput, ou um servidor Hopper para lotes médios.

- Baixar o checkpoint no Hugging Face e validar inferência básica em vLLM com batching contínuo.

- Ativar EVS em cenários de vídeo e medir tokens por usuário com e sem a camada.

- Habilitar NVFP4 no TensorRT‑LLM e comparar latência P50 e P95 com FP8.

- Integrar o sub‑agente ao orquestrador de agentes e conectar modelos de execução, por exemplo, Nemotron 3 Super.

- Rodar cenários de documentos longos com contexto extenso, avaliando precisão em OCRBenchV2 e MMLongBench‑Doc como referência.

- Em produção, monitorar throughput agregado sob o limiar de interatividade definido e otimizar conciliação de filas.

![Diagrama de arquitetura do Omni como sub‑agente de percepção]

O que dizem os parceiros e onde ver rodando

O post oficial cita empresas adotando o Omni, de startups a gigantes industriais. Em paralelo, o catálogo do OpenRouter já lista o modelo com guia de API, útil para testes rápidos e integração com plataformas de inferência. Para quem avalia benchmarks independentes de vídeo, o post da Coactive sobre MediaPerf ajuda a entender o posicionamento do Omni no Pareto de eficiência, qualidade, custo e throughput.

No lado developer, o blog técnico agrega receitas reproduzíveis de pré e pós‑treino e links para datasets abertos, inclusive pacotes sintéticos específicos para fortalecer entendimento de documentos longos e tarefas multimodais. Esse material encurta a distância entre leitura do anúncio e uma POC com indicadores de qualidade confiáveis.

Comparativos e contexto do ecossistema

No ciclo anterior, a família Nemotron 3 ficou conhecida por ganhos de throughput em texto, chegando a superar modelos equivalentes em tokens por segundo por usuário. O Omni estende essa narrativa para percepção multimodal, adicionando suporte nativo a vídeo e áudio com o mesmo foco em custo previsível. Há sinais de que o ecossistema ao redor da família 3 está se expandindo com coalizões, parcerias de infra e modelos complementares em áreas como voz e agentes de uso de computador. Para decisões de portfolio, a leitura é que a NVIDIA posiciona a linha como base aberta para stacks de agentes com componentes especializados em cima.

Um ponto de equilíbrio na análise, benchmarks não capturam toda a variabilidade de workloads reais. Métricas internas como tempo de warmup, variação entre lotes multimodais e mix de tarefas por sessão podem deslocar latência e throughput observados. O recomendado é medir sob seu perfil de tráfego, com traços de produção, reproduzindo o limiar de interatividade que faz sentido para seu usuário, e só então extrapolar custo total.

Limitações e cuidados práticos

- Treinamento e ajuste finos exigem curadoria de dados multimodais, garantir direitos e governança sobre imagens, vídeos e áudios. As receitas abertas ajudam, porém a responsabilidade pelos dados permanece com o usuário.

- Trade‑offs de quantização e EVS, reduzir custo com NVFP4 e amostragem eficiente é ótimo, mas teste regressões em precisão de OCR e eventos rápidos em vídeo.

- Observabilidade, invista em telemetria orientada a sessão, tokens por usuário e quedas de qualidade entre modalidades sob carga. A escalabilidade relatada depende de manter o limiar de interatividade intacto.

Reflexões e insights

A consolidação da percepção multimodal em um sub‑agente dedicado resolve um gargalo recorrente que aparece em qualquer operação que tenta alinhar o que está na tela, o que a pessoa disse e o que o documento traz. O ganho não está apenas na velocidade, está no corte de perda de contexto entre hops e na previsibilidade de custo sob carga. Quando um time consegue planejar capacidade por tokens por usuário e manter experiência estável, decisões de negócio ficam mais fáceis.

Outro ponto que merece atenção é o grau de abertura. Com pesos, datasets e receitas publicadas, o Omni dá às empresas a alternativa de customizar com segurança, adequar a requisitos de soberania e auditar a pilha. Em um mercado onde muitos modelos de ponta chegam apenas via API, essa abertura cria oportunidades para inovação aplicada e para reduzir dependências de terceiros em partes sensíveis do fluxo.

Conclusão

O Nemotron 3 Nano Omni chega para reposicionar a camada de percepção em agentes. Unifica visão, áudio e linguagem, entrega ganhos expressivos de throughput mantendo interatividade e se apoia em uma base aberta de pesos e receitas. Para quem precisa escalar agentes que realmente entendem telas, documentos e mídia, a proposta é pragmática, mexe em custo e em simplicidade operacional.

O passo seguinte é avaliar onde o Omni encaixa no seu stack, pilotar com métricas de sessão e dimensionar custo por usuário sob cenários realistas. Com a disponibilidade imediata em Hugging Face, OpenRouter e NIM, montar um piloto nesta semana é totalmente viável, desde que as equipes alinhem metas de precisão, latência e governança de dados desde o início.