OpenAI investe US$7,5 mi no The Alignment Project para alinhamento de IA

Apoio financeiro fortalece pesquisa independente de alinhamento de IA e amplia um fundo global que já supera £27 milhões, com 60 projetos iniciais financiados

Danilo Gato

Autor

Introdução

OpenAI alinhamento de IA ganhou um novo impulso. Em 19 de fevereiro de 2026, a OpenAI confirmou um aporte de US$ 7,5 milhões ao The Alignment Project, fundo global criado pelo UK AI Security Institute para apoiar pesquisa independente de mitigação de riscos de segurança e desalinhamento em sistemas de IA. Segundo a própria OpenAI, o valor equivale a aproximadamente £5,6 milhões nas taxas de câmbio atuais.

A relevância dessa decisão vai além do montante. O The Alignment Project está estruturado para financiar de forma ágil e diversificada projetos que investigam desde teoria da complexidade e criptografia até interpretabilidade e avaliação em aprendizado por reforço. O fundo, agora com mais de £27 milhões e apoio adicional de parceiros como Microsoft e AWS, iniciou a concessão para 60 projetos distribuídos por 8 países.

Este artigo aprofunda como o investimento se encaixa no ecossistema global de segurança em IA, o que muda para pesquisadores e empresas, e quais aplicações práticas podem surgir das prioridades do The Alignment Project. As conclusões se baseiam em comunicados oficiais do governo do Reino Unido, do UK AISI e da OpenAI publicados em 19 de fevereiro de 2026.

O que exatamente foi anunciado e por que importa

A OpenAI formalizou um grant de US$ 7,5 milhões ao The Alignment Project, administrado com suporte da Renaissance Philanthropy. O anúncio frisa que o aporte não cria um novo programa, nem interfere em processos de seleção, ele amplia o número de projetos de alta qualidade já avaliados que podem ser financiados na rodada atual. O foco declarado é acelerar pesquisa independente que desenvolva salvaguardas contra riscos de segurança e desalinhamento, ao passo que os laboratórios de fronteira, como a OpenAI, seguem investindo em métodos escaláveis de alinhamento dentro de casa.

Em paralelo, o governo do Reino Unido informou que, com o reforço financeiro, o fundo total passa de £27 milhões e apoia cerca de 60 projetos, com nova rodada prevista para o verão de 2026. O anúncio foi feito por autoridades britânicas no encerramento do AI Impact Summit, destacando alinhamento como uma das frentes mais urgentes para viabilizar usos confiáveis de IA em serviços públicos e setores produtivos.

Em termos práticos, o investimento sinaliza uma estratégia de portfólio. Alinhamento não é um único problema com uma única solução. A aposta é que projetos independentes, desconectados dos roadmaps de grandes laboratórios, aumentem a diversidade de abordagens e tragam evidências empíricas e quadros conceituais alternativos. Isso inclui áreas com payoff de longo prazo que, muitas vezes, não são fáceis de priorizar em ambientes orientados a produto.

Como o The Alignment Project funciona, prioridades e quem pode se beneficiar

O The Alignment Project foi concebido como uma coalizão internacional público privada, liderada pelo UK AISI, para financiar pesquisas que mantenham sistemas avançados de IA seguros, confiáveis e sob controle humano. O programa oferece grants de £50 mil a £1 milhão e, em alguns casos, acesso opcional a recursos de computação e suporte de especialistas. Além do financiamento direto, há até £5 milhões em créditos de nuvem AWS destinados a experimentos técnicos que extrapolam a capacidade acadêmica típica.

As prioridades de pesquisa explicitadas pelo AISI são amplas e complementares. Entre elas, destacam se: teoria da informação e criptografia, teoria da complexidade, teoria econômica e jogos, métodos probabilísticos, teoria do aprendizado, garantias e avaliação em RL, ciência cognitiva, interpretabilidade, design de benchmarks e avaliação, métodos de pós treinamento e elicitação, e investigações empíricas de monitoramento e red teaming. Esse espectro incentiva tanto avanços conceituais quanto engenharia de segurança aplicada.

Para pesquisadores, o benefício é evidente. Projetos que, por necessidade de independência intelectual ou por estarem fora da zona de conforto de laboratórios de produto, ficariam sem financiamento, passam a ter rota. Para universidades, grupos independentes e institutos emergentes, acesso a compute e mentoria reduz o gap entre hipótese e teste reprodutível. Para o mercado, resultados em áreas como avaliação, interpretabilidade e monitoramento tendem a se traduzir em ferramentas mais robustas de segurança por design.

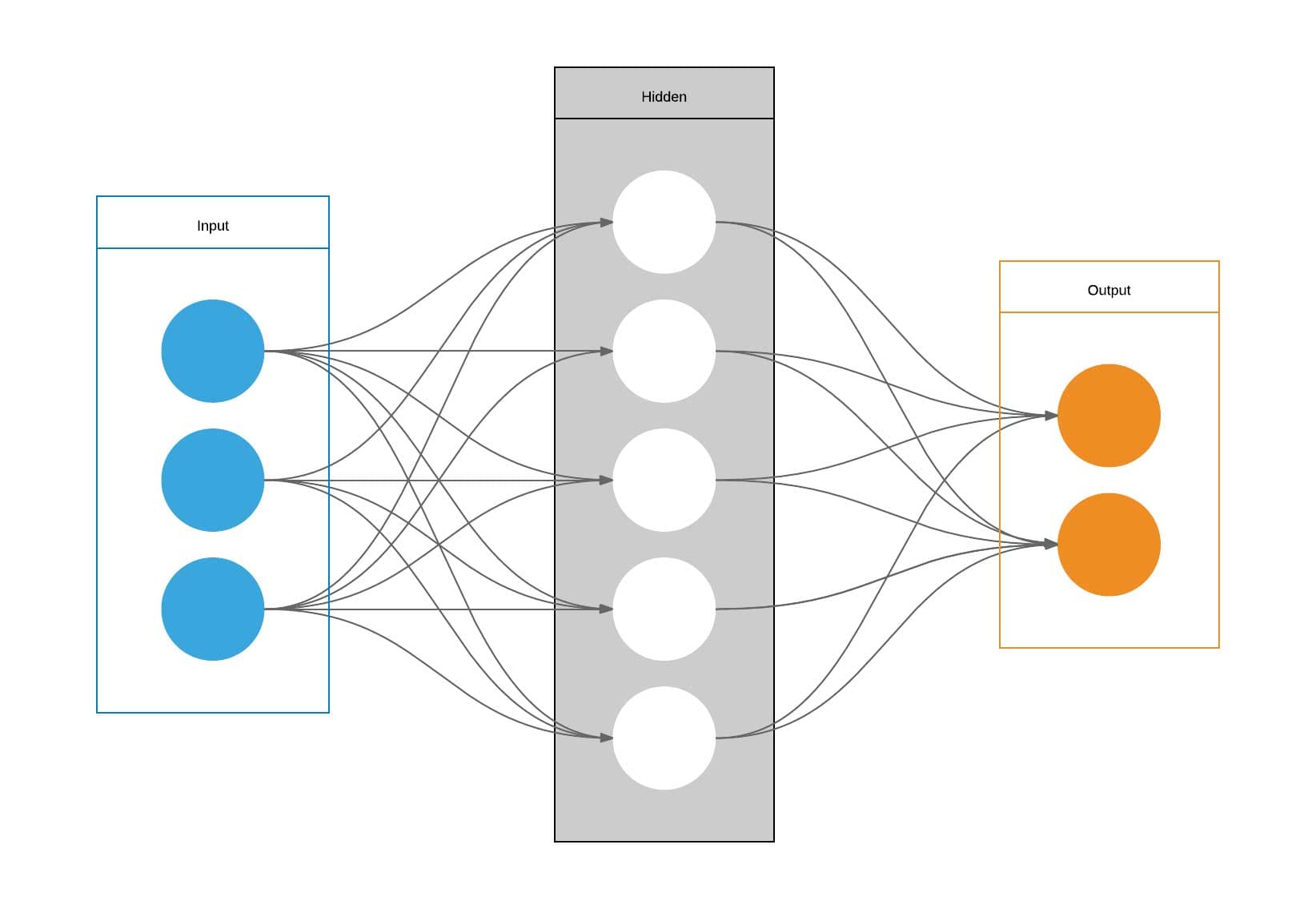

![Diagrama de rede neural, exemplo didático]

Impactos esperados para empresas, times de produto e segurança

Empresas que implementam modelos fundacionais podem ganhar com três frentes, diretamente ligadas às prioridades do fundo:

- Testes de robustez e avaliação, com benchmarks mais específicos por domínio. Projetos sobre design e avaliação de benchmarks podem reduzir falsos negativos em avaliações de comportamento perigoso e melhorar diagnósticos de regressão em atualizações de modelo.

- Contenção de riscos via métodos de pós treinamento e elicitação. Melhorias em técnicas como RLHF, RLAIF e regras de segurança tendem a produzir políticas mais previsíveis, com menos jailbreaks, sem degradar utilidade para casos de uso legítimos.

- Observabilidade e resposta a incidentes. Investigações empíricas de monitoramento e red teaming podem acelerar padrões internos de SRE para IA, com playbooks de rollback, kill switches e auditoria de prompts e ferramentas.

Na prática, times de produto podem incorporar resultados dessas pesquisas em ciclos de release. Um fluxo sugerido é adotar gates de segurança que acoplam avaliações de alinhamento a mudanças de versão, mensuram impactos por segmento de cliente e definem níveis mínimos de conformidade para liberar features. Essa abordagem de implantação iterativa, defendida pela OpenAI como forma de descobrir problemas cedo e criar evidências do que funciona, tende a alinhar segurança com velocidade de entrega.

O papel da diversidade de abordagens e por que independência importa

O anúncio enfatiza que não existe monopólio de boas ideias em alinhamento. Projetos independentes podem explorar hipóteses que não se encaixam perfeitamente no roadmap de um laboratório específico ou que exijam ciclos longos de maturação. Isso vale, por exemplo, para fundamentos teóricos que, a curto prazo, não se convertem em feature mas, a médio prazo, podem redefinir as fronteiras do campo.

A independência também reduz lock in metodológico. Quando múltiplos grupos, com incentivos distintos, testam pressupostos diferentes, o risco de toda a comunidade apostar em uma única classe de técnicas diminui. O resultado esperado é uma ciência mais antifrágil e um espaço de soluções mais diverso, com maior probabilidade de encontrar caminhos que escalem junto com modelos cada vez mais capazes.

O que os comunicados oficiais revelam sobre escala e governança

O press release do governo britânico detalha dois pontos relevantes. Primeiro, a escala. Com o reforço financeiro de OpenAI, Microsoft e outros parceiros, o fundo atinge mais de £27 milhões e financia cerca de 60 projetos, com uma segunda rodada prevista para o verão de 2026. Segundo, a governança. O The Alignment Project possui um conselho consultivo com nomes como Yoshua Bengio, Zico Kolter, Shafi Goldwasser e Andrea Lincoln, além de uma coalizão que inclui CIFAR, AWS, Anthropic, ARIA e outros atores públicos e filantrópicos.

Outro detalhe prático é o foco do UK AISI em riscos sérios de IA, amparado por um mandato governamental, equipe técnica crescente e pipeline de concessão já em andamento. Essa estrutura aumenta a probabilidade de execução com rigor de due diligence, acompanhamento e avaliação de impacto dos projetos apoiados.

Aplicações concretas que podem emergir das áreas prioritárias

- Teoria da informação e criptografia aplicada a salvaguardas. Espera se ver protocolos e provas que limitem vazamentos de informação sensível em agentes conectados a ferramentas e dados proprietários, além de técnicas criptográficas para auditorias sem expor segredos.

- Teoria da complexidade como limite de capacidade. Investigações podem estabelecer fronteiras computacionais que impeçam modelos de executar classes específicas de cálculos perigosos sem supervisão humana, criando guard rails teóricos.

- Avaliação e garantias em RL. Avanços em métricas de comportamento fora de distribuição e em testes de preferências podem melhorar sistemas de recompensa que penalizem ações inseguras, reduzindo exploits e comportamentos emergentes indesejados.

- Interpretabilidade e ciência cognitiva. Ferramentas para rastrear features latentes e modelos de cognição artificial podem tornar explicáveis decisões de alto impacto, requisito crescente em setores regulados.

![Esquema de rede neural, camada única]

Como times podem se preparar para absorver os resultados

Times técnicos podem agir em três frentes, antecipando o spillover dessas pesquisas:

- Infra de avaliação contínua. Instituir pipelines que executem suites de testes de segurança, com cenários adversariais, antes de cada release. Ou seja, segurança como teste de regressão. Resultados de novos benchmarks oriundos do The Alignment Project podem ser plugados como novos estágios do CI.

- Observabilidade de modelos em produção. Padronizar logging de prompts, ferramentas chamadas, estados de agente e decisões de roteamento, com red flags acopladas a alertas. Pesquisas em monitoramento e red teaming do fundo devem gerar padrões e datasets úteis para afiar alertas e respostas.

- Política interna de rollout iterativo. Adoção de gradientes de capacidade com salvaguardas progressivas, liberando features para amostras controladas, com reviews de risco em janelas curtas. Essa abordagem é consistente com a visão de implantação iterativa reforçada pela OpenAI.

Riscos, limites e perguntas em aberto

Mesmo com mais capital e diversidade de ideias, alguns desafios permanecem. Primeiro, transferência para o mundo real. Métodos que funcionam em sandbox precisam sobreviver a ambientes de produção com usuários criativos e incentivos econômicos. Segundo, medição. Nem todo ganho em segurança é fácil de quantificar, ainda mais quando se tenta antecipar classes de falhas futuras. Terceiro, coordenação. A pluralidade de abordagens, um ponto forte do fundo, exige padrões de compartilhamento de resultados e reprodutibilidade para evitar fragmentação. As estruturas formais do AISI e o conselho consultivo ampliado são um antídoto, mas a execução dirá até onde essa coordenação chega.

Há ainda a questão de escopo. O The Alignment Project está, por desenho, centrado em alinhamento e segurança técnica. As dimensões mais amplas de impacto social e governança ética exigem interface com outras iniciativas e reguladores. O lado positivo é que um pipeline robusto de resultados técnicos dá material concreto para políticas baseadas em evidências.

O que observar nos próximos meses

- Chamada para a próxima rodada. O governo britânico sinalizou uma segunda janela de financiamento para o verão de 2026. Projetos com resultados preliminares fortes podem ganhar tração extra.

- Consolidação de benchmarks. Com 60 projetos em andamento e mais de £27 milhões comprometidos, é razoável esperar frameworks de avaliação que se tornem referência de mercado, especialmente em tasks de agentes e uso de ferramentas.

- Casos de uso em setores críticos. Saúde, governo digital e infraestrutura são candidatos naturais a absorver melhorias em interpretabilidade, detecção de abuso e prevenção de vazamentos. O discurso oficial britânico conecta alinhamento a confiança pública e ganhos de produtividade, então pilotos em serviços públicos devem surgir.

Conclusão

O aporte de US$ 7,5 milhões da OpenAI ao The Alignment Project confirma uma tendência necessária, alinhamento de IA como esforço plural, independente e com escala para experimentar e errar rápido. Com um fundo que supera £27 milhões, 60 projetos já financiados e prioridades que vão do teórico ao aplicado, a comunidade ganha uma via adicional para transformar pesquisa em práticas de segurança reprodutíveis.

Para quem constrói produtos com IA, a recomendação é pragmática. Aproveitar a maré de pesquisa para fortalecer avaliação, monitoramento e implantação iterativa. A combinação de diversidade de abordagens externas com engenharia de segurança interna costuma gerar resultados mais duráveis do que apostar em uma única técnica. Se o objetivo é escalar capacidades com responsabilidade, essa é a direção certa.