OpenAI lança GPT-5.2-Codex, seu modelo de código mais avançado

O GPT-5.2-Codex chega com foco em engenharia de software profissional e cibersegurança defensiva, com ganhos em contexto longo, refactors, Windows e segurança.

Danilo Gato

Autor

Introdução

O GPT-5.2-Codex foi lançado em 18 de dezembro de 2025 como o modelo de código mais avançado da OpenAI para engenharia de software profissional e cibersegurança defensiva. A OpenAI afirma que o GPT-5.2-Codex melhora contexto longo, tool calling, compaction nativa, refactors, migrações complexas e traz capacidades de segurança significativamente mais fortes. Também está sendo disponibilizado em superfícies do Codex para assinantes pagos do ChatGPT, com acesso via API chegando nas semanas seguintes.

A importância do GPT-5.2-Codex vai além de “escrever código”. O modelo foi desenhado para atuar de forma agentic em ambientes reais, navegando repositórios grandes, executando comandos, rodando testes e sustentando sessões longas sem perder o fio. Com desempenho de ponta em SWE-Bench Pro e Terminal-Bench 2.0, o avanço mira tarefas de engenharia do mundo real, do planejamento à entrega.

Este artigo analisa o que muda na prática com o GPT-5.2-Codex, como ele se conecta ao ecossistema Codex, o que os benchmarks sugerem, quais são as implicações para ciberdefesa, e como times podem implementar valor rapidamente sem sacrificar segurança.

O que o GPT-5.2-Codex é, e por que importa

O GPT-5.2-Codex é uma versão do GPT-5.2 otimizada para workflows agentic de codificação dentro do Codex. O foco está em produtividade de engenharia, confiabilidade em sessões prolongadas e capacidade de lidar com mudanças amplas como refactors e migrações. A OpenAI destaca melhorias em contexto longo, tool calling mais estável, factualidade e compaction nativa, aumentando a eficiência de raciocínio em tarefas longas.

Na prática, isso significa menos perda de contexto, menos retrabalho e mais “entrega em série” quando se delega epics e operações multi-etapas ao agente. Em ambientes Windows, historicamente mais sensíveis à configuração de toolchains, o GPT-5.2-Codex amadureceu a confiabilidade do agente de terminal, tornando pipelines locais e híbridos mais previsíveis para equipes que dependem de stacks Microsoft.

Outro ponto-chave é visão. O modelo interpreta capturas de tela, diagramas e superfícies de UI com mais precisão, transformando mocks em protótipos funcionais, o que encurta o ciclo entre design e código. Essa competência visual é particularmente útil em squads de frontend que precisam acelerar a passagem de specs visuais para componentes de produção.

Como o ecossistema Codex potencializa o GPT-5.2-Codex

O lançamento se apoia em um ecossistema que já vinha ganhando corpo desde maio de 2025, quando a OpenAI apresentou o Codex, um agente de engenharia de software em nuvem que executa tarefas em paralelo em sandboxes isoladas. O Codex ficou geralmente disponível em outubro de 2025, com SDK, integração ao Slack e ferramentas de administração para uso em escala.

Para fluxos locais, o Codex CLI fornece uma interface de terminal que lê, edita e executa código na sua máquina. A instalação é simples, com suporte oficial a macOS e Linux e suporte experimental a Windows via WSL. Com o GPT-5.2-Codex, a OpenAI orienta instalar o pacote globalmente e trabalhar a partir do repositório. Exemplo de instalação: npm i -g @openai/codex.

Com a entrada do GPT-5.2-Codex, a navegação entre modalidades do Codex fica mais fluida, do “pair programming” no CLI ao “delegation” assíncrono na nuvem, passando pela integração em IDEs como VS Code e editores compatíveis. Isso permite dividir um epic em subtarefas paralelas, atribuindo peças de baixo risco ao agente e mantendo revisões humanas nos PRs de alto impacto.

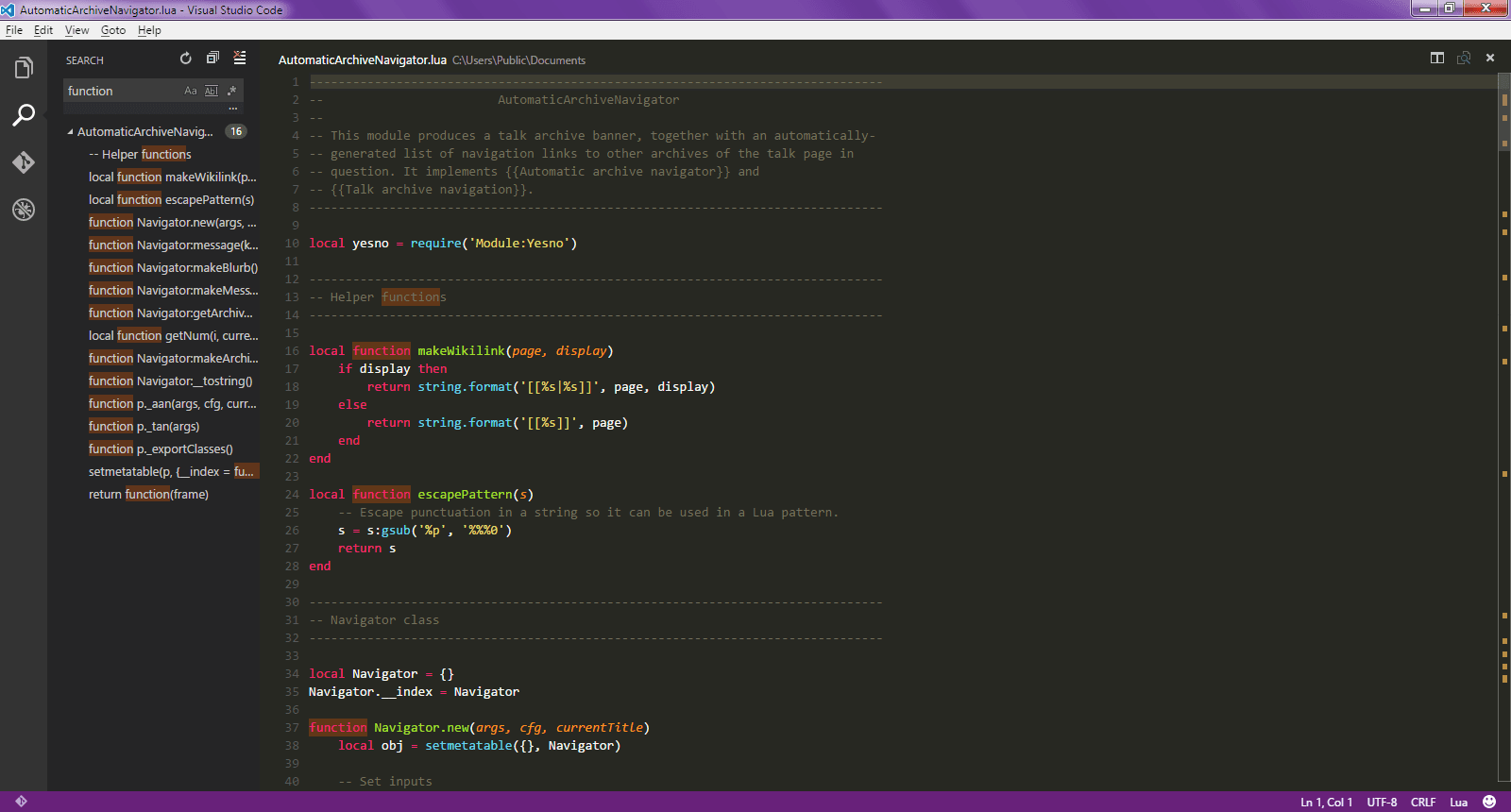

![Tela de editor com código em destaque]

O que dizem os benchmarks, e o que isso significa para times

A OpenAI reporta state-of-the-art em SWE-Bench Pro e Terminal-Bench 2.0, avaliações projetadas para medir desempenho agentic em cenários de terminal real e tarefas que exigem gerar patches em repositórios de código. Em termos práticos, trata-se de capacidade de mapear um issue complexo, estimar plano de ataque, modificar múltiplos arquivos, compilar, rodar testes e convergir para um patch válido com mínima supervisão.

Benchmarks nunca contam a história completa, mas são úteis para balizar prioridades. Se o GPT-5.2-Codex marcou melhor nessas baterias, tende a se sair bem em refactors extensos, migrations de frameworks e tarefas de infraestrutura que exigem múltiplas tentativas e diagnósticos iterativos. Em ambientes com grandes monorepos, isso impacta diretamente lead time e taxa de sucesso em first pass.

A versão base GPT-5.2, anunciada uma semana antes, trouxe avanços gerais de inteligência e produtividade em conhecimento profissional, o que se reflete no GPT-5.2-Codex. Relatos na imprensa mencionam ganhos em conhecimento aplicado, planilhas, apresentações e gerenciamento de projetos multi-etapas, reforçando que a especialização de código está montada sobre um salto geral de capacidade.

Cibersegurança defensiva, dual use e o piloto de acesso confiável

A OpenAI enfatiza que o GPT-5.2-Codex apresenta capacidades de cibersegurança mais fortes que as versões anteriores, mas que ainda não alcança o nível “High” na sua própria avaliação de prontidão. Para gerir riscos de uso dual, a empresa publicou um addendum de system card e lançou um piloto de acesso confiável, convidando profissionais e organizações com histórico de divulgação responsável para explorar capacidades adicionais com salvaguardas mais rígidas.

Um caso interessante citado pela OpenAI: em 11 de dezembro de 2025, a equipe do React publicou três vulnerabilidades que afetavam apps com React Server Components. O destaque, segundo o relato, foi que o processo de descoberta veio de um fluxo de pesquisa defensiva assistido por GPT-5.1-Codex-Max no Codex CLI, durante a reprodução de uma falha anterior conhecida como React2Shell, catalogada como CVE-2025-55182. O post do React e a entrada no NVD confirmam o disclosure e o CVE.

Esse tipo de resultado mostra o potencial para acelerar varreduras, reprodução e validação de PoCs em stacks amplamente adotadas. Ao mesmo tempo, justifica controles de acesso e trilhas de auditoria mais rigorosas, já que capacidades que ajudam defensores podem, em tese, ser desviadas para abuso. O caminho responsável parece ser ampliar acesso de forma faseada, com critérios verificáveis e métricas de impacto defensivo.

O que muda no dia a dia de engenharia

No curto prazo, o GPT-5.2-Codex tende a afetar quatro frentes operacionais:

- Refactors e migrations. A capacidade de manter o contexto por longas sessões, com compaction nativa e tool calling mais confiável, favorece refactors que atravessam múltiplos módulos. Tarefas como migrar de APIs legadas, padronizar estilos e remover dívidas ficam mais previsíveis.

- Windows e ambientes heterogêneos. A melhoria reportada em ambientes Windows reduz fricção de setup e execução de ferramentas, o que ajuda times com ambiente híbrido. Para quem trabalha em WSL, o Codex CLI já vinha com orientação de suporte experimental.

- Design para código. A leitura mais acurada de mocks e telas encurta o ciclo design-dev, especialmente em equipes que usam sistemas de design bem definidos.

- Operações assíncronas. Com Codex na nuvem, dá para disparar tarefas em paralelo, acompanhar logs, revisar diffs e integrar via SDK e Slack, o que aumenta throughput sem inflar headcount.

Para tirar proveito logo de início, uma estratégia prática é começar com um “lane” seguro de tarefas repetitivas, como padronização de testes, remoção de imports mortos e atualização de dependências, mantendo PRs pequenos e revisão humana obrigatória. A partir daí, evoluir para epics moderados, medindo ciclo e qualidade com métricas como tempo até merge, taxa de revert e incidência de bugs por PR.

![Tela inicial do VS Code com extensão de Python]

Guia rápido de adoção em 30 dias

Semana 1, instalação e políticas. Habilitar o GPT-5.2-Codex nas superfícies do Codex disponíveis para o workspace, instalar o Codex CLI via npm i -g @openai/codex, definir diretórios e repositórios autorizados, ativar logging e versionamento obrigatório. Em Windows, avaliar operação com WSL quando necessário.

Semana 2, pilotos controlados. Selecionar 2 a 3 repositórios com boas suítes de testes. Delegar tarefas de baixo risco ao agente, como linting, pequenas correções e ajustes de build. Configurar ambientes de sandbox do Codex em nuvem para execuções assíncronas, e integração com Slack para triagem.

Semana 3, epics moderados. Consolidar aprendizado em refactors localizados, como modularização de componentes, migração incremental de um roteador ou atualização de camada de persistência. Medir velocidade de entrega e qualidade dos PRs do agente em comparação com a linha de base humana.

Semana 4, hardening e expansão. Incorporar regras de segurança em profundidade, segregação de ambientes, secrets management e políticas de least privilege para o agente. Se houver perfil para o piloto de acesso confiável em cibersegurança, avaliar candidatura.

Governança, segurança e conformidade

Modelos com capacidade agentic exigem governança específica. O ponto de partida é uma matriz RACI que explicita quem aprova tarefas, quem revê código e quem monitora execução. Em seguida, políticas de execução, desde escopos de diretórios até limitação de comandos privilegiados. No caso do GPT-5.2-Codex, a OpenAI sinaliza salvaguardas adicionais e um addendum de system card para orientar implantações responsáveis, alinhadas ao seu Preparedness Framework.

Para conformidade, vale mapear logs do agente a requisitos de auditoria, com retenção compatível com normas internas e setoriais. Em setores regulados, a combinação de sandboxes isoladas do Codex, PRs obrigatórios e trilhas de auditoria tende a facilitar justificativas para auditores.

Reflexões e insights

O recorte mais interessante do GPT-5.2-Codex é a ambição de operacionalizar ciclos longos com menos supervisão. Se o modelo sustenta uma sessão extensa, mantém plano de ação e recupera de falhas sem perder contexto, o agente deixa de ser apenas um assistente de prompts. Passa a ser um executor confiável de iniciativas com valor composto ao longo de dias de trabalho.

Em segurança, o caminho faseado com acesso confiável é pragmático. A história do React, com disclosure real e CVE associado, ilustra como IA acelera defensores em ambientes amplamente adotados. Ao mesmo tempo, transparência sobre limites de capacidade e salvaguardas é essencial para evitar overclaim e uso inadequado.

Perguntas práticas que times devem responder agora

- Quais classes de tarefas serão delegadas ao GPT-5.2-Codex, e com quais critérios de risco, prioridade e tamanho de PR?

- Como será a política de execução local e em nuvem, incluindo permissões, secrets e limites de comandos?

- Quais métricas provarão valor, como lead time, taxa de aprovação em primeira revisão, regressões e MTTR?

- Em que medida o agente atuará em Windows, Linux e WSL, e como garantir paridade de ambientes?

- Quais salvaguardas adicionais são necessárias para testes com recursos de cibersegurança?

Conclusão

O GPT-5.2-Codex consolida a visão de um agente de engenharia capaz de navegar repositórios extensos, executar tarefas longas e colaborar com humanos em ciclos iterativos. Com ganhos declarados em benchmarks, leitura de contexto e confiabilidade, o modelo se posiciona como peça central para times que querem elevar produtividade sem abrir mão de controle.

Em cibersegurança, o equilíbrio entre acesso ampliado e salvaguardas aponta para um caminho responsável. A referência a vulnerabilidades reais no ecossistema React, somada a um piloto de acesso confiável, sugere uma estratégia focada em impacto defensivo com gestão de risco explícita. Para líderes de engenharia, o recado é claro, vale testar agora em trilhas seguras, medir rigorosamente e expandir conforme a evidência sustente.