OpenAI lança Safety Fellowship para externos até 3 de maio

Inscrições abertas até 3 de maio para um programa piloto focado em pesquisa de segurança e alinhamento em IA, com mentoria, apoio computacional e comunidade técnica.

Danilo Gato

Autor

Introdução

A palavra chave OpenAI Safety Fellowship entrou no debate com força em 6 de abril de 2026, quando a OpenAI abriu inscrições para uma nova fellowship voltada a pesquisadores externos, com prazo até 3 de maio. O programa é piloto, foca em segurança e alinhamento de sistemas avançados, e combina mentoria, suporte computacional e entregáveis públicos.

A relevância é direta. A cada salto de capacidade dos modelos, cresce a demanda por avaliações rigorosas, mitigação escalável e práticas de privacidade que funcionem no mundo real. A iniciativa se soma a outras frentes de segurança da própria OpenAI, como o bug bounty focado em abuso de IA e riscos de segurança publicado em 25 de março de 2026, além do quadro de preparação para riscos de fronteira atualizado no último ano.

O texto a seguir detalha o que a fellowship oferece, quem deve considerar a inscrição e como essa proposta se conecta às lacunas práticas do ecossistema de segurança em IA.

O que a Safety Fellowship anuncia de novo

A Safety Fellowship nasce com escopo pragmático. Segundo o anúncio oficial, o programa aceita pesquisadores, engenheiros e profissionais externos interessados em questões de segurança relevantes para sistemas atuais e futuros. Áreas prioritárias incluem avaliações de segurança, ética, robustez, mitigadores escaláveis, métodos de segurança com preservação de privacidade, supervisão de agentes e domínios de uso indevido de alta gravidade. Tudo com ênfase em trabalho empiricamente ancorado e tecnicamente sólido.

Alguns detalhes operacionais importam porque afetam planejamento e resultado:

- Período do programa: 14 de setembro de 2026 a 5 de fevereiro de 2027, com expectativa de um output substancial, como paper, benchmark ou dataset.

- Mentoria da OpenAI e convívio com uma coorte, com opção de espaço de trabalho em Berkeley, em parceria com a Constellation, ou participação remota.

- Benefícios incluem bolsa mensal, suporte de computação e créditos de API, sem acesso interno a sistemas.

- Linha do tempo: inscrições abertas e fechamento em 3 de maio, comunicação a selecionados até 25 de julho.

O recorte de temas e a estrutura de mentoria sinalizam um objetivo claro, acelerar pesquisa aplicada que renda ativos úteis ao campo, de métricas robustas a datasets de avaliação, passando por métodos replicáveis de mitigação. Em termos práticos, isso ajuda a reduzir a distância entre teoria e impacto operacional.

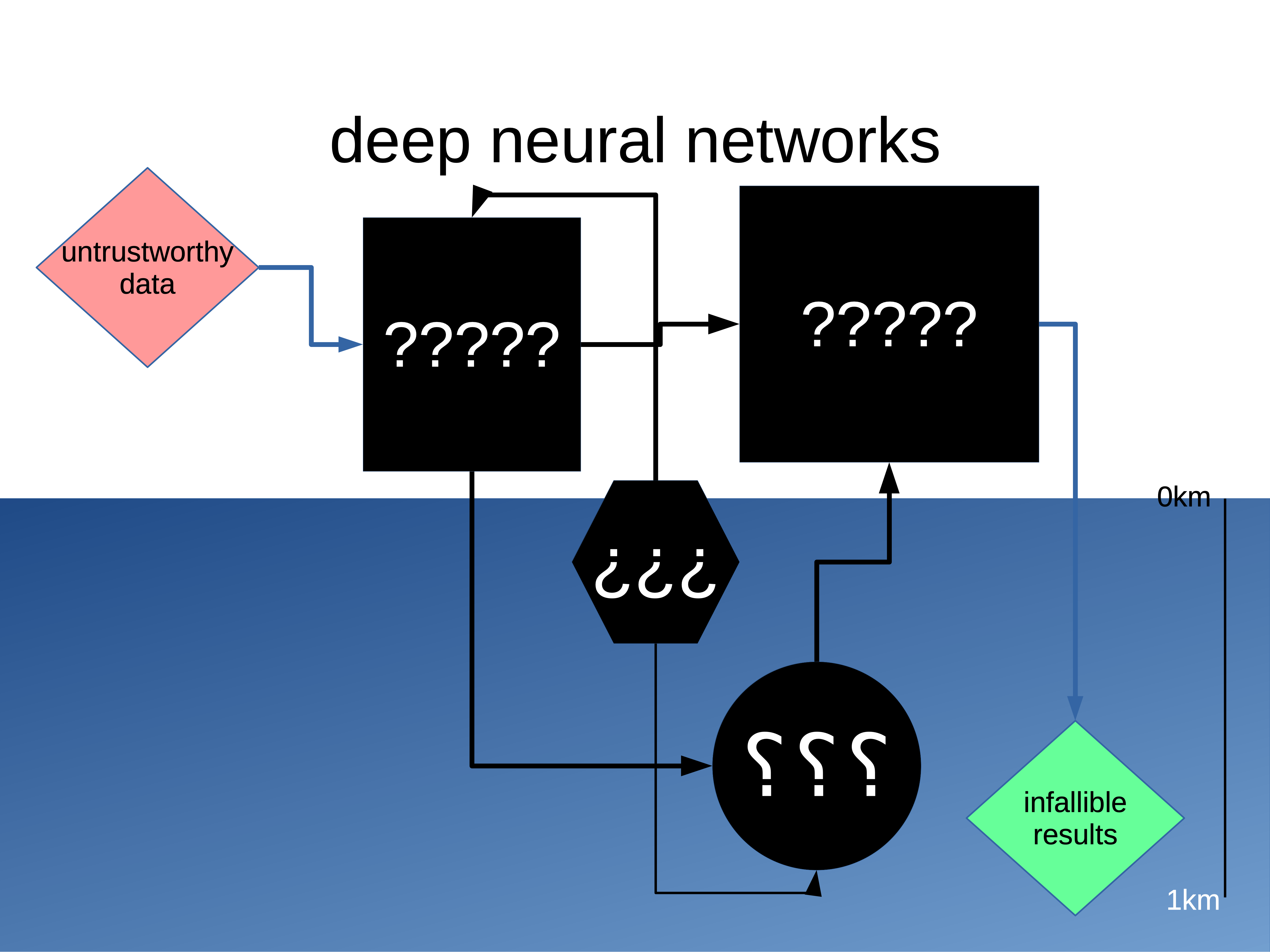

![Diagrama de redes neurais profundas, útil como imagem de destaque de segurança em IA]

Quem deve se inscrever e o que apresentar

O anúncio é explícito ao acolher perfis diversos, de ciência da computação a ciências sociais, segurança cibernética, privacidade e HCI. O critério que pesa é habilidade de pesquisa, julgamento técnico e execução, acima de credenciais formais. Cartas de referência serão exigidas.

Para maximizar as chances, três princípios ajudam:

- Problema concreto e mensurável. Propostas que definem hipóteses claras, protocolos de avaliação e critérios de sucesso tendem a gerar impacto. Isso está totalmente alinhado à ênfase declarada em pesquisa empiricamente fundamentada.

- Entregáveis reproduzíveis. Benchmarks, rubricas de auditoria, datasets e pipelines de verificação costumam ganhar tração porque podem ser usados por outros laboratórios e times de produto.

- Conexão com riscos de maior severidade. A priorização de domínios de uso indevido de alta gravidade pede propostas que tratem abuso, exploração de agentes, exfiltração de dados e outras classes críticas de falhas.

Em tom pessoal, faz sentido mirar lacunas conhecidas do ecossistema, como: avaliações robustas de agentes com ferramentas, taxonomias de ataques multi-agente e métodos replicáveis de contenção. Essa direção conversa com movimentos recentes da OpenAI para testar e endurecer camadas de proteção, como o bug bounty focado em injeção de prompt e exfiltração de dados em agentes, bem como o esforço contínuo para padronizar avaliações de riscos de fronteira.

Como a fellowship se encaixa na estratégia de segurança da OpenAI

A fellowship não surge isolada. Há um fio condutor com iniciativas que abriram o ecossistema para contribuições externas. Em fevereiro de 2025, a OpenAI reabriu o Researcher Access Program, oferecendo créditos e acesso para projetos responsáveis, algo útil para quem já tem linha de pesquisa mas precisa de recursos para experimentos. Em paralelo, houve programas de acesso antecipado para testes de segurança em modelos de fronteira, voltados a red teaming, elicitação de capacidades e análises de segurança. O quadro de preparação para riscos de alto impacto também vem sendo atualizado para cada lançamento de modelo de fronteira.

O desenho da fellowship parece sintetizar essas lições. Em vez de dispersar iniciativas, a proposta cria um ciclo, com coorte, mentoria e entregáveis claros. É um passo natural após bug bounties temáticos, convites a red teamers e marcos de governança técnica como o Preparedness Framework.

![Logo da OpenAI, referência visual institucional]

Linha do tempo, elegibilidade e logística

Calendário e regras são específicos, e fazem diferença para quem precisa organizar apoio institucional ou folgas acadêmicas:

- Publicação e abertura de inscrições: 6 de abril de 2026. Fechamento: 3 de maio. Notificações aos aprovados: até 25 de julho.

- Período da coorte: 14 de setembro de 2026 a 5 de fevereiro de 2027.

- Local e formato: espaço em Berkeley com a Constellation e opção remota.

- Benefícios: bolsa mensal, mentoria, créditos de API e suporte de computação, sem acesso interno aos sistemas.

- Contato para dúvidas operacionais: openaifellows@constellation.org.

Vale atenção ao ponto do acesso. A OpenAI é clara ao vincular apoios como créditos de API às suas políticas de uso e ao enquadramento do programa. Há histórico de programas específicos para pesquisadores, com políticas de segurança e responsabilidade atreladas à concessão de recursos. Essa coerência reduz fricção entre pesquisa e operação, e estabelece expectativas claras.

Tópicos quentes para propostas com tração

Segurança de agentes e supervisão. A evolução de agentes com ferramentas aumenta superfícies de ataque, de injeção de prompt a exfiltração de segredos. Propostas que medem resiliência a ataques cross-site, cadeia de ferramentas, ou que automatizam detecção de desvio de objetivo tendem a ser valiosas. O bug bounty recente enfatiza exatamente classes como injeção de prompt e exfiltração.

Avaliações de risco de fronteira. O Preparedness Framework estabelece categorias de risco e práticas de revisão antes do lançamento de modelos de fronteira, e pede métricas e benchmarks confiáveis. Projetos que criem baterias de testes replicáveis, open source e calibradas com severidade real podem se tornar referência.

Privacidade e segurança por design. Métodos de mitigação que preservam privacidade, como filtros de dados sensíveis em pipelines de agentes, sandboxing robusto e avaliações de vazamento por canais auxiliares, respondem a requisitos explícitos do edital.

Robustez e alinhamento empírico. Técnicas de elicitação de capacidades perigosas, avaliação de jailbreaks, stress testing e guardrails dinâmicos são áreas maduras para pesquisa aplicada que vira prática. Coortes com mentoria e compute dedicado aceleram esses ciclos.

Boas práticas de submissão e execução

- Defina governança de dados desde o início. Descreva quais dados serão usados, como serão obtidos, rotulados e protegidos. Seja específico sobre consentimento, descarte e versionamento de datasets.

- Projete avaliações céticas. Evite overfitting a um único benchmark. Use métricas complementares, variação de prompts, seeds diferentes e cenários adversariais. Relate falhas e limites com a mesma clareza que resultados positivos.

- Planeje replicabilidade. Forneça instruções, seeds, hashes de datasets e scripts para que outros reproduzam resultados, incluindo parâmetros de geração, limites de taxa e detalhes de ambiente.

- Desenhe para integração. Se o objetivo é guardrail, proponha APIs e contratos claros que qualquer plataforma possa plugar, reduzindo custo de adoção.

Essas práticas casam bem com a intenção declarada de gerar saídas que beneficiem a comunidade, como benchmarks, rubricas e datasets, e com a cultura de convocar a comunidade para red teaming e bug bounties.

Como a comunidade pode aproveitar, mesmo sem ser fellow

Nem todo mundo terá agenda para cinco meses de dedicação estruturada. Ainda assim, há caminhos práticos para colaborar com a segurança do ecossistema OpenAI:

- Participar do programa de bug bounty focado em segurança, que aceita relatos sobre abusos e riscos em produtos, incluindo agentes, navegadores e exfiltração.

- Submeter estudos ao Researcher Access Program quando o escopo se encaixar, aproveitando créditos e acesso para perguntas específicas de segurança e alinhamento.

- Monitorar convites de acesso antecipado para testes de segurança em modelos de fronteira, uma frente criada para ampliar o escrutínio externo antes de grandes lançamentos.

- Usar e contribuir com benchmarks, checklists e repositórios públicos, fortalecendo o ciclo de melhoria contínua que o Preparedness Framework estimula.

![Diagrama de neurônio artificial, útil para explicar mitigadores e avaliações]

Reflexões finais sobre impacto e timing

O recado mais importante aqui é o timing. Com inscrições abertas até 3 de maio e notificações até 25 de julho, a janela para planejar, formar time e amarrar support letters é curta, mas suficiente para propostas bem direcionadas. O ciclo de 14 de setembro de 2026 a 5 de fevereiro de 2027 é longo o bastante para gerar ativos úteis e testá-los com a mentoria da OpenAI e a interação de coorte.

Vendo a trajetória recente, a OpenAI tenta orquestrar um pipeline de segurança que une detecção de vulnerabilidades, avaliações padronizadas, colaboração com especialistas externos e governança progressiva em riscos de fronteira. A Safety Fellowship funciona como hub dessa orquestração, criando um espaço onde hipóteses viram benchmarks, onde mitigadores são calibrados contra ataques do mundo real e onde práticas de privacidade e robustez podem migrar do paper para o produto.

Conclusão

A Safety Fellowship da OpenAI é uma oportunidade direta para transformar pesquisa em entregáveis que elevam o padrão de segurança em IA. O foco em áreas críticas, a mentoria estruturada e o suporte de computação reduzem o atrito clássico entre boa ideia e impacto verificável. Para pesquisadores externos que já tatearam limites de robustez, alinhamento e privacidade, o momento é agora, com inscrições até 3 de maio.

O campo de segurança em IA amadurece quando mede, publica e padroniza. Propostas que traduzem riscos em métricas reprodutíveis, e mitigadores em APIs integráveis, deixam legado além do ciclo da fellowship. É esse tipo de contribuição que o anúncio procura estimular, em sinergia com iniciativas de bug bounty, acesso antecipado para testes e quadros de preparação.