OpenAI lança Trusted Contact para segurança no ChatGPT

Trusted Contact chega ao ChatGPT para acionar alguém de confiança em casos de possível autoagressão, com revisão humana, notificações limitadas e foco em conexão real.

Danilo Gato

Autor

Introdução

Trusted Contact no ChatGPT começou a ser distribuído em 7 de maio de 2026 com um objetivo claro, conectar rapidamente o usuário a alguém de confiança quando houver indícios sérios de risco de autoagressão. A palavra-chave aqui é Trusted Contact, um recurso de segurança opcional para adultos que acrescenta uma camada humana à resposta do sistema.

O anúncio detalha que os sinais iniciais são detectados por sistemas automatizados e, antes de qualquer notificação, passam por revisão de uma equipe treinada. A notificação enviada ao contato de confiança é breve, não inclui transcrições de conversa e encoraja apenas um check-in respeitoso. A OpenAI afirma que busca revisar alertas em menos de uma hora e que o Trusted Contact complementa as linhas de apoio já exibidas pelo ChatGPT.

A importância do movimento está no cruzamento entre segurança do usuário, ética em IA e design de produtos que priorizam autonomia. O que segue explora como funciona, os limites e benefícios, a base científica, as implicações de privacidade e os reflexos para empresas e criadores de produtos digitais.

Como o Trusted Contact funciona na prática

O fluxo tem etapas objetivas. Primeiro, um usuário adulto, 18 anos ou mais, escolhe um contato de confiança nas configurações do ChatGPT. Em seguida, esse contato recebe um convite e precisa aceitar em até uma semana para que a relação fique ativa. Se os sistemas identificarem conversa que pode indicar risco de autoagressão, o ChatGPT avisa o usuário e sugere maneiras de iniciar um diálogo com o contato indicado. Depois, uma equipe especializada revisa a situação. Se houver preocupação séria, o contato de confiança recebe uma notificação breve por email, SMS ou notificação no app, caso também use ChatGPT.

Pontos operacionais importantes, a notificação não contém o conteúdo da conversa, o objetivo é incentivar um contato humano. Tanto o usuário pode remover ou editar o contato nas configurações, quanto o contato pode se remover a qualquer momento por links do próprio Centro de Ajuda. Em regiões específicas, há regras de idade, como 19 anos de idade mínima na Coreia do Sul.

Os materiais oficiais reforçam que ser contato de confiança não cria responsabilidade legal pela segurança da pessoa. A função é servir como ponto de apoio, ouvir, checar e, se necessário, ajudar na ponte com serviços profissionais. A própria página de ajuda indica que você não precisa ter conta no ChatGPT para aceitar o papel de contato de confiança.

Por que isso importa agora

O recurso aparece em um contexto de evolução das salvaguardas do ChatGPT, que incluem direcionamentos a linhas de ajuda locais, recusas a pedidos nocivos e respostas calibradas por nível de risco percebido na conversa. O post da OpenAI destaca trabalho com mais de 170 especialistas em saúde mental para melhorar detecção e resposta a sinais de sofrimento, bem como uma meta de revisão rápida quando um caso é sinalizado.

Outra peça do cenário é a presença de controles parentais introduzidos anteriormente para permitir que pais ou responsáveis recebam alertas em contas de adolescentes vinculadas quando houver sinais de risco agudo. Trusted Contact amplia essa lógica para qualquer adulto que deseje configurar um apoio confiável. Coberturas independentes reforçam o desenho do fluxo com revisão humana antes do envio de alertas.

Há uma tendência mais ampla no setor, com camadas novas de segurança de conta, verificação de idade e mecanismos de mitigação de abuso chegando ao ecossistema do ChatGPT. Mesmo que não estejam diretamente ligados ao Trusted Contact, essas iniciativas mostram uma estratégia contínua de elevar a barra de proteção ao usuário.

O que a ciência e os especialistas dizem sobre conexão social

A OpenAI cita diretrizes de saúde pública que tratam conexão social como fator protetor contra risco de suicídio. A lógica é simples e poderosa, contato humano empático, em tempo oportuno, pode reduzir isolamento e facilitar acesso a apoio formal. No anúncio, a empresa informa ter contado com orientação de clínicos, pesquisadores e organizações especializadas, incluindo a American Psychological Association. Embora não substitua cuidados profissionais, o Trusted Contact tenta tornar mais fácil pedir ajuda para alguém de confiança quando mais importa.

Em termos de design, reduzir atrito para chegar a uma pessoa confiável é uma alavanca forte. Muitas soluções de bem estar digital focam apenas em recusar conteúdos nocivos, mas a ponte real para o mundo offline é onde a intervenção se torna prática. Trusted Contact representa esse tipo de ponte, desenhada com notificações restritas e foco em autonomia do usuário.

Privacidade e limites, o que é e o que não é compartilhado

Transparência é central. O Centro de Ajuda esclarece que, se você aceitar ser o contato de confiança de alguém, a OpenAI pode processar seu nome, email e telefone para administrar convites, registrar sua resposta e operar as notificações. A empresa afirma que mantém esses dados pelo tempo necessário para operar o recurso e pode retê-los por mais tempo quando necessário para fins legais, de segurança ou prevenção de abuso. Notificações são limitadas e não incluem detalhes do chat.

Outro ponto essencial, o contato de confiança pode recusar o convite, deixar de ser contato quando quiser e não precisa ter uma conta no ChatGPT. Isso reduz barreiras de participação e preserva a agência das duas partes. A documentação multilíngue reforça as mesmas regras de forma consistente.

Sob a ótica de segurança de produto, vale notar que a OpenAI vem publicando cartões de sistema e relatórios de segurança que detalham salvaguardas, fluxos de detecção e planos de melhoria contínua. Embora esses documentos abordem escopos técnicos mais amplos, eles ajudam a entender como camadas de mitigação se combinam com novos recursos como o Trusted Contact.

Passo a passo para configurar e usar bem

- Escolha consciente do contato. Prefira alguém com quem haja relação constante, abertura para conversas difíceis e disponibilidade prática. As páginas oficiais dão orientações sobre como iniciar essa conversa e alinhar expectativas.

- Convite e aceite. O convidado recebe por email ou SMS uma explicação do papel. Há prazo de uma semana para aceitar e ativar a relação.

- Revisão humana antes de alertas. Caso haja sinais sérios de risco de autoagressão, uma equipe especializada revisa o caso e, apenas se confirmar a preocupação, envia notificação breve ao contato.

- Remoção e ajustes. O usuário pode editar ou remover o contato, e o contato pode se retirar quando quiser, pelos próprios links de gerenciamento.

Boas práticas adicionais para conversas sensíveis com quem pede ajuda,

- Comece com empatia. Perguntas abertas e sem julgamento tendem a gerar segurança.

- Ofereça presença, não soluções imediatas. Muitas vezes, escuta atenta vale mais que conselhos acelerados.

- Combine próximos passos práticos. Se necessário, ajude a pessoa a falar com profissionais e linhas de apoio locais.

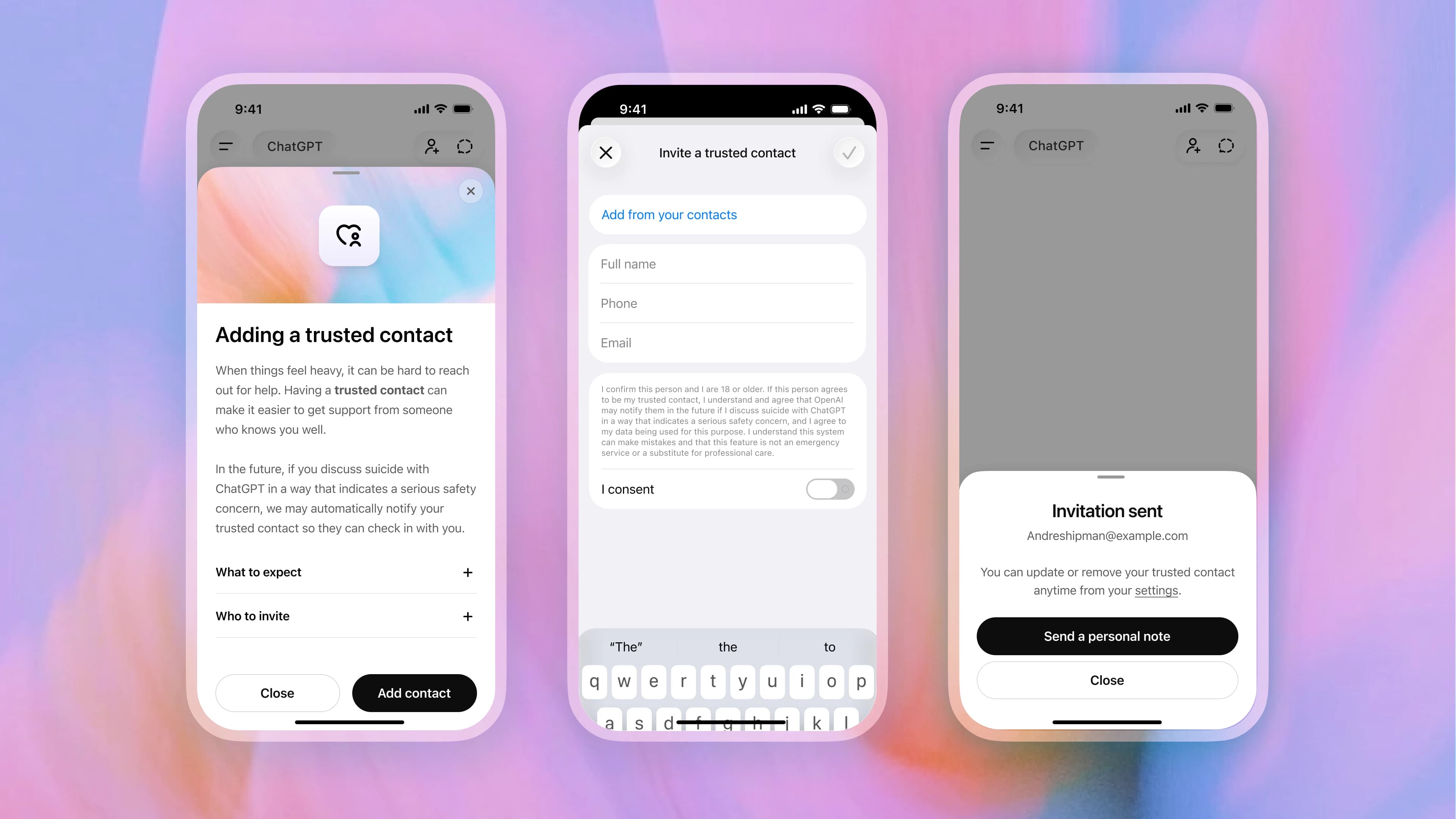

![Exemplo de telas do ChatGPT para adicionar contato de confiança]

O que muda para empresas, escolas e equipes de produto

- Políticas internas. Organizações que oferecem ChatGPT a funcionários ou alunos ganham argumento para incluir protocolos de apoio em casos de risco. Mesmo sendo um recurso pessoal e opcional, vale formalizar fluxos de comunicação e encaminhamento.

- Treinamentos. Líderes e equipes de RH podem reforçar habilidades de escuta ativa e primeiros passos em situações de crise, sempre com limites claros e com orientação para serviços profissionais. Materiais públicos de saúde reconhecem a conexão social como fator de proteção, o que sustenta treinamentos baseados em evidência.

- Integração de UX responsável. Designers e PMs podem estudar como o ChatGPT equilibra autonomia do usuário, consentimento e mínima exposição de dados ao construir uma ponte para suporte offline.

- Medição e melhoria. Indicadores como tempo de revisão, taxa de aceitação de convites e desfechos de contato podem orientar iteração de políticas internas de bem estar digital, sempre com privacidade no centro.

Benefícios e riscos, visão equilibrada

Benefícios claros,

- Conexão humana em momentos de risco. Uma notificação breve, enviada rápido, pode ser o empurrão necessário para um check-in que salva vidas.

- Privacidade respeitada. O conteúdo do chat não é compartilhado, o alerta é intencionalmente limitado e há revisão humana antes de qualquer envio.

- Autonomia preservada. Tanto o usuário quanto o contato podem editar ou encerrar a relação facilmente.

Riscos e limites a observar,

- Falsos positivos e contexto. Mesmo com revisão humana, nenhum sistema capta nuances de toda conversa. Alertas podem não refletir exatamente a experiência da pessoa. A OpenAI reconhece esse limite.

- Expectativas de responsabilidade. Contatos de confiança não substituem profissionais e não devem ser vistos como socorristas. Comunicação clara evita sobrecarga emocional e confusões legais.

- Diferentes percepções públicas. Discussões sobre guardrails de segurança no ecossistema do ChatGPT mostram que partes da comunidade querem sistemas mais protetivos, outras querem menos interferência. O desafio é calibrar proteção sem sufocar utilidade.

![Exemplo de notificação para contato de confiança em caso de crise]

Perguntas frequentes essenciais

- Quem pode ser meu contato de confiança. Alguém adulto, com quem exista relação contínua e abertura para conversas difíceis. As páginas oficiais sugerem iniciar o diálogo de forma direta e empática.

- E se o convite expirar. O convite vence após uma semana. É possível reenviar para a mesma pessoa ou escolher outra.

- Preciso ter conta no ChatGPT para aceitar. Não é necessário. A pessoa pode receber e gerenciar convites e notificações sem conta.

- A OpenAI compartilha o que comigo. Apenas a razão geral do alerta, pedindo um check-in. Não há compartilhamento do conteúdo do chat.

- Posso sair quando quiser. Sim, o contato de confiança pode se remover a qualquer momento, e o usuário pode trocar ou remover seu contato nas configurações.

Sinais de maturidade em segurança de produto

Trusted Contact não surge isolado. Notas de versão recentes citam aprimoramentos no modo como o ChatGPT detecta, responde e encaminha usuários a recursos locais. A publicação do recurso em 7 de maio de 2026 também vem acompanhada de materiais de apoio e referências a redes de especialistas, o que sugere um ciclo de desenvolvimento com validação clínica e governança.

Relatos de imprensa especializados destacam que a revisão humana é etapa obrigatória antes do envio de notificações, um freio útil contra alarmes indevidos. Em paralelo, outras novidades de segurança de conta e medidas de idade mostram que o produto segue em evolução, com atenção a usuários de maior risco.

Reflexões e insights

Trusted Contact reforça um princípio simples, tecnologia deve aumentar a rede de apoio humana, não substituí-la. Criar atalhos para conectar pessoas em momentos difíceis é uma decisão de produto que tende a gerar impacto desproporcional frente ao esforço técnico. Ao mesmo tempo, é crucial manter humildade operacional, nenhum classificador acerta sempre, nenhuma revisão humana alcança todo contexto. A transparência sobre limites e a capacidade de correção rápida contam muito.

Outra lição valiosa para quem cria produtos, o recurso respeita consentimento e reduz exposição de dados, convite com aceite explícito, notificação limitada, opt out fácil. Esse desenho com foco em privacidade e autonomia ajuda a transformar uma funcionalidade sensível em algo que usuários podem adotar com confiança. Em ambientes corporativos, isso sinaliza direção para integrar bem estar digital em políticas de segurança e cultura organizacional, sempre com mensuração responsável e apoio profissional quando necessário.

Conclusão

Trusted Contact no ChatGPT adiciona uma ponte humana a um problema eminentemente humano. Com detecção assistida por IA, revisão especializada e alertas mínimos, o recurso tenta equilibrar proteção, privacidade e autonomia. Para quem usa o ChatGPT no dia a dia, vale considerar a configuração de um contato de confiança, alinhando expectativas e combinando como esse apoio deve funcionar.

O movimento indica uma trajetória clara, mais camadas de segurança que não travam o produto, mas conectam pessoas e serviços do mundo real. Se tecnologia é sobre encurtar distâncias, encurtar a distância para pedir ajuda talvez seja uma das funções mais importantes que um assistente de IA pode executar hoje.