Pentágono irritado com Anthropic por drones e vigilância

Relatos de tensão entre o Departamento de Defesa e a Anthropic escancaram o novo campo de batalha da IA, onde contratos bilionários esbarram em limites éticos sobre enxames de drones e vigilância em massa.

Danilo Gato

Autor

Introdução

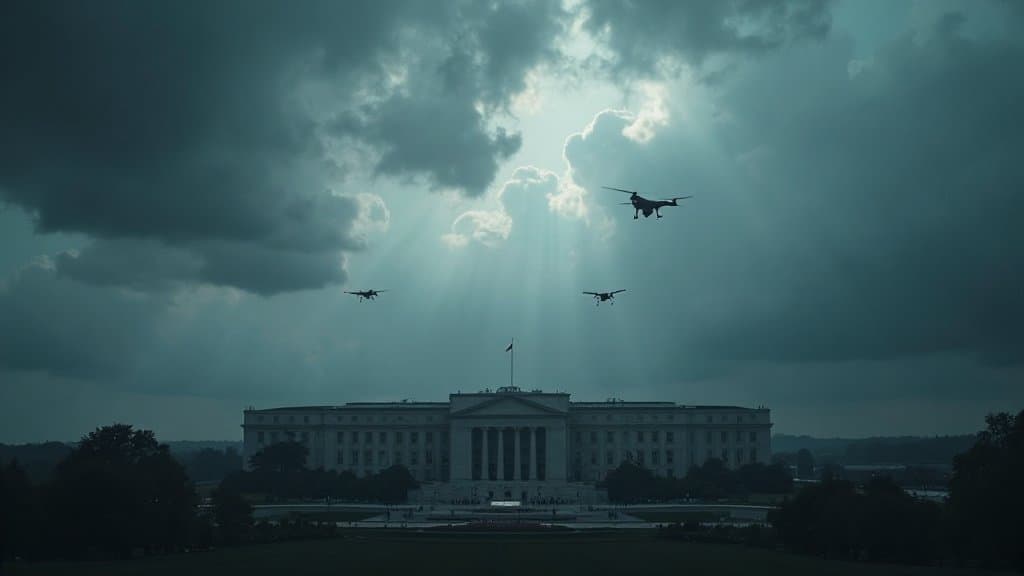

Pentágono irritado com Anthropic, essa é a palavra chave que define a semana em IA. Segundo reportagens, o Departamento de Defesa considera encerrar ou reduzir a parceria com a Anthropic devido às restrições impostas pela empresa para usos militares dos seus modelos, incluindo enxames de drones e vigilância em massa. Esse atrito cristaliza o dilema que domina a IA em 2026, desempenho e flexibilidade operacional de um lado, salvaguardas e limites éticos do outro.

A importância vai além de um contrato. Claude, modelo da Anthropic, foi um dos primeiros a operar em redes classificadas do governo, após um acordo com teto de 200 milhões de dólares firmado no verão de 2025. Se a ruptura acontecer, o recado para todo o ecossistema será direto, o padrão exigido pelo governo, uso para todos os fins legais, tende a suplantar cláusulas de não uso em armamentos autônomos e vigilância doméstica.

O artigo detalha o que as fontes confiáveis reportaram, por que enxames de drones e vigilância em massa viraram os pontos de maior atrito, o que muda para outras big techs de IA e como líderes técnicos e times de compliance devem reagir sem drama, com pragmatismo, risco calculado e estratégia.

O que exatamente está acontecendo entre Pentágono e Anthropic

Relato central, uma fonte sênior do governo disse à Axios que o Pentágono estuda cortar a Anthropic por ela manter limites de uso, em especial contra vigilância em massa de americanos e contra armas totalmente autônomas. A mesma fonte descreveu a empresa como a mais ideológica entre os grandes laboratórios. Do outro lado, a Anthropic afirma apoiar a segurança nacional, mas sustenta que essas duas salvaguardas são não negociáveis.

Outro ponto que elevou a tensão, segundo a Axios e repercussões, foi o suposto uso do Claude em uma operação militar recente, via integração com parceiros como a Palantir. A Anthropic negou discutir operações específicas e reforçou que as conversas com o governo focam em sua política de uso, não em missões em andamento. Aqui, o sinal é claro, mesmo quando há integração em ambientes de missão, a Anthropic quer blindagens ex ante para cenários de risco alto, como letalidade sem humano no circuito e vigilância massiva.

A Gizmodo acrescenta que, além de rever o relacionamento, o Pentágono cogita rotular a Anthropic como risco de cadeia de suprimentos, movimento que poderia obrigar fornecedores de defesa a cortarem laços com a empresa. É uma alavanca de pressão rara e pesada, tipicamente associada a riscos geopolíticos, que, se adotada, reconfiguraria o mercado de IA para defesa.

Por que “enxames de drones” e “vigilância em massa” viraram linha vermelha

Enxames de drones prometem custo baixo, escala e saturação de defesas, além de coordenação algorítmica em tempo real. O problema, apontado em entrevistas e discursos públicos, é a erosão do princípio humano no circuito, uma proteção constitucional e operacional falível, porém essencial. Em conversa recente, o CEO da Anthropic, Dario Amodei, discutiu o risco de perder esse freio quando sistemas passam a decidir autonomamente sobre força letal. O tema aparece nas coberturas como a principal preocupação técnica e cívica da empresa.

Quanto à vigilância em massa, a convergência de captura ubíqua de imagens, transcrição de áudio, reconhecimento de padrões e correlação cruzada de bases cria, na prática, uma máquina de indexação social. Em ambientes democráticos, limites processuais e jurisprudência impõem freios, porém a capacidade técnica de varrer espaços públicos e correlacionar identidades em escala nacional muda a natureza do risco. As reportagens ressaltam que a Anthropic classifica esse uso como proibido em suas políticas, o que bate de frente com a exigência governamental de disponibilidade para todos os fins legais.

![Soldados treinam contra ataque de enxame de drones]

O peso do contrato e o precedente nas redes classificadas

O valor simbólico e prático do acordo de até 200 milhões de dólares é decisivo. Ao levar seus modelos a redes classificadas sob a tutela do CDAO, a Anthropic ajudou a abrir a porteira para que a IA generativa migrasse de protótipos para missões com dados sensíveis. Bloomberg e a própria Anthropic documentaram esse passo, que inclui versões como Claude Gov e integrações com infraestrutura AWS. Interromper essa trilha significaria redesenhar contratos, pipelines de dados e operações de parceiros como integradores de missão.

Segundo a Axios, outras casas, OpenAI, Google e xAI, já aceitaram suspender guardrails para usos militares em ambientes não classificados e negociam a ida para o espaço classificado sob a norma todos os fins legais. Uma das três teria aceitado integralmente, as outras mostram mais flexibilidade do que a Anthropic. O quadro competitivo pressiona, quem ceder mais rápido às regras do cliente estatal pode ganhar tração tática, mas assume passivos éticos e de imagem com o público e com talentos internos.

O que as novas exigências do Pentágono significam para o setor

A expressão todos os fins legais simplifica governança para o usuário estatal, porém redistribui o ônus regulatório para dentro da empresa de IA, que terá de auditar riscos ex post em vez de barrá‑los ex ante por política. Isso muda prioridades de P&D, desde red teaming a avaliação de agentes autônomos, e amplia a necessidade de trilhas de auditoria robustas, logging inviolável e kill switches acionáveis em cenários de escalada inesperada.

Para quem vende IA, três frentes precisam andar juntas, técnica, jurídica e cultural. Técnica, fortalecer avaliação de capacidades perigosas, filtros dinâmicos por contexto e controles de uso em nível de parceiro. Jurídica, cláusulas de recusas específicas, carve‑outs com linguagem cristalina e matrizes de conformidade por jurisdição. Cultural, governança interna que suporte dissenso técnico sem paralisar a execução, algo apontado por fontes como um fator de atrito na Anthropic e que, em outras empresas, tende a emergir quando a percepção de risco moral cresce.

Como outras empresas estão se posicionando

Coberturas recentes indicam que OpenAI, Google e xAI aceitaram modular as restrições para usos militares não classificados, com movimentos para levar modelos a ambientes classificados seguindo a regra ampla do governo. A Gizmodo relatou que o GenAI.mil, plataforma corporativa do Departamento, já serve milhões de usuários internos e recebeu versões customizadas de ChatGPT, além de integrações com outros fornecedores, sinalizando uma padronização operacional. Esse cenário aumenta o custo de oportunidade para quem tenta manter carve‑outs rígidos.

A Wired sintetiza o pano de fundo, a disputa não é apenas contratual, é filosófica. Se a IA de uso geral for absorvida como utilitário bélico sem salvaguardas, a pressão competitiva tenderá a empurrar limites, acelerando uma corrida em que o freio ético vira desvantagem estratégica. Esse diagnóstico ecoa debates de segurança de IA e aponta para uma dinâmica de soma negativa caso governos priorizem imediatismo operacional sobre governança.

Dados, cronologia e o que já foi confirmado

– 14 de fevereiro de 2026, a Axios publica reportagem exclusiva sobre a ameaça de corte de laços com a Anthropic, mencionando a insistência do Pentágono no padrão todos os fins legais e destacando as duas exceções que a Anthropic mantém, armas totalmente autônomas e vigilância doméstica em massa.

– 15 de fevereiro de 2026, a Gizmodo repercute o tema, reforçando que enxames de drones e vigilância são pontos centrais de conflito e citando declarações públicas de Dario Amodei sobre riscos de autonomia letal e abusos de vigilância.

– 17 de fevereiro de 2026, nova matéria da Gizmodo relata que o Pentágono avalia classificar a Anthropic como risco de cadeia de suprimentos, medida que poderia obrigar fornecedores a se desvincular da empresa. O texto também lembra o contrato de até 200 milhões de dólares e o avanço do GenAI.mil.

– 20 de fevereiro de 2026, a Wired contextualiza a disputa como sintoma do choque entre segurança de IA e demandas militares, apontando que a etiqueta de risco de cadeia de suprimentos seria um divisor de águas no relacionamento governo, indústria.

– Julho de 2025, registro oficial da Anthropic e cobertura da Bloomberg confirmam o acordo com teto de 200 milhões de dólares e o plano de levar IA de ponta a fluxos de missão e a redes classificadas.

![Pentágono visto do alto, símbolo do debate sobre IA militar]

Implicações práticas para times de produto, jurídico e segurança

– Políticas de uso com gatilhos verificáveis, políticas genéricas precisam de anexos operacionais, por exemplo, definição objetiva de o que é autônomo sem humano no circuito e como auditar presença humana relevante, com requisitos mínimos de latência de confirmação, logs de decisão e trilhas de responsabilidade.

– Controles de execução no runtime, além de filtros de prompt, aplicar restrições em nível de API por tenant, subtenant e caso de uso, com listas de bloqueio que podem ser atualizadas via governança e não apenas via release de modelo. Isso evita que um ajuste local quebre o serviço inteiro em ambiente de missão.

– Auditoria e forense desde o design, versionar políticas e bibliotecas de segurança, assinar artefatos e manter verificação contínua de integridade. Adoção de kill switch documentado por fluxo, inclusive para agentes autônomos e ferramentas com poder de ação em sistemas externos, como controladores de drones.

– Backstops contratuais, cláusulas de recusa específica amarradas a matrizes de risco e a uma lista de usos proibidos, com processos de alteração formal. Se o cliente exigir todos os fins legais, considerar anexar uma política de exceções acordadas, com instâncias de escalonamento que incluam comitês de ética independentes.

– Gestão de talentos e cultura, a Axios menciona inquietações internas na Anthropic com o caminho da defesa. Esse é um risco transversal, perdas de talentos críticos tendem a ocorrer quando há desalinhamento entre compromissos públicos e a prática contratual. Lideranças precisam comunicar princípios, mas também rotas de mitigação e critérios para aceitar ou recusar contratos.

O que governos e reguladores podem aprender com o caso

– Especificidade reduz litígio, em vez de cláusulas amplas, definir limites positivos e negativos para IA militar, por exemplo, proibição de targeting letal sem humano no circuito, parâmetros mínimos de intervenção humana e escopos estritos para vigilância em massa com auditorias externas obrigatórias.

– Transparência proporcional, contratos sensíveis não são abertos, porém relatórios periódicos de segurança e impacto com métricas padronizadas sustentam confiança pública e evitam decisões ad hoc com efeitos colaterais reputacionais.

– Interoperabilidade com governança, se o Estado quer alternar fornecedores sem quebrar operações, deve exigir padrões de logging, exportabilidade de trilhas de auditoria e testes de substituição controlada, o que mitiga vendor lock‑in mesmo quando políticas de uso diferem.

Reflexões e insights ao longo do caminho

A controvérsia mostra que ética aplicada não é manifesto, é arquitetura. Modelos que rodam em redes classificadas, como a própria Anthropic descreve, precisam ser configuráveis por contexto, caso contrário a fricção entre política e missão explode no ponto mais caro do contrato, a entrega. Ao mesmo tempo, aceitar sem ressalvas o padrão todos os fins legais pode turbinar a adoção hoje, mas amplia o risco de amanhã, seja por incidentes operacionais, seja por êxodo de talentos e reação do mercado consumidor civil.

Outro aprendizado, a narrativa pública pesa. Quando veículos como Axios, Gizmodo e Wired cobrem o tema em sequência, investidores, parceiros e equipes internas reprecificam risco reputacional. Tentar disputar manchete com comunicado lacônico quase nunca funciona. Melhora quando há roteiro claro, o que aceitamos, o que não aceitamos, por quê e como auditamos na prática.

Conclusão

O embate entre Pentágono e Anthropic não é apenas sobre uma cláusula contratual, é sobre quem segura o volante quando a IA cruza o limiar entre recomendação e ação. Enxames de drones e vigilância em massa concentram riscos técnicos e institucionais difíceis de reverter. Se o governo insistir em todos os fins legais sem balizas, e se as empresas aceitarem por conveniência, o setor pode acordar com uma nova normalidade na qual exceções éticas viram anomalias.

Para líderes de tecnologia e negócios, a rota mais inteligente combina realismo e princípio, construir produtos e contratos que suportem exigências legítimas de segurança nacional, mas que, ao mesmo tempo, preservem limites verificáveis contra a erosão do humano no circuito e contra a indexação total da vida pública. Quem dominar essa engenharia de compromisso terá vantagem duradoura, na defesa e no mercado civil.