Runway e NVIDIA: vídeo HD tempo real Vera Rubin, 1º<100 ms

Runway e NVIDIA antecipam um modelo de vídeo em tempo real em HD rodando na plataforma Vera Rubin, com primeiro quadro abaixo de 100 ms, apontando um salto de latência e escalabilidade para geração de vídeo e world models.

Danilo Gato

Autor

Introdução

Runway e NVIDIA mostraram um modelo de vídeo em tempo real em HD rodando na plataforma Vera Rubin, com primeiro quadro abaixo de 100 ms, sinal de que a geração de vídeo está prestes a ganhar interatividade de verdade. Esse avanço em vídeo em tempo real em HD reduz a fricção entre prompt e visual, encurtando o ciclo de iteração para criadores e para pipelines de produção. A demonstração conecta uma peça técnica clara, latência sub 100 ms no primeiro frame, a um ecossistema de hardware projetado para escala de inferência sustentada.

A importância desse movimento fica ainda mais evidente quando se observa o que a própria NVIDIA vem detalhando sobre o Rubin NVL72, um rack com 72 GPUs Rubin e 36 CPUs Vera, projetado para operar como um único acelerador em escala de fábrica de IA. O objetivo é manter latência previsível, alto aproveitamento e custo por token reduzido, fatores críticos para vídeo generativo e world models, inclusive em cenários sempre ativos.

O que está por trás do “1º quadro sub 100 ms”

A queda de latência no primeiro frame importa porque define a sensação de resposta do sistema. Se o primeiro quadro aparece em menos de 100 ms, a interação se aproxima do tempo humano de reação, o que viabiliza experiências exploráveis de câmera, personagem e mundo com feedback quase instantâneo. Essa meta técnica conversa com a arquitetura Rubin, que combina CPU Vera e GPU Rubin com NVLink-C2C, além de uma malha NVLink 6 por rack, para reduzir gargalos de coordenação entre componentes. Na prática, isso diminui overhead e melhora o encadeamento de etapas de inferência e pós-processamento em modelos de vídeo.

Outro ponto é a previsibilidade. A NVIDIA enfatiza que o NVL72 foi desenhado não só para pico, mas para produção sustentada de “inteligência”, com latência previsível e alta utilização sob cargas heterogêneas. Em vídeo generativo, quedas e picos de latência prejudicam a experiência, já que edição e direção em tempo real exigem constância entre requisições. A promessa do Rubin é manter esse fluxo estável mesmo em jobs multiusuário e multi-tenant.

Vera Rubin NVL72, os números que habilitam vídeo em tempo real

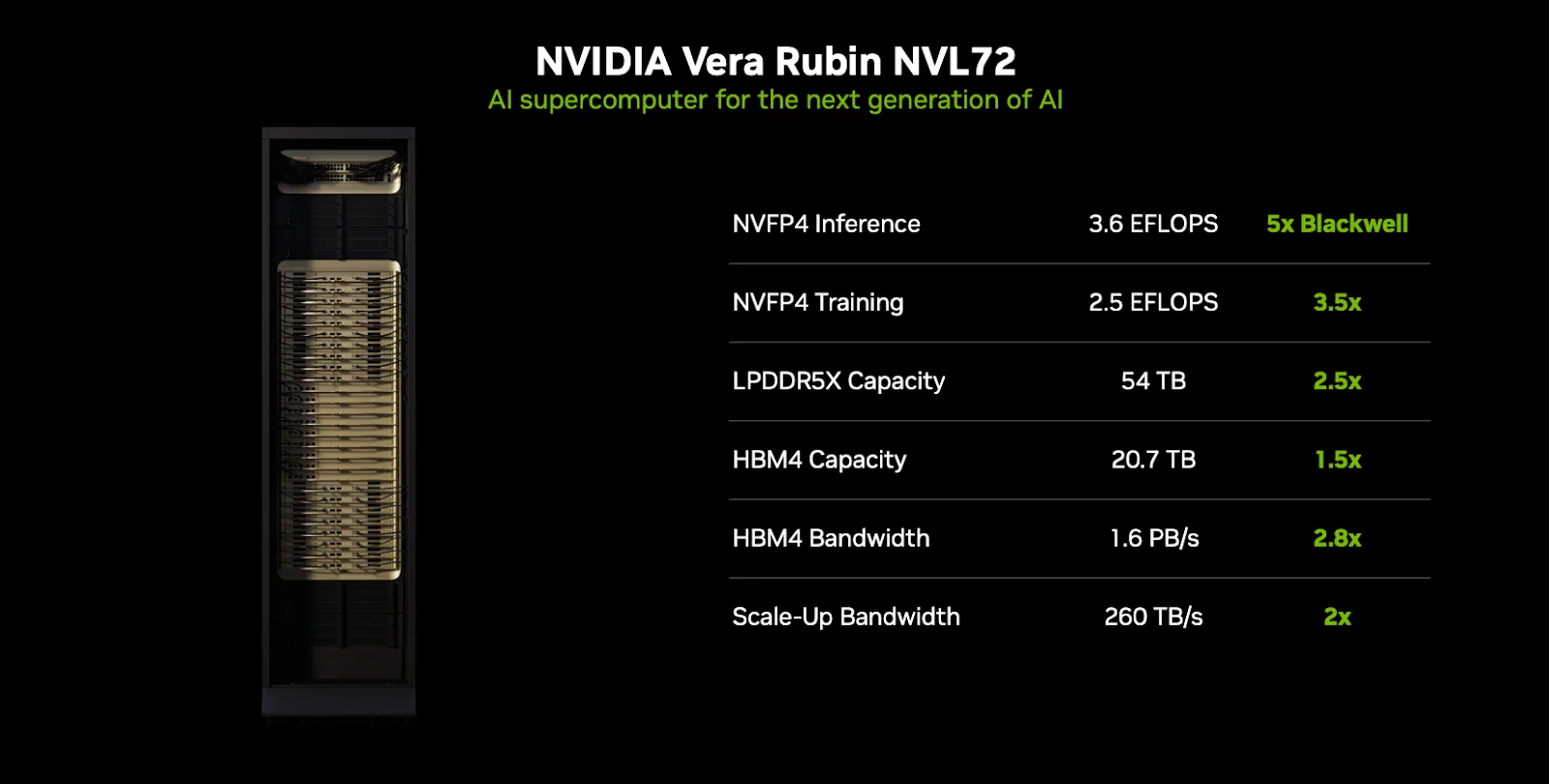

O NVL72 integra 72 GPUs Rubin e 36 CPUs Vera em um único rack, alcançando 3.6 exaFLOPS NVFP4 de inferência por rack, com 260 TB/s de banda de escala interna via NVLink 6. Por GPU, a plataforma atinge 50 petaflops NVFP4 dedicados à inferência, um salto pensado para cargas intensivas como vídeo generativo de alta fidelidade. Esses números não são cosmética, são o fundamento para expandir janelas de contexto, estabilizar frame rate e manter consistência visual sob prompts complexos.

Além do poder de computação, a integração importa. O superchip Vera Rubin, que acopla duas GPUs Rubin a uma CPU Vera com memória coerente, elimina parte do custo de mover dados entre domínios, algo que penaliza fortemente pipelines de vídeo. Essa conexão de alta largura de banda e baixa latência ajuda a orquestrar difusão, condicionamentos de imagem e áudio, e controles de câmera quase em tempo real.

Runway Gen‑4.5 e GWM‑1, do lab para a produção

Runway portou o Gen‑4.5 de Hopper para Vera Rubin NVL72 em um único dia, destacando compatibilidade retroativa e prontidão de produção. A empresa descreve o Gen‑4.5 como o modelo de vídeo mais bem avaliado no mercado e aponta que o Rubin foi projetado para acelerar geração de vídeo em tempo real, mais longa e de alta fidelidade. Essa portabilidade rápida sugere que criadores e estúdios poderão migrar fluxos existentes, preservando ferramentas e controles que já utilizam.

No mesmo anúncio, a Runway enfatiza o GWM‑1, sua primeira família de world models, com simulação quadro a quadro do ambiente, controle interativo e execução em tempo real. Essa linha de pesquisa muda a lógica do “gerar frame” para “simular mundo”, o que exige exatamente o que Rubin entrega, grande throughput com latência controlada. Em termos práticos, mundos exploráveis, robótica e avatares interativos pedem previsibilidade e estabilidade que reduzam jitter entre entradas do usuário e saídas visuais.

![Rack Rubin NVL72 com métricas de desempenho]

Por que latência e banda importam tanto para vídeo em tempo real em HD

Vídeo em tempo real em HD é um problema de orquestração. Cada requisição envolve codificação de prompt, condicionamento com imagem inicial, difusão, upscaling e, cada vez mais, áudio sincronizado e controles de câmera. A NVIDIA detalha que o NVL72 foi definido para “produção sustentada”, com foco em latência previsível e alta utilização. Isso significa menos tempo ocioso entre estágios, menos contentions na malha e melhor paralelismo entre GPUs. Para o criador, o efeito aparece como feedback imediato ao ajustar prompt, seed, keyframes e rigging de câmera.

Do lado de rede, a combinação de NVLink 6 por GPU e Spectrum‑X para escalar além do rack reduz gargalos nas fases sincronizadas de inferência, que são típicas em difusão com condicionamentos múltiplos. O resultado é um pipeline que sustenta taxa de quadros mais estável e suporta sessões interativas multiusuário, sem degradar quando a demanda cresce. Para estúdios e plataformas, isso abre espaço para colaboração em tempo real, com diretores, artistas de lookdev e editores trabalhando no mesmo take.

Casos práticos, do set virtual à robótica

Criação de cenas cinematográficas interativas. Com Gen‑4.5 rodando em Rubin, a direção pode travar elementos no primeiro quadro, ajustar iluminação e bloquear movimentos com respostas quase imediatas. A Runway documenta que o Gen‑4.5 mantém fidelidade e coerência, enquanto o Rubin provê o fôlego de inferência para sequências mais longas. Em uma sessão de direção virtual, isso se traduz em menos render reativo e mais iteração criativa.

World models e simulação física. O GWM‑1 foi desenhado para simular ambientes em tempo real, aceitar ações, comandos de câmera e até instruções de robótica. Na prática, isso possibilita treinar políticas com vídeo sintético de alta qualidade e testar comportamentos em mundos consistentes. O ganho não é apenas qualitativo, é econômico, já que Rubin mira custo por token de inferência até 10 vezes menor que Blackwell, além de redução de GPUs necessárias no treinamento de MoE.

Publicação e distribuição. Para plataformas que precisam gerar centenas de variações por ativo, a promessa de 50 PF por GPU em inferência soma com a latência inicial sub 100 ms para habilitar experiências personalizadas. Trailers interativos, publicidade adaptativa e assets para jogos com edição dinâmica dependem exatamente desse perfil de throughput e resposta.

![Parceria Runway e NVIDIA para acelerar vídeo e world models]

O que a arquitetura Rubin muda no TCO e na operação

A NVIDIA posiciona Rubin como um corte de custo por token de inferência de até 10 vezes frente a Blackwell, com redução de 4 vezes no número de GPUs para treinar modelos MoE no mesmo tempo. Essa combinação altera o TCO do vídeo generativo porque barateia iterações e amplia o número de sessões simultâneas possíveis com a mesma infraestrutura. Em linguagem de estúdio, mais takes por hora, mais variações por cena e menos espera entre controles e resultados.

No nível de serviço, a modularidade do compute tray e o design sem cabos agilizam manutenção, e a malha NVLink 6 com computação no fabric reduz overhead de coletivas e roteamento em MoE. O efeito líquido é previsibilidade, o que se traduz em SLAs factíveis para produtos interativos baseados em vídeo. Para equipes que escalam mundialmente, o Spectrum‑X ajuda a manter performance eficaz alta em data centers distribuídos, outro requisito para sessões ao vivo e colaboração remota.

Limites atuais e o que observar nos próximos meses

Mesmo com latência inicial sub 100 ms, a experiência de vídeo em tempo real em HD depende do encadeamento de vários estágios. Vale observar: estabilidade de frame rate sob carga multiusuário, consistência de identidade e estilo em sequências longas e sincronização de áudio gerado nativo. Relatos públicos sobre Gen‑4 e Gen‑4.5 indicam que coerência e velocidade vêm evoluindo, mas que prompts complexos e cenas com muita ação ainda podem exigir tentativas extras. A migração para Rubin deve aliviar parte desses gargalos, desde que o software esteja plenamente otimizado para a nova malha.

Outro ponto é a disponibilidade comercial. A NVIDIA informa que o Rubin está em produção, com disponibilidade de produtos no segundo semestre de 2026 via parceiros, e que provedores de nuvem líderes planejam ofertar instâncias. Para times que desejam explorar vídeo interativo agora, o caminho é participar de prévias e pilots, enquanto se prepara a infraestrutura e se valida o tooling para quando as instâncias estiverem amplamente disponíveis.

Conclusão

A prévia da Runway com a NVIDIA, com primeiro quadro sub 100 ms em vídeo em tempo real em HD na plataforma Vera Rubin, sinaliza a chegada de uma nova geração de ferramentas criativas. A combinação de throughput por GPU, malha de baixa latência e portabilidade do Gen‑4.5 e do GWM‑1 aproxima vídeo generativo de uma experiência verdadeiramente interativa, útil para sets virtuais, publicidade dinâmica, jogos e robótica.

A arquitetura Rubin foi pensada para produção sustentada. Se as promessas de custo por token e previsibilidade se confirmarem em escala, o mercado deve ver mais sessões colaborativas em tempo real, maior cadência de versões e menos atrito entre direção e execução. O resultado esperado é simples, mais criação com menos espera, e um pipeline que transforma o prompt em imagem em intervalos que começam a se parecer com conversa.