SI Inc lança modelo geral de ação no computador, 11 mi h

FDM-1 chega como um modelo de ação em computador treinado em 11 milhões de horas de vídeo, com encoder de vídeo de alta compressão e demos que vão de CAD a direção autônoma

Danilo Gato

Autor

Introdução

FDM-1, o novo modelo de ação em computador da Standard Intelligence, foi treinado em 11 milhões de horas de vídeo e opera direto no fluxo visual, não em capturas de tela isoladas. Essa proposta recoloca o modelo de ação em computador no centro da corrida por agentes que executam tarefas digitais longas, como CAD, testes de interface e até condução com entradas de teclado, em vez de depender de anotações caras ou janelas de contexto curtas.

A empresa detalha uma arquitetura que combina um encoder de vídeo altamente eficiente, um modelo de inversão de dinâmica para rotular ações e um modelo preditivo de próximas ações. O objetivo não é assistentes que apenas descrevem a tela, e sim sistemas que realmente tomam decisões de mouse e teclado ao longo de minutos, até horas, mantendo 30 quadros por segundo quando necessário.

O artigo explica a diferença de abordagem em relação à tradição de treinar VLMs em poucas capturas de tela rotuladas. Com o FDM-1, a base é vídeo longo, rotulado por um IDM que aprende a inferir ações, o que viabiliza escala em um domínio historicamente limitado por dados. O resultado é um caminho mais direto para um agente que usa software de forma competente e prolongada.

Por que um modelo de ação em computador baseado em vídeo importa

A maior barreira para agentes que usam aplicativos complexos sempre foi a falta de dados de ação em escala. Em geral, coletar anotações humanas para cada clique e tecla é caro, o que limita datasets a poucas horas de tela. O post técnico da SI ressalta que o maior dataset aberto de ações em tela tinha menos de 20 horas de vídeo a 30 FPS, muito aquém do que é necessário para tarefas com horizonte longo.

O FDM-1 muda o jogo com duas alavancas. Primeiro, o uso de um IDM que aprende a inferir teclas e movimentos a partir de frames, permitindo rotular automaticamente milhões de horas de vídeos da internet. Segundo, um encoder de vídeo que comprime quase duas horas de vídeo, a 30 FPS, em cerca de 1 milhão de tokens, um salto de eficiência em relação a abordagens que queimam essa mesma cota de tokens em um minuto. Essa combinação leva a área do regime limitado por dados para um regime limitado por computação.

Como o FDM-1 foi treinado, do IDM ao modelo de dinâmica direta

A receita de treinamento é composta por três estágios. Primeiro, um IDM treinado com 40 mil horas de gravações rotuladas por contratados. Depois, o IDM rotula o grande corpus de 11 milhões de horas. Por fim, um modelo de dinâmica direta aprende, de forma autoregressiva, a prever a próxima ação no espaço de tokens que representa teclas, cliques, deltas de mouse e rolagem. Essa tokenização cobre o que um humano faz na máquina, do digitar ao arrastar, com granularidade suficiente para generalizar.

Esse pipeline se inspira em avanços prévios de pré-treinamento via vídeo não rotulado. O VPT, da OpenAI, mostrou que é possível aprender a agir assistindo vídeos online, usando um IDM para rotular o domínio do Minecraft, depois refinando o agente para metas mais difíceis. A diferença agora é escopo e contexto, o FDM-1 mira computação geral e minutos a horas de histórico, enquanto o VPT trabalhou com janelas da ordem de segundos.

O encoder de vídeo, por que a compressão certa muda tudo

Na prática, o que limita agentes que “veem” a tela é quantos frames cabem no contexto do modelo. A SI publica estimativas comparativas sugerindo que, com 200 mil tokens, seu encoder acomoda muito mais frames do que encoders típicos usados em APIs populares. O post confronta, por exemplo, contagens de tokens por frame reportadas na documentação pública de Gemini, de ChatGPT Computer Use e de Claude Vision, e compara com um tokenizador de vídeo da NVIDIA como referência de compressão. Mesmo com suposições, a conclusão é clara, sem encoder eficiente, a janela de contexto útil desaba.

O ganho prático desse encoder aparece nas demos. Com janelas de 32k, 200k e 1 milhão de tokens, o FDM-1 chega a processar de minutos a quase duas horas de vídeo contínuo, mantendo texto legível em UI e continuidade de movimento. Essa continuidade é o que permite, por exemplo, concluir sequências de CAD com múltiplas operações e lambdas de teste de interface que exigem estado.

Casos práticos, CAD, direção e fuzzing de UI

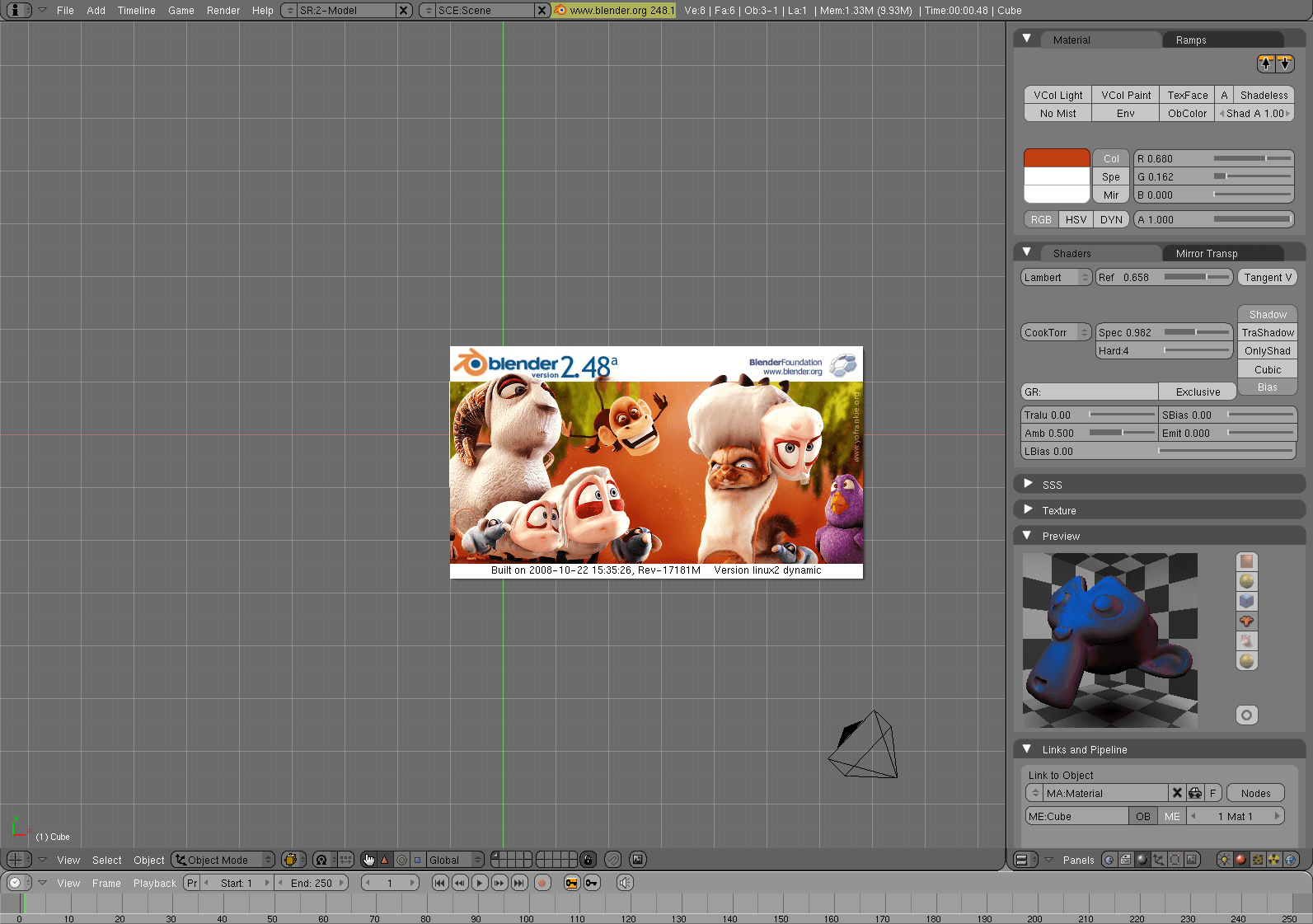

Os exemplos públicos cobrem três frentes. No CAD, o modelo executa operações contínuas de mouse para extrusão em Blender, com checkpoints do sistema operacional que permitem forking e recuperação durante a geração, o que viabiliza computação de teste em agentes de uso de computador.

![Interface do Blender, exemplo de CAD]

Na direção, após menos de uma hora de fine-tuning com dados coletados, o FDM-1 controla um carro real em San Francisco via teclas direcionais através de uma interface de joystick do openpilot. O sistema usa uma página web para encaminhar entradas e monitorar telemetria, e o agente executa curvas e retorna a trajetórias retas ao redor do quarteirão. Esse resultado sugere transferência do que foi aprendido em uso de computador para controle no mundo real com entradas discretas.

![California Street, San Francisco, cenário urbano para condução]

No fuzzing de UI, o modelo explora um app bancário simulado para encontrar estados raros, algo que um passeio aleatório por teclas raramente alcança. O FDM-1 descobre que o botão de enviar transferência permanece clicável logo após uma operação, o que leva o saldo a ficar negativo. Para times de QA e segurança de aplicações, um agente que percorre a árvore de estados como um humano, mas com consistência de máquina, vale ouro.

A cobertura de mercado noticiou o lançamento e enfatizou a escala dos dados, os 11 milhões de horas de screen recordings, bem como a ênfase em ações contínuas, como arrastar e manipular 3D, que são difíceis de aprender com fotos estáticas. Relatos também citam ganhos na descoberta de bugs e na execução de sequências longas.

Como o FDM-1 se posiciona no ecossistema de agentes

A maioria das abordagens atuais tenta usar modelos multimodais que “leem” a tela e chamam ferramentas externas. Essa estratégia funciona para tarefas curtas, mas sofre com dependência de chain-of-thought textual e pouca fidelidade temporal. O FDM-1 é, por design, um modelo de ação em computador que “vive” no vídeo. Quando se fala em horizonte longo e coordenação fina de mouse e teclado, vídeo importa. As estimativas publicadas de frames por 200k tokens em encoders populares mostram o teto baixo de contexto quando se usa embeddings de tela tradicionais.

Por outro lado, não se trata de substituir todo o stack de agentes por um único modelo. A leitura é complementar. Modelos de linguagem excelentes para raciocínio e leitura de documentos podem orquestrar, enquanto um modelo de ação como o FDM-1 executa rotinas longas e sensíveis a tempo. Em cenários corporativos, isso sugere pipelines híbridos em que LLMs planejam e o FDM-1 opera aplicações críticas com checkpoints reprodutíveis.

Métricas, escala e sinais de competência

O post técnico relata que o modelo atinge aproximadamente 50 por cento de acurácia na predição de teclas em uma tarefa de setas, classificando entre não agir, ir à esquerda ou à direita, um valor superior ao baseline sem pré-treinamento de vídeo. As curvas de escala em tarefas como manipulação de UI, memória simbólica e alvo mostram inclinações mais fortes quando se treina com dados rotulados pelo IDM em larga escala. É um indício de que o rótulo automático, quando bem calibrado, supera o gargalo humano.

Outro ponto relevante, o encoder de vídeo treinado com objetivo autossupervisionado apresentou convergência muito mais rápida que um ViT simples sob a mesma carga de tokens. Além disso, a SI publicou uma tabela de duração média de vídeo por janela de contexto, 3 minutos e 30 segundos em 32k tokens, 20 minutos em 200k, e 1 hora e 40 minutos em 1 milhão, uma forma didática de visualizar o salto prático que a compressão certa propicia.

O que isso significa para times de produto, engenharia e finanças

Para produto, a mensagem é clara. Se a sua aplicação exige sequências longas de interação gráfica, o caminho mais promissor passa por treinar com vídeo real e medir sucesso por estados atingidos, não por descrições textuais. O FDM-1 mostra que com forking, checkpoints e rotulação automática, dá para sistematizar execuções que antes eram exclusivas de humanos especialistas.

Para engenharia, vale estudar a arquitetura de rótulo por IDM e a compressão de vídeo. Em sistemas internos, dá para replicar a ideia com vídeos próprios, calibrar um IDM do seu domínio, e criar um dataset de milhões de passos com custo marginal baixo. Para áreas reguladas, onde rastreabilidade é mandatória, os checkpoints e o registro de ações oferecem auditoria fiel.

Para finanças e operações, o que antes era inviável por custo de anotação torna-se linha de P e L. É o clássico deslocamento de curva. Quando o regime deixa de ser limitado por dados e passa a ser limitado por computação, os gargalos migrarão para orquestração de GPUs, compressão ótima e cache de contextos longos. As empresas que dominarem essa camada transformarão horas de trabalho em minutos, com ganhos reais em tarefas de alto valor, como design paramétrico, simulação, reconciliação de sistemas e QA profundo. Relatos da imprensa setorial já destacam essa mudança de velocidade e a tendência de sistemas mais agentic.

Comparando com a geração anterior, lições do VPT e de encoders de vídeo

O VPT da OpenAI pavimentou o caminho ao demonstrar que um IDM treinado com poucas horas rotuladas pode gerar etiquetas para dezenas de milhares de horas de vídeo e, com isso, criar um prior comportamental útil. No entanto, o domínio era Minecraft e a interface tinha cerca de 20 Hz, com tarefas de segundos a poucos minutos. O FDM-1 expande a técnica para uso de computador em geral, com entradas a 30 FPS e ambição de minutos a horas de contexto, o que demanda encoder e infraestrutura de I O bem diferentes.

Do lado dos encoders, o ecossistema avançou com tokenizadores de imagem e vídeo como o Cosmos, da NVIDIA, que perseguem compressão temporal e espacial agressiva. A discussão da SI compara seu encoder a referências públicas e destaca por que contar tokens por frame é mais útil do que o número bruto de tokens por imagem. A métrica que importa para um agente que age em tempo real é duração útil de vídeo por janela.

Limitações e próximos passos

O post da SI é transparente ao dizer que ainda há problemas técnicos a resolver antes de chegarmos a aprendizes gerais alinhados. Modelos como o FDM-1, mesmo com ganhos claros, não substituem supervisão humana em decisões críticas. Há ruídos introduzidos pelo IDM em tarefas como digitação e compreensão verbal, e o time sugere mesclar dados de contratados com rótulos automáticos para escalar com mais fidelidade.

Além disso, a infraestrutura de avaliação para uso de computador em geral ainda está em construção. A SI apresenta uma suíte interna com tarefas de memória, alvo, manipulação de UI e CAD, mas o setor carece de benchmarks padronizados que reflitam “trabalho de escritório real” por horas, não segundos. À medida que encoders ficarem mais eficientes e pipelines de rótulo madurarem, a expectativa é de zero shot mais robusto em tarefas de longa duração.

Conclusão

FDM-1 marca um ponto de inflexão para o modelo de ação em computador. Ao treinar em 11 milhões de horas de vídeo e operar direto no fluxo visual, o sistema rompe com a dependência de anotações caras e com a miopia das janelas curtas. A combinação de IDM para rotular e encoder eficiente para comprimir abre caminho para agentes que realmente executam, em vez de apenas narrar, o que veem na tela.

Para equipes que querem aplicar IA de uso de computador agora, a estratégia que emerge é pragmática. Use vídeo real do seu domínio, construa um IDM para rótulo em escala, invista em encoder que maximize minutos por contexto, e desenhe checkpoints e forks para segurança e velocidade. O FDM-1 não encerra a conversa, ele inaugura uma fase mais prática na qual o gargalo muda de dados para computação, e quem dominar essa camada vai colher os ganhos mais cedo.